A produção de revestimentos e adesivos de poliuretano (PU) é um processo complexo e multifásico, regido por reações químicas sensíveis. Embora a demanda por esses materiais continue a crescer em diversos setores, sua fabricação apresenta uma série de desafios fundamentais que impactam diretamente a qualidade do produto, a eficiência da produção e a lucratividade geral. Uma compreensão profunda dessas questões fundamentais é crucial para o desenvolvimento de um plano estratégico e prático de melhoria.

1.1. Complexidade e Variabilidade Química Inerentes: O Desafio da Cura Rápida

A produção de poliuretano é uma reação de poliadição entre polióis e isocianatos, um processo frequentemente rápido e altamente exotérmico. A velocidade e o calor gerados por essa reação tornam o controle preciso excepcionalmente difícil. A complexidade inerente é ainda agravada pela sensibilidade da reação a fatores externos, como temperatura, umidade e presença de catalisadores. Pequenas flutuações não controladas nessas condições ambientais ou nos insumos de materiais podem levar a variações significativas nas propriedades do produto final, incluindo seu tempo de cura e desempenho físico.

Um desafio fundamental neste contexto é o "curto tempo de vida útil" de muitos sistemas de poliuretano (PU) de cura rápida. As escalas de tempo de produção de gás e reticulação do PU são frequentemente muito breves para serem compatíveis com os métodos tradicionais de caracterização. Este é um problema central tanto do ponto de vista da engenharia quanto da economia. Os procedimentos tradicionais de controle de qualidade (CQ), que envolvem a coleta de uma amostra do reator e seu transporte para um laboratório para análise, são inerentemente falhos. O processo de titulação em laboratório é lento e, principalmente, as propriedades químicas da amostra começam a mudar no momento em que ela é removida do reator e exposta às condições ambientais. Essa latência significa que os resultados de laboratório são uma análise post-mortem de um lote que já foi produzido. Os dados não são apenas inócuos, chegando tarde demais para permitir intervenção, mas também potencialmente imprecisos, pois não representam mais o estado do material dentro do recipiente de produção. Essa incompatibilidade fundamental do controle de qualidade tradicional, baseado em latência, com a cinética rápida da química do PU é o principal problema que o monitoramento e a modelagem avançados devem abordar.

1.2. Causas principais da inconsistência de lotes e da formação de defeitos

A inconsistência entre lotes e a formação de defeitos não são ocorrências aleatórias, mas sim a consequência direta da falta de precisão no controle de parâmetros críticos do processo. O produto final é altamente sensível à proporção dos componentes, à técnica de mistura e ao perfil de temperatura ao longo do processo. Uma mistura inadequada, por exemplo, pode levar à dispersão irregular de cargas ou endurecedores, causando "tensões internas" e defeitos no produto final.

A precisão na entrada de matéria-prima, particularmente a proporção molar de grupos isocianato (NCO) para grupos hidroxila (OH), é fundamental para manter a continuidade da qualidade. Essa proporção NCO/OH é um determinante direto das propriedades do produto final; à medida que a proporção aumenta, também aumentam propriedades físicas importantes, como resistência à tração, módulo de elasticidade e dureza. A proporção também afeta a viscosidade e o comportamento de cura do material. Outras condições críticas do processo, como o perfil de aquecimento, são igualmente importantes. O aquecimento insuficiente ou não uniforme pode causar cura irregular e retração localizada, enquanto componentes voláteis podem evaporar, levando à formação de bolhas e imperfeições.

Uma análise detalhada das causas raiz dos defeitos revela que um único sensor ou parâmetro geralmente é insuficiente para um diagnóstico preciso. Um problema como "Sem gelificação ou não cura" pode ser causado por uma proporção de mistura incorreta, calor insuficiente ou mistura inadequada. Essas causas geralmente estão inter-relacionadas. Por exemplo, uma temperatura muito baixa retardará o processo de cura e pode ser erroneamente diagnosticada como um problema com a proporção do material. Para realmente entender e solucionar a causa raiz, é necessário medir vários parâmetros simultaneamente. Isso requer um conjunto abrangente de sensores que possa correlacionar dados em tempo real de várias fontes para isolar o verdadeiro fator causal dos sintomas resultantes, uma tarefa que está além do escopo do monitoramento tradicional de ponto único.

1.3. Impacto econômico e ambiental das ineficiências

Os desafios técnicos na produção de poliuretano têm repercussões econômicas e ambientais diretas e significativas. Matérias-primas de alta qualidade, como polióis e isocianatos, são caras e seus preços estão sujeitos a flutuações devido a descontinuidades na cadeia de suprimentos, dependência do petróleo bruto e demanda global. Quando um lote de produtos não atende às especificações de qualidade, o desperdício de matéria-prima representa uma perda financeira direta que agrava esses altos custos. O tempo de inatividade não planejado, resultante da necessidade de solucionar problemas e corrigir desvios no processo, é outro grande prejuízo financeiro.

No âmbito ambiental, as ineficiências e o desperdício inerentes aos métodos de produção tradicionais representam uma preocupação significativa. Muitos revestimentos de poliuretano convencionais são à base de solventes e contribuem para a poluição atmosférica através da emissão de Compostos Orgânicos Voláteis (COVs). Embora as indústrias estejam adotando cada vez mais alternativas à base de água e com baixo teor de COVs, estas frequentemente não conseguem igualar o desempenho das suas contrapartes à base de solventes em aplicações de alto desempenho. Além disso, as matérias-primas utilizadas na produção tradicional de PU são derivadas do petróleo, não renováveis e não biodegradáveis. Produtos defeituosos que acabam como resíduos podem liberar substâncias químicas nocivas no meio ambiente à medida que se decompõem ao longo de um período de até 200 anos.

A convergência desses fatores econômicos e ambientais cria um argumento comercial sólido para a digitalização. Ao implementar as soluções propostas neste relatório, uma empresa pode, simultaneamente, reduzir custos, aumentar a lucratividade e aprimorar seu perfil de sustentabilidade. A resolução do problema técnico da inconsistência entre lotes mitiga diretamente os problemas financeiros e ambientais, transformando uma atualização técnica em um imperativo estratégico para os negócios.

Monitoramento em linha do teor de isocianato livre em poliuretano

II. Tecnologias avançadas de monitoramento em tempo real

Para superar os desafios inerentes à produção de poliuretano (PU), é essencial uma mudança dos testes tradicionais em laboratório para o monitoramento em linha e em tempo real. Esse novo paradigma se baseia em um conjunto de tecnologias de sensores avançadas que podem fornecer dados contínuos e acionáveis sobre parâmetros críticos do processo.

2.1. Monitoramento Reológico em Linha

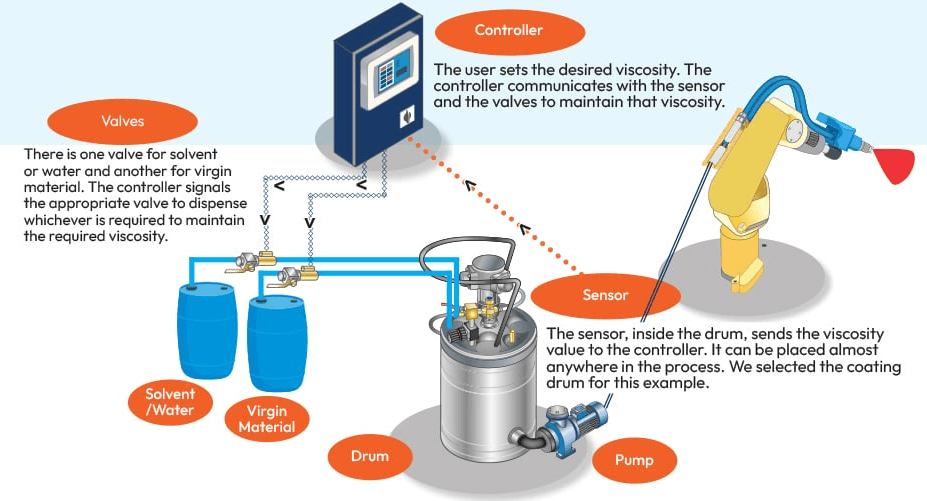

Propriedades reológicas como viscosidade e densidade são fundamentais para o sucesso de uma reação de poliuretano. Elas não são meramente características físicas, mas servem como indicadores diretos dos processos de polimerização e reticulação. O monitoramento em tempo real dessas propriedades é realizado utilizando viscosímetros e densímetros de processo em linha.

Instrumentos como oLonnconheceuerPolymerViscometereViscosiobrigadoPrócessorSão projetados para inserção direta em tubulações e reatores, permitindo a medição contínua da viscosidade, densidade e temperatura de um fluido. Esses dispositivos operam com base em princípios como a tecnologia de garfo vibratório, que é robusta, não requer partes móveis e é insensível a vibrações externas e variações de fluxo. Essa capacidade fornece um método não destrutivo e em tempo real para monitorar o processo de polimerização. A proporção molar NCO/OH e a formação de ligações polares, por exemplo, afetam diretamente a viscosidade, tornando-a um indicador confiável do progresso da reação. Ao garantir que a viscosidade permaneça dentro de uma faixa especificada, uma equipe de produção pode confirmar se a reação está ocorrendo conforme o desejado e controlar a adição de extensores de cadeia para atingir o peso molecular e a reticulação alvo. Esse controle preciso e em tempo real melhora a qualidade do produto e reduz o desperdício, evitando a produção de lotes fora das especificações.

2.2. Análise Espectroscópica para Composição Química

Embora as propriedades reológicas indiquem o estado físico do material,análise espectroscópica em tempo realProporciona uma compreensão mais profunda, em nível químico, da reação. A espectroscopia no infravermelho próximo (NIR) é um método superior para monitorar continuamente a reação principal, quantificando a concentração de grupos isocianato (%NCO) e hidroxila.

Este método representa um avanço significativo em relação à titulação laboratorial tradicional, que é lenta e utiliza produtos químicos que exigem descarte adequado. A capacidade de um sistema NIR em tempo real monitorar múltiplos pontos do processo a partir de um único analisador proporciona uma vantagem significativa em termos de eficiência e segurança. A relação NCO/OH não é apenas uma variável de processo; ela é um determinante direto das propriedades do produto final, incluindo resistência à tração, módulo de elasticidade e dureza. Ao fornecer dados contínuos e em tempo real sobre essa relação crítica, um sensor NIR permite o ajuste proativo das taxas de alimentação de materiais. Isso transforma o processo de controle de uma abordagem reativa, focada em defeitos, para uma estratégia proativa, de qualidade por projeto, onde uma relação NCO/OH precisa é mantida ao longo da reação para garantir um resultado de alta qualidade.

2.3. Análise Dielétrica (DEA) para Monitoramento do Estado de Cura

A Análise Dielétrica (DEA), também conhecida como Análise Termoelétrica Dielétrica (DETA), é uma técnica poderosa para monitorar a "cura invisível no molde", que é crucial para a qualidade do produto final. Ela mede diretamente as mudanças na viscosidade e no estado de cura de um material aplicando uma tensão senoidal e medindo as mudanças resultantes na mobilidade dos portadores de carga (íons e dipolos). À medida que um material cura, sua viscosidade aumenta drasticamente e a mobilidade desses portadores de carga diminui, fornecendo uma medida direta e quantificável do progresso da cura.

A DEA (Análise Eletrodinâmica de Dispersão) pode determinar com precisão o ponto de gelificação e o fim do processo de cura, mesmo em sistemas de cura rápida. Ela oferece uma visão detalhada que complementa outras tecnologias. Enquanto um viscosímetro em linha mede a viscosidade global do material, um sensor DEA fornece informações sobre a progressão da reação de reticulação em nível químico. A combinação de umviscosímetro em linha(medindo oresultadoda cura) e um sensor DEA (medindo oprogressãoA análise por DEA (Análise Eletroquímica de Difusão) fornece uma visão abrangente e em dois níveis do processo, permitindo um controle e diagnóstico altamente precisos. A DEA também pode ser usada para monitorar a eficácia de diversos aditivos e materiais de preenchimento.

Uma comparação dessas tecnologias destaca sua natureza complementar. Nenhum sensor isolado consegue fornecer uma visão completa da complexa reação do poliuretano. Uma solução holística requer a integração de múltiplos sensores para monitorar simultaneamente diferentes propriedades físicas e químicas.

| Parâmetro monitorado | Princípio da Tecnologia | Principais casos de uso |

| Viscosidade, Temperatura | Viscosímetro de garfo vibratório | Controle de qualidade da matéria-prima, monitoramento de reação em tempo real, detecção do ponto final. |

| %NCO, Número de Hidroxila | Espectroscopia no infravermelho próximo (NIR) | Monitoramento em tempo real da composição química, controle da proporção de alimentação, otimização do catalisador. |

| Estado de cura, ponto de gelificação | Análise Dielétrica (DEA) | Monitoramento da cura no molde, verificação do tempo de gelificação, análise da eficácia de aditivos. |

Tabela 2.1: Comparação de tecnologias avançadas de monitoramento em linha para a produção de PU

III. Estruturas de Modelagem Preditiva Quantitativa

Os ricos fluxos de dados provenientes de tecnologias avançadas de monitoramento são um pré-requisito para a digitalização, mas seu valor total é percebido quando utilizados para construir modelos preditivos quantitativos. Esses modelos traduzem dados brutos em insights acionáveis, permitindo uma compreensão mais profunda do processo e uma mudança em direção à otimização proativa.

3.1. Modelagem quimiorreológica e da cinética de cura

A simples coleta de dados de sensores não é suficiente para alcançar um controle de processo eficaz; os dados devem ser usados para construir um modelo que explique o comportamento subjacente da reação química. Modelos quimiorreológicos e de cinética de cura relacionam a conversão química a mudanças físicas, como o aumento da viscosidade e do tempo de gelificação. Esses modelos são particularmente valiosos para sistemas de cura rápida, onde a natureza transitória do fenômeno dificulta a análise tradicional.5

Os métodos isoconversivos, também conhecidos como abordagens livres de modelo, podem ser aplicados a dados não isotérmicos para prever a cinética de reação de resinas de cura rápida. Esses modelos envolvem análises termo-químicas-reológicas altamente acopladas, o que significa que consideram a interação entre temperatura, composição química e propriedades de fluxo do material. Ao construir uma representação matemática de toda a reação, esses modelos vão além do simples monitoramento, proporcionando uma compreensão real do processo. Eles podem prever como a viscosidade mudará ao longo do tempo para um determinado perfil de temperatura ou como uma mudança no catalisador alterará a taxa de reação, fornecendo uma ferramenta sofisticada para controle e otimização.

3.2. Análise quimiométrica e regressão multivariada

A produção de poliuretano é um processo multivariado onde múltiplos fatores interagem para determinar a qualidade do produto final. A experimentação tradicional, com um único fator, é demorada e não consegue capturar as relações complexas e não lineares entre as variáveis. Técnicas quimiométricas, como a regressão por Mínimos Quadrados Parciais (PLS) e a Metodologia de Superfície de Resposta (RSM), são projetadas para lidar com esse desafio.

A regressão por mínimos quadrados parciais (PLS) é uma técnica adequada para a análise de grandes conjuntos de dados correlacionados, como os gerados por um espectrômetro NIR em tempo real. A PLS reduz o problema de um grande número de variáveis inter-relacionadas para um pequeno número de fatores extraídos, tornando-a excelente para fins preditivos. No contexto da produção de poliuretano, a PLS pode ser usada para diagnosticar problemas de processo e revelar como as variáveis de qualidade variam espacialmente dentro do produto.

A Metodologia de Superfície de Resposta (MSR) é um método matemático e estatístico poderoso, específico para modelagem e otimização de condições experimentais. A MSR permite a análise dos efeitos combinados de múltiplos fatores — como a razão NCO/OH, o coeficiente de extensão da cadeia e a temperatura de cura — sobre uma variável de resposta desejada, como a resistência à tração. Ao posicionar estrategicamente pontos experimentais em regiões críticas, a MSR pode caracterizar com precisão as relações não lineares subjacentes e os efeitos interativos entre os fatores. Um estudo demonstrou a eficácia dessa abordagem, com um modelo prevendo as propriedades finais com um erro de precisão impressionante de apenas 2,2%, fornecendo uma validação convincente da metodologia. A capacidade de mapear toda a "superfície de resposta" para uma métrica de qualidade permite que um engenheiro identifique a combinação ideal de todos os fatores simultaneamente, levando a uma solução superior.

3.3. Gêmeo Digital do Processo de Produção

Um gêmeo digital é uma réplica virtual e dinâmica de um ativo, sistema ou processo físico. Na indústria química, essa réplica é alimentada por dados em tempo real provenientes de sensores de IoT e modelos preditivos. Ela serve como uma simulação viva e de alta fidelidade da linha de produção. O verdadeiro valor de um gêmeo digital reside em sua capacidade de proporcionar um ambiente de baixo risco para otimizações de alto impacto.

A produção de poliuretano é um processo dispendioso devido ao alto custo das matérias-primas e ao elevado consumo de energia. Realizar experimentos físicos para otimizar o processo é, portanto, uma empreitada de alto risco e alto custo. Um gêmeo digital aborda diretamente esse desafio, permitindo que os engenheiros executem milhares de simulações de cenários hipotéticos em um modelo virtual sem consumir matéria-prima ou tempo de produção. Essa capacidade não só acelera o lançamento de novas formulações no mercado, como também reduz significativamente o custo e o risco da otimização do processo. Além disso, os gêmeos digitais podem preencher a lacuna entre as novas tecnologias digitais e os sistemas legados mais antigos, integrando dados em tempo real da infraestrutura existente, proporcionando um ambiente digital unificado sem a necessidade de grandes reformas.

IV. IA/Aprendizado de Máquina para Controle de Processos e Detecção de Anomalias

Os modelos preditivos transformam dados em conhecimento, mas a inteligência artificial (IA) e o aprendizado de máquina (ML) dão o próximo passo: transformam o conhecimento em ação autônoma e controle inteligente.

4.1. Sistemas de Detecção de Anomalias e Falhas

Os sistemas tradicionais de controle de processos dependem de limites estáticos e predefinidos para disparar alarmes. Essa abordagem é propensa a erros, pois pode não detectar desvios graduais que permanecem dentro de uma faixa aceitável ou pode gerar alarmes falsos que dessensibilizam os operadores. A detecção de anomalias baseada em IA representa uma mudança de paradigma significativa. Esses sistemas são treinados com dados históricos para aprender os padrões normais de operação de um processo. Eles podem então identificar e sinalizar automaticamente quaisquer desvios desse padrão aprendido, mesmo que um parâmetro ainda não tenha ultrapassado um limite estático.

Por exemplo, um aumento gradual, porém consistente, na viscosidade ao longo de um período específico, mesmo que ainda dentro da faixa aceitável, pode ser um prenúncio de um problema iminente que um sistema tradicional não detectaria. Um sistema de detecção de anomalias baseado em IA reconheceria isso como um padrão incomum e geraria um alerta precoce, permitindo que a equipe tome medidas proativas para evitar um lote defeituoso. Essa capacidade aprimora significativamente o controle de qualidade, detectando desvios das especificações desejadas, reduzindo o risco de produtos defeituosos e garantindo a conformidade.

4.2. Manutenção preditiva para ativos críticos

O tempo de inatividade não planejado é um dos custos mais significativos na manufatura industrial. As estratégias tradicionais de manutenção são reativas ("consertar quando quebra") ou baseadas no tempo (por exemplo, trocar uma bomba a cada seis meses, independentemente de sua condição). A manutenção preditiva, impulsionada por modelos de aprendizado de máquina, oferece uma alternativa muito superior.

Ao analisar continuamente dados em tempo real de sensores (como vibração, temperatura e pressão), esses modelos podem identificar sinais precoces de degradação de equipamentos e prever possíveis falhas. O sistema pode fornecer uma "previsão de tempo até a falha", permitindo que a equipe agende reparos durante uma parada programada com semanas ou até meses de antecedência. Isso elimina o tempo de inatividade dispendioso decorrente de uma falha inesperada e permite um melhor planejamento da força de trabalho, peças e logística. O retorno sobre o investimento (ROI) dessa abordagem é substancial e bem documentado em estudos de caso. Por exemplo, uma refinaria obteve um ROI de 3 vezes ao implementar um programa de inspeção proativa, enquanto uma empresa de petróleo e gás economizou milhões de dólares com um sistema de alerta precoce que detectou anomalias nos equipamentos. Esses benefícios financeiros tangíveis justificam a transição de uma estratégia de manutenção reativa para uma estratégia preditiva.

4.3. Controle preditivo de qualidade

O controle preditivo de qualidade altera fundamentalmente o papel da garantia da qualidade, transformando-a de uma verificação pós-produção em uma função proativa durante o processo. Em vez de esperar que um produto final seja testado quanto a propriedades como dureza ou resistência à tração, os modelos de aprendizado de máquina podem analisar continuamente dados de processo em tempo real, provenientes de todos os sensores, para prever, com alto grau de confiança, quais serão os atributos de qualidade finais.

Um modelo preditivo de qualidade pode identificar a complexa interação entre a qualidade da matéria-prima, os parâmetros do processo e as condições ambientais para determinar as configurações de produção ideais para o resultado desejado. Se o modelo prevê que o produto final estará fora das especificações (por exemplo, muito macio), ele pode alertar o operador ou até mesmo ajustar automaticamente um parâmetro do processo (por exemplo, a taxa de alimentação do catalisador) para corrigir o desvio em tempo real. Essa capacidade não só ajuda a prevenir defeitos antes que eles ocorram, como também acelera a pesquisa e o desenvolvimento, fornecendo previsões mais rápidas das propriedades e identificando padrões subjacentes nos dados. Essa abordagem é um imperativo estratégico para fabricantes que buscam maximizar o rendimento e melhorar a eficiência operacional.

V. Roteiro de Implementação Técnica

A implementação dessas soluções avançadas exige uma abordagem estruturada e faseada que leve em consideração as complexidades da integração de dados e da infraestrutura legada. Um roteiro bem definido é essencial para mitigar riscos e demonstrar um retorno sobre o investimento (ROI) antecipado.

5.1. Abordagem faseada para a transformação digital

Uma jornada de transformação digital bem-sucedida não deve começar com uma reformulação completa. Os altos custos iniciais de investimento e a complexidade da integração de novos sistemas podem ser proibitivos, especialmente para pequenas e médias empresas. Uma abordagem mais eficaz é adotar uma implementação em etapas, começando com uma Prova de Conceito (PoC) em uma única linha de produção piloto. Este projeto de baixo risco e pequena escala permite que uma empresa teste a interoperabilidade de novos sensores e softwares com a infraestrutura existente e avalie o desempenho antes de se comprometer com uma implementação mais ampla. O ROI quantificado desse sucesso inicial pode então ser usado para construir um argumento comercial convincente para uma implementação mais abrangente. Essa abordagem está alinhada com os princípios fundamentais da Indústria 4.0, que enfatizam a interoperabilidade, a capacidade em tempo real e a modularidade.

5.2. Arquitetura de Gerenciamento e Integração de Dados

Uma infraestrutura de dados robusta é a base para todas as soluções preditivas e orientadas por IA. A arquitetura de dados deve ser capaz de lidar com o volume massivo e os diversos tipos de dados gerados por uma fábrica inteligente. Isso normalmente envolve uma abordagem em camadas que inclui um sistema de histórico de dados e um data lake.

Historiador de Dados:Um sistema de registro histórico de dados é um banco de dados especializado projetado para coletar, armazenar e gerenciar grandes quantidades de dados de séries temporais de processos industriais. Ele funciona como um arquivo digital meticulosamente organizado, capturando cada flutuação de temperatura, leitura de pressão e vazão com um registro de data e hora preciso. O sistema de registro histórico de dados é a ferramenta ideal para lidar com fluxos de dados contínuos e de alto volume provenientes de sensores de processo e é o "combustível perfeito" para análises avançadas.

Lago de dados:Um data lake é um repositório central que armazena dados brutos em seu formato nativo e pode acomodar diversos tipos de dados, incluindo dados estruturados de séries temporais, imagens não estruturadas de câmeras de alta qualidade e registros de máquinas. O data lake é projetado para lidar com a enorme quantidade de dados diversos provenientes de todas as áreas de uma empresa, permitindo uma visão mais holística e de ponta a ponta. Uma implementação bem-sucedida requer tanto um sistema de histórico de dados para os dados principais dos processos quanto um data lake para uma visão mais ampla e abrangente que possibilite análises complexas, como análise de causa raiz e correlação com dados não provenientes de sensores.

Uma arquitetura lógica em camadas para integração de dados teria a seguinte aparência:

| Camada | Componente | Função | Tipo de dados |

| Borda | Sensores de IoT, gateways, PLCs | Aquisição de dados em tempo real e processamento local | Séries temporais, binárias, discretas |

| Fundação de Dados | Historiador de Dados | Armazenamento de alto desempenho e com registro de data e hora de dados de processo | Séries temporais estruturadas |

| Repositório Central | Lago de dados | Repositório centralizado e escalável para todas as fontes de dados. | Estruturado, semiestruturado, não estruturado |

| Análise e IA | Plataforma de análise | Executa modelos preditivos, aprendizado de máquina e inteligência de negócios. | Todos os tipos de dados |

Tabela 5.1: Principais componentes de integração e gerenciamento de dados

5.3. Abordando os desafios da integração de sistemas legados

Muitas indústrias químicas ainda dependem de sistemas de tecnologia operacional (TO) com mais de uma década de existência, que frequentemente utilizam protocolos proprietários incompatíveis com os padrões modernos. A substituição desses sistemas legados, como Sistemas de Controle Distribuído (SCD) ou Controladores Lógicos Programáveis (CLP), é um projeto multimilionário que pode causar paralisações significativas na produção. Uma solução mais prática e econômica é utilizar gateways de IoT e APIs como ponte.

Os gateways de IoT atuam como intermediários, traduzindo dados de novos sensores de IoT para um formato que sistemas mais antigos possam entender. Eles permitem que uma empresa implemente monitoramento avançado sem uma reformulação completa, abordando diretamente a barreira de custo e tornando as soluções propostas muito mais acessíveis. Além disso, a implementação de computação de borda, onde os dados são processados diretamente na origem, pode reduzir a largura de banda da rede e melhorar a capacidade de resposta em tempo real.

5.4. Decisão de arquitetura local versus em nuvem

A decisão sobre onde hospedar plataformas de dados e análises é crucial e tem implicações significativas em termos de custo, segurança e escalabilidade. A escolha não se resume a um simples "ou um ou outro", mas deve ser baseada em uma análise cuidadosa dos casos de uso específicos.

| Critério | Local | Nuvem |

| Controlar | Controle total sobre hardware, software e segurança. Ideal para setores altamente regulamentados. | Menos controle direto; um modelo de responsabilidade compartilhada. |

| Custo | Altos custos iniciais de hardware; depreciação e manutenção são de responsabilidade da empresa. | Custo inicial mais baixo com um modelo de "pague conforme o uso". |

| Escalabilidade | Elasticidade limitada; requer provisionamento manual e investimento de capital para aumentar a escala. | Escalabilidade e elasticidade imensas; pode ser ampliado e reduzido dinamicamente. |

| Latência | Baixa latência, pois os dados estão fisicamente próximos da fonte. | Pode apresentar latência excessiva para algumas cargas de trabalho de controle em tempo real. |

| Inovação | Acesso mais lento às novas tecnologias; requer atualizações manuais de software e hardware. | Conjunto de funcionalidades em rápida expansão com inovações como IA e ML. |

| Segurança | A empresa é a única responsável por todas as práticas de segurança. | Responsabilidade compartilhada com o provedor, que lida com várias camadas de segurança. |

Tabela 5.2: Matriz de decisão Nuvem vs. Local

Uma estratégia digital bem-sucedida geralmente utiliza um modelo híbrido. Loops de controle de baixa latência e dados de formulação altamente confidenciais, essenciais para a missão, podem ser mantidos localmente para máxima segurança e controle. Simultaneamente, uma plataforma em nuvem pode ser usada como um repositório de dados centralizado, permitindo análises históricas de longo prazo, pesquisa colaborativa com parceiros externos e acesso a ferramentas de IA e ML de ponta.

VI. Manual Prático de Otimização e Diagnóstico

O verdadeiro valor do monitoramento e da modelagem avançados se revela quando são utilizados para criar ferramentas práticas para gerentes de produção e engenheiros. Essas ferramentas podem automatizar e aprimorar o processo de tomada de decisão, passando da solução de problemas reativa para o controle proativo baseado em modelos.

6.1. Uma estrutura de diagnóstico orientada a modelos

Em um ambiente de manufatura tradicional, a resolução de problemas é um processo manual e demorado, que depende da experiência do operador e de uma abordagem de tentativa e erro. Uma estrutura de diagnóstico orientada por modelos automatiza esse processo, utilizando dados em tempo real e resultados de modelos para identificar instantaneamente a causa raiz mais provável de um problema.

A estrutura funciona como uma árvore de decisão ou fluxograma lógico. Quando um sintoma de defeito é detectado (por exemplo, uma leitura anormal de viscosidade em um viscosímetro em linha), o sistema correlaciona automaticamente esse sintoma com dados de outros sensores (por exemplo, temperatura, relação NCO/OH) e com as saídas dos modelos preditivos (por exemplo, o modelo RSM para dureza). O sistema pode então apresentar ao operador uma lista priorizada de possíveis causas raiz, reduzindo o tempo de diagnóstico de horas para minutos e permitindo uma ação corretiva muito mais rápida. Essa abordagem vai além da simples detecção de um defeito, passando a identificar e corrigir proativamente o problema subjacente.

Figura 6.1: Um fluxograma simplificado ilustrando o processo de utilização de dados de sensores em tempo real e modelos preditivos para orientar os operadores na identificação de uma causa raiz específica e na tomada de uma ação corretiva.

Essa abordagem pode ser resumida em uma matriz de diagnóstico que fornece um guia de referência rápida para o público-alvo.

| Defeito/Sintoma | Fluxo de dados relevantes | Causa raiz provável |

| Dureza inconsistente | Relação NCO/OH, perfil de temperatura | Proporção de materiais incorreta, perfil de temperatura não uniforme |

| Má adesão | Temperatura da superfície, Umidade | Preparação inadequada da superfície, interferência da umidade ambiental |

| Bolhas ou imperfeições | Perfil de viscosidade, temperatura | Componentes voláteis, mistura inadequada ou perfil de calor incorreto. |

| Tempo de cura inconsistente | Relação NCO/OH, temperatura, taxa de alimentação do catalisador | Concentração incorreta do catalisador, flutuação de temperatura |

| Estrutura enfraquecida | Tempo de gelificação, perfil de viscosidade | Calor insuficiente, retração localizada em uma área fria |

Tabela 6.2: Matriz de Diagnóstico de Defeito a Insight

6.2. Procedimentos Operacionais Padrão (POPs) inteligentes

Os Procedimentos Operacionais Padrão (POPs) tradicionais são documentos estáticos em papel que fornecem um guia rígido, passo a passo, para os processos de fabricação. Embora sejam essenciais para padronizar as operações e garantir a conformidade, eles não conseguem levar em conta os desvios do processo em tempo real. Um "POP inteligente" é uma nova geração de procedimento dinâmico, integrado aos dados do processo em tempo real.

Por exemplo, um Procedimento Operacional Padrão (POP) tradicional para um processo de mistura pode especificar uma temperatura e um tempo de mistura constantes. Um POP inteligente, por outro lado, estaria vinculado a sensores de temperatura e viscosidade em tempo real. Se um sensor detectar que a temperatura ambiente caiu, o POP inteligente poderia ajustar dinamicamente o tempo ou a temperatura de mistura necessários para compensar a mudança, garantindo que a qualidade do produto final permaneça consistente. Isso torna o POP um documento vivo e adaptável que ajuda os operadores a tomar a decisão ideal em um ambiente fluido e em tempo real, minimizando a variabilidade, reduzindo erros e melhorando a eficiência geral.

6.3. Otimização de Malhas de Controle

O pleno potencial dos sensores e modelos preditivos é liberado quando integrados a um sistema que controla ativamente o processo. Isso envolve a aplicação das melhores práticas para o ajuste de malhas de controle e a implementação de estratégias de controle avançadas.

A otimização do circuito de controle é um processo sistemático que começa com uma compreensão profunda do processo, definindo o objetivo do controle e, em seguida, utilizando dados em tempo real para ajustar o circuito. Estratégias de Controle Avançado de Processos (APC), como controle em cascata e controle preditivo, podem ser usadas para melhorar a estabilidade e a capacidade de resposta. O objetivo final é fechar o ciclo de dados para ação: um sensor NIR em linha fornece dados em tempo real sobre a relação NCO/OH, um modelo preditivo prevê o resultado e o circuito de controle usa essas informações para ajustar automaticamente a bomba de alimentação de isocianato, mantendo a relação ideal e eliminando a variabilidade. O monitoramento contínuo do desempenho do circuito é crucial para detectar desvios, identificar problemas nos sensores e determinar o momento de reajustar o circuito antes que o desempenho do processo se degrade.

VII. Estudos de Caso e Melhores Práticas

Os benefícios do monitoramento avançado e da modelagem quantitativa não são meramente teóricos; eles são comprovados por sucessos reais e retorno sobre o investimento (ROI) quantificável. As experiências de líderes do setor oferecem lições valiosas e uma argumentação comercial convincente para a digitalização.

7.1. Lições dos Líderes do Setor

Os esforços de digitalização das principais empresas químicas demonstram uma tendência clara: o sucesso advém de uma estratégia holística e integrada, e não de uma abordagem fragmentada.

DuPont:Reconheceram a necessidade de uma cadeia de suprimentos resiliente em um mercado volátil e implementaram uma plataforma digital personalizada para modelagem de cenários hipotéticos. Isso permitiu que tomassem decisões de negócios mais inteligentes e distribuíssem com eficiência mais de 1.000 produtos com capacidades de previsão aprimoradas. A lição é que conectar sistemas distintos — da cadeia de suprimentos às operações — a uma plataforma centralizada proporciona uma visão abrangente de toda a cadeia de valor.

Covestro:Implementamos uma estratégia global de digitalização corporativa para criar uma "fonte única de verdade" centralizada para os dados de projetos, eliminando a dependência de planilhas. Essa abordagem integrada economizou 90% do tempo anteriormente gasto na coleta e validação manual de dados e aumentou significativamente a confiabilidade. A empresa também aproveitou a digitalização para desenvolver novos produtos mais rapidamente e aumentar a qualidade dos produtos e a lucratividade da produção.

SABIC:Implementamos uma Plataforma de Operações Digitais em toda a empresa, que integra a qualidade da matéria-prima, os parâmetros do processo e as condições ambientais em ferramentas digitais preditivas. Uma solução de monitoramento de ativos baseada em IA, por exemplo, opera em todas as suas fábricas globalmente, prevendo possíveis falhas em equipamentos críticos e permitindo a manutenção proativa. Essa abordagem holística impulsionou melhorias na eficiência energética, na confiabilidade dos ativos e na pegada operacional.

7.2. Retorno sobre o Investimento e Benefícios Tangíveis

O investimento nessas tecnologias é uma decisão estratégica de negócios com um retorno claro e substancial. Estudos de caso de diversos setores fornecem uma validação convincente dos benefícios financeiros e operacionais.

Análise preditiva:O software AVEVA Predictive Analytics demonstrou gerar uma economia de até US$ 37 milhões em 24 meses, com uma redução de 10% nos custos recorrentes de manutenção e a eliminação de 3.000 horas anuais de manutenção. Uma empresa de petróleo e gás economizou US$ 33 milhões utilizando um sistema de alerta precoce baseado em nuvem para detectar anomalias em equipamentos. O programa de uma refinaria gerou um retorno sobre o investimento (ROI) de 3 vezes e reduziu com segurança o número de locais de monitoramento de corrosão em 27,4%.

Melhorias na eficiência:Uma fabricante de especialidades químicas enfrentava desafios na redução de custos operacionais e no aumento da previsibilidade da produção. Ao implementar uma análise abrangente para identificar oportunidades de melhoria, a empresa alcançou um significativo retorno sobre o investimento (ROI) de 2,7:1, com melhorias no rendimento unitário da matéria-prima e um aumento na produção unitária.

Segurança e logística:Uma usina de gás conseguiu reduzir os tempos de evacuação e concentração em 70% por meio da automação, após repetidas reprovações em auditorias de segurança. A plataforma digital da SABIC automatizou os processos manuais de documentação, que antes levavam quatro dias, reduzindo o tempo para apenas um dia, eliminando os principais gargalos e evitando taxas de sobrestadia.

Esses resultados demonstram que as estratégias propostas não são um conceito abstrato, mas um caminho comprovado e quantificável para alcançar maior lucratividade, eficiência e segurança.

7.3. Estudo de Caso Teórico: Otimizando a Relação NCO/OH

Este estudo de caso final ilustra como os conceitos apresentados ao longo deste relatório podem ser aplicados em uma narrativa única e coerente para resolver um problema comum e dispendioso na produção de poliuretano.

Cenário:Um fabricante de revestimentos de PU está enfrentando inconsistências entre lotes na dureza e no tempo de cura do produto final. Os testes laboratoriais tradicionais são muito lentos para diagnosticar o problema a tempo de salvar o lote, resultando em um desperdício significativo de material. A equipe suspeita que a causa principal seja uma relação NCO/OH variável.

Solução:

Monitoramento em tempo real:A equipe instala um sensor de espectroscopia NIR em tempo real na linha de alimentação para monitorar continuamente a relação NCO/OH.2Os dados desse sensor são transmitidos para um sistema de registro histórico de dados, fornecendo um registro contínuo e preciso desse parâmetro crítico.

Modelagem quantitativa:Utilizando dados históricos de NIR, a equipe desenvolve um modelo RSM que estabelece a relação precisa entre a proporção NCO/OH e a dureza e o tempo de cura do produto final. Esse modelo permite determinar a proporção ideal para atingir as propriedades desejadas e prever a qualidade final de um lote enquanto ele ainda está no reator.

Detecção de anomalias orientada por IA:Um modelo de detecção de anomalias por IA é implementado no fluxo de dados do sensor NIR. O modelo aprende o perfil operacional normal da relação NCO/OH. Se detectar um desvio desse padrão aprendido — mesmo uma pequena deriva gradual — envia um alerta antecipado para a equipe de produção. Isso fornece um aviso semanas antes que um problema fosse detectado por amostragem laboratorial tradicional.

Controle automatizado de processos:A etapa final consiste em fechar o ciclo. Um sistema de controle preditivo é implementado, utilizando os dados em tempo real do sensor NIR para ajustar automaticamente a bomba de alimentação de isocianato. Isso elimina o fator humano e garante que a relação NCO/OH seja mantida no valor ideal durante toda a reação, eliminando a variabilidade e garantindo qualidade consistente.

Ao aplicar essa estrutura abrangente, o fabricante pode passar de um modelo de produção reativo, focado em defeitos, para um modelo proativo, orientado por dados, garantindo que cada lote atenda aos padrões de qualidade, reduzindo o desperdício e melhorando a lucratividade geral.

Data da publicação: 08/09/2025