Produkcja powłok i klejów poliuretanowych (PU) to złożony, wieloetapowy proces, w którym zachodzą wrażliwe reakcje chemiczne. Chociaż popyt na te materiały stale rośnie w różnych branżach, ich produkcja wiąże się z szeregiem kluczowych wyzwań, które bezpośrednio wpływają na jakość produktu, wydajność produkcji i ogólną rentowność. Dogłębne zrozumienie tych fundamentalnych kwestii ma kluczowe znaczenie dla opracowania strategicznego i praktycznego planu rozwoju.

1.1. Nieodłączna złożoność chemiczna i zmienność: wyzwanie szybkiego utwardzania

Produkcja poliuretanów to reakcja poliaddycji między poliolami i izocyjanianami – proces często szybki i silnie egzotermiczny. Szybkość i ciepło generowane w tej reakcji sprawiają, że precyzyjna kontrola jest wyjątkowo trudna. Złożoność reakcji jest dodatkowo spotęgowana przez wrażliwość na czynniki zewnętrzne, takie jak temperatura, wilgotność i obecność katalizatorów. Niewielkie, niekontrolowane wahania tych warunków środowiskowych lub materiałów mogą prowadzić do znacznych zmian właściwości produktu końcowego, w tym czasu utwardzania i parametrów fizycznych.

Podstawowym wyzwaniem w tym kontekście jest „krótki czas przydatności do użycia” wielu szybko utwardzalnych systemów PU. Skale czasowe produkcji gazu i sieciowania PU są często zbyt krótkie, aby były kompatybilne z tradycyjnymi metodami charakteryzacji. Jest to kluczowy problem inżynieryjny i ekonomiczny. Tradycyjne procedury kontroli jakości (QC), które obejmują pobranie próbki z reaktora i przetransportowanie jej do laboratorium w celu analizy, są z natury wadliwe. Proces miareczkowania laboratoryjnego jest powolny, a co najważniejsze, właściwości chemiczne próbki zaczynają się zmieniać w momencie jej wyjęcia z reaktora i wystawienia na działanie warunków otoczenia. To opóźnienie oznacza, że wyniki laboratoryjne są analizą post mortem partii, która została już wyprodukowana. Dane są nie tylko niepraktyczne i docierają zbyt późno, aby umożliwić interwencję, ale także potencjalnie niedokładne, ponieważ nie odzwierciedlają już stanu materiału wewnątrz zbiornika produkcyjnego. Ta fundamentalna niezgodność tradycyjnej kontroli jakości opartej na opóźnieniu z szybką kinetyką chemii PU jest głównym problemem, który musi rozwiązać zaawansowany monitoring i modelowanie.

1.2. Przyczyny niespójności partii i powstawania wad

Niespójności między partiami i powstawanie defektów nie są zdarzeniami losowymi, lecz bezpośrednią konsekwencją braku precyzji w kontrolowaniu krytycznych parametrów procesu. Produkt końcowy jest bardzo wrażliwy na proporcje składników, technikę mieszania i profil temperaturowy w całym procesie. Niewłaściwe mieszanie może na przykład prowadzić do nierównomiernego rozproszenia wypełniaczy lub utwardzaczy, powodując „wbudowane naprężenia” i defekty w produkcie końcowym.

Precyzja w doborze surowca, a w szczególności stosunek molowy grup izocyjanianowych (NCO) do grup hydroksylowych (OH), ma kluczowe znaczenie dla utrzymania ciągłości jakości. Ten stosunek NCO/OH bezpośrednio determinuje właściwości produktu końcowego; wraz ze wzrostem tego stosunku rosną również kluczowe właściwości fizyczne, takie jak wytrzymałość na rozciąganie, moduł sprężystości i twardość. Wpływa on również na lepkość materiału i proces utwardzania. Równie istotne są inne krytyczne warunki procesu, takie jak profil cieplny. Niedostateczne lub nierównomierne nagrzewanie może powodować nierównomierne utwardzanie i miejscowe skurcze, a lotne składniki mogą odparowywać, prowadząc do powstawania pęcherzy i skaz.

Szczegółowa analiza przyczyn źródłowych usterek ujawnia, że pojedynczy czujnik lub parametr często nie wystarcza do dokładnej diagnozy. Problem taki jak „Brak żelu lub nieutwardzenie” może wynikać z nieprawidłowego stosunku mieszania, niewystarczającej ilości ciepła lub niewłaściwego mieszania. Przyczyny te są często ze sobą powiązane. Na przykład zbyt niska temperatura spowolni proces utwardzania i może zostać błędnie zdiagnozowana jako problem z proporcjami materiałów. Aby w pełni zrozumieć i rozwiązać przyczynę źródłową, konieczny jest jednoczesny pomiar wielu parametrów. Wymaga to kompleksowego zestawu czujników, który może korelować dane w czasie rzeczywistym z różnych źródeł, aby wyodrębnić prawdziwą przyczynę od objawów, co wykracza poza zakres tradycyjnego, jednopunktowego monitorowania.

1.3. Wpływ nieefektywności na gospodarkę i środowisko

Wyzwania techniczne w produkcji poliuretanów mają bezpośrednie i znaczące konsekwencje ekonomiczne i środowiskowe. Wysokiej jakości surowce, takie jak poliole i izocyjaniany, są drogie, a ich ceny podlegają wahaniom wynikającym z przerw w łańcuchu dostaw, uzależnienia od ropy naftowej i globalnego popytu. Gdy partia produktów nie spełnia specyfikacji jakościowych, marnotrawstwo surowców stanowi bezpośrednią stratę finansową, która dodatkowo zwiększa te wysokie koszty. Nieplanowane przestoje, wynikające z konieczności rozwiązywania problemów i korygowania odchyleń w procesie, stanowią kolejny poważny problem finansowy.

Z punktu widzenia ochrony środowiska, nieefektywność i ilość odpadów nieodłącznie związane z tradycyjnymi metodami produkcji stanowią poważny problem. Wiele konwencjonalnych powłok poliuretanowych jest opartych na rozpuszczalnikach i przyczynia się do zanieczyszczenia powietrza poprzez emisję lotnych związków organicznych (LZO). Chociaż przemysł coraz częściej stosuje alternatywy na bazie wody i o niskiej zawartości LZO, często nie dorównują one wydajnością swoim odpowiednikom na bazie rozpuszczalników w zastosowaniach wymagających wysokiej wydajności. Ponadto surowce wykorzystywane w tradycyjnej produkcji poliuretanów są oparte na ropie naftowej, nieodnawialne i niebiodegradowalne. Wadliwe produkty, które trafiają do odpadów, mogą uwalniać szkodliwe substancje chemiczne do środowiska w miarę rozkładu trwającego nawet 200 lat.

Połączenie tych czynników ekonomicznych i środowiskowych stanowi silny argument biznesowy przemawiający za cyfryzacją. Wdrażając rozwiązania zaproponowane w niniejszym raporcie, firma może jednocześnie obniżyć koszty, poprawić rentowność i poprawić swój profil zrównoważonego rozwoju. Rozwiązanie problemu technicznego związanego z niespójnością partii bezpośrednio łagodzi problemy finansowe i środowiskowe, przekształcając modernizację techniczną w strategiczny imperatyw biznesowy.

Monitorowanie w trybie inline zawartości wolnego izocyjanianu w poliuretanie

II. Zaawansowane technologie monitorowania w czasie rzeczywistym

Aby sprostać wyzwaniom związanym z produkcją poliuretanów, niezbędne jest przejście od tradycyjnych testów laboratoryjnych do monitorowania w czasie rzeczywistym, w trybie inline. Ten nowy paradygmat opiera się na zestawie zaawansowanych technologii czujników, które mogą dostarczać ciągłych, użytecznych danych o krytycznych parametrach procesu.

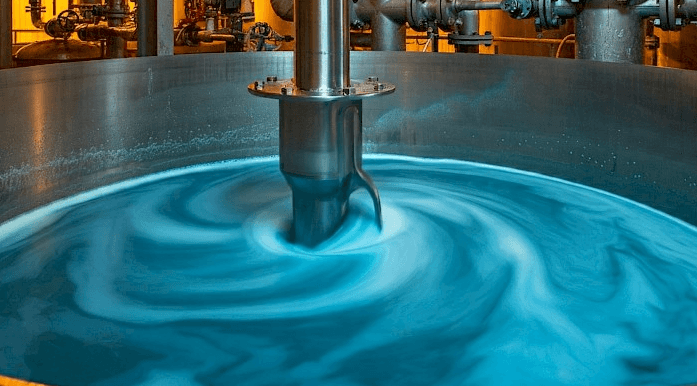

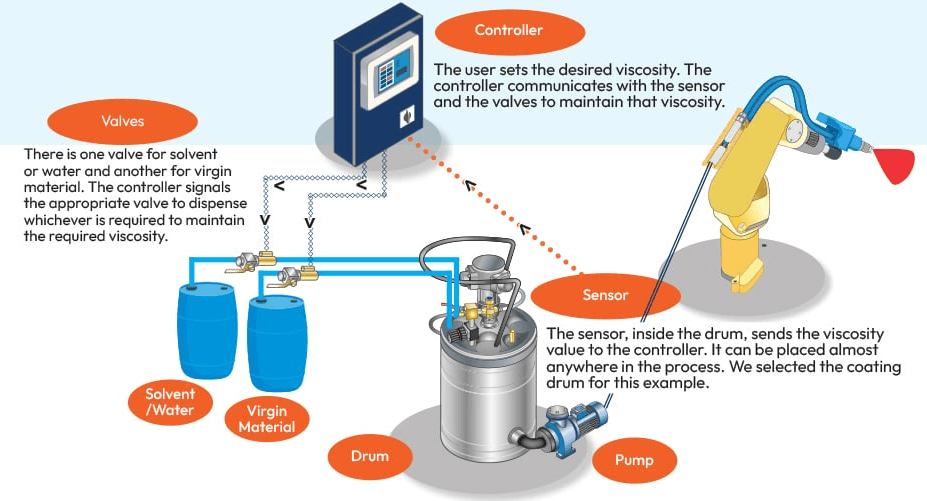

2.1. Monitorowanie reologiczne w trybie inline

Właściwości reologiczne, takie jak lepkość i gęstość, mają fundamentalne znaczenie dla powodzenia reakcji poliuretanu. Nie są one jedynie właściwościami fizycznymi, ale służą jako bezpośrednie wskaźniki procesów polimeryzacji i sieciowania. Monitorowanie tych właściwości w czasie rzeczywistym odbywa się za pomocą wiskozymetrów procesowych i gęstościomierzy pracujących w trybie inline.

Instrumenty takie jakLonnspotkałemerPolymerViscometerIViscosityZawodowieccessorSą przeznaczone do bezpośredniego wstawiania do rurociągów i reaktorów, umożliwiając ciągły pomiar lepkości, gęstości i temperatury cieczy. Urządzenia te działają w oparciu o takie zasady, jak technologia wibrującego widelca, która jest wytrzymała, nie wymaga ruchomych części i jest niewrażliwa na drgania zewnętrzne i zmiany przepływu. Ta możliwość zapewnia nieniszczącą metodę śledzenia procesu polimeryzacji w czasie rzeczywistym. Na przykład stosunek molowy NCO/OH i tworzenie wiązań polarnych bezpośrednio wpływają na lepkość, co czyni ją wiarygodnym wskaźnikiem postępu reakcji. Zapewniając utrzymanie lepkości w określonym zakresie, zespół produkcyjny może potwierdzić, że reakcja przebiega zgodnie z oczekiwaniami i kontrolować dodawanie przedłużaczy łańcucha w celu osiągnięcia docelowej masy cząsteczkowej i usieciowania. Ta ścisła kontrola w czasie rzeczywistym poprawia jakość produktu i zmniejsza ilość odpadów, zapobiegając produkcji partii niezgodnych ze specyfikacją.

2.2. Analiza spektroskopowa składu chemicznego

Chociaż właściwości reologiczne wskazują na stan fizyczny materiału,analiza spektroskopowa w czasie rzeczywistymzapewnia głębsze zrozumienie reakcji na poziomie chemicznym. Spektroskopia w bliskiej podczerwieni (NIR) to lepsza metoda ciągłego monitorowania głównej reakcji poprzez ilościowe określenie stężenia izocyjanianu (%NCO) i grup hydroksylowych.

Ta metoda stanowi znaczący postęp w porównaniu z tradycyjnym miareczkowaniem laboratoryjnym, które jest powolne i wykorzystuje substancje chemiczne wymagające odpowiedniej utylizacji. Możliwość monitorowania wielu punktów procesu przez system NIR w czasie rzeczywistym z jednego analizatora zapewnia znaczną przewagę pod względem wydajności i bezpieczeństwa. Stosunek NCO/OH to nie tylko zmienna procesowa; jest on bezpośrednim czynnikiem determinującym właściwości produktu końcowego, w tym wytrzymałość na rozciąganie, moduł sprężystości i twardość. Dostarczając ciągłe dane w czasie rzeczywistym dotyczące tego krytycznego stosunku, czujnik NIR umożliwia proaktywną regulację szybkości podawania materiału. To przekształca proces kontroli z reaktywnego podejścia opartego na defektach w proaktywną strategię jakości w fazie projektowania, w której precyzyjny stosunek NCO/OH jest utrzymywany przez cały czas reakcji, gwarantując wysoką jakość rezultatów.

2.3. Analiza dielektryczna (DEA) do monitorowania stanu utwardzania

Analiza dielektryczna (DEA), znana również jako analiza termiczna dielektryka (DETA), to zaawansowana technika monitorowania „niewidocznego utwardzania w formie”, kluczowego dla jakości produktu końcowego. Bezpośrednio mierzy zmiany lepkości i stanu utwardzania materiału poprzez przyłożenie napięcia sinusoidalnego i pomiar wynikających z tego zmian ruchliwości nośników ładunku (jonów i dipoli). W miarę utwardzania materiału jego lepkość gwałtownie wzrasta, a ruchliwość tych nośników ładunku maleje, zapewniając bezpośrednią, wymierną miarę postępu utwardzania.

DEA pozwala precyzyjnie określić punkt żelowania i koniec procesu utwardzania, nawet w przypadku systemów szybkoutwardzalnych. Oferuje on zniuansowany obraz, który uzupełnia inne technologie. Podczas gdy wiskozymetr liniowy mierzy całkowitą lepkość materiału, czujnik DEA zapewnia wgląd w postęp reakcji sieciowania na poziomie chemicznym. Połączeniewiskozymetr liniowy(pomiarwynikleczenia) i czujnik DEA (mierzącypostęp(metoda leczenia) zapewnia kompleksowy, dwupoziomowy obraz procesu, który umożliwia wysoce precyzyjną kontrolę i diagnostykę. DEA może być również wykorzystywana do monitorowania skuteczności różnych dodatków i wypełniaczy.

Porównanie tych technologii podkreśla ich komplementarny charakter. Żaden pojedynczy czujnik nie jest w stanie zapewnić pełnego obrazu złożonej reakcji poliuretanu. Kompleksowe rozwiązanie wymaga integracji wielu czujników w celu jednoczesnego monitorowania różnych właściwości fizycznych i chemicznych.

| Monitorowany parametr | Zasada technologii | Podstawowe przypadki użycia |

| Lepkość, temperatura | Wiskozymetr widełkowy wibracyjny | Kontrola jakości surowców, monitorowanie reakcji w czasie rzeczywistym, wykrywanie punktów końcowych. |

| %NCO, liczba hydroksylowa | Spektroskopia bliskiej podczerwieni (NIR) | Monitorowanie składu chemicznego w czasie rzeczywistym, kontrola proporcji podawania, optymalizacja katalizatora. |

| Stan utwardzony, punkt żelowy | Analiza dielektryczna (DEA) | Monitorowanie utwardzania w formie, weryfikacja czasu żelowania, analiza skuteczności dodatków. |

Tabela 2.1: Porównanie zaawansowanych technologii monitorowania w linii produkcyjnej poliuretanów

III. Ramy modelowania ilościowego predykcyjnego

Bogate strumienie danych z zaawansowanych technologii monitorowania są warunkiem wstępnym digitalizacji, ale ich pełna wartość ujawnia się dopiero po wykorzystaniu ich do budowy ilościowych modeli predykcyjnych. Modele te przekształcają surowe dane w praktyczne wnioski, umożliwiając głębsze zrozumienie procesu i przejście w kierunku proaktywnej optymalizacji.

3.1. Modelowanie chemo-reologiczne i kinetyki utwardzania

Samo gromadzenie danych z czujników nie wystarczy do uzyskania rzeczywistej kontroli nad procesem; dane te muszą zostać wykorzystane do zbudowania modelu wyjaśniającego podstawowe zachowanie reakcji chemicznej. Modele chemo-reologiczne i kinetyki utwardzania łączą konwersję chemiczną ze zmianami fizycznymi, takimi jak wzrost lepkości i czas żelowania. Modele te są szczególnie cenne w przypadku systemów szybko utwardzających się, w których przejściowy charakter zjawiska utrudnia tradycyjną analizę.5

Metody izokonwersyjne, znane również jako metody bezmodelowe, można stosować do danych nieizotermicznych w celu przewidywania kinetyki reakcji żywic szybkoutwardzalnych. Modele takie obejmują silnie sprzężoną analizę termo-chemo-reologiczną, co oznacza, że uwzględniają one wzajemne oddziaływanie temperatury, składu chemicznego i właściwości przepływu materiału. Dzięki matematycznemu odwzorowaniu całej reakcji, modele te wykraczają poza proste monitorowanie, zapewniając rzeczywiste zrozumienie procesu. Potrafią przewidywać, jak lepkość będzie się zmieniać w czasie dla danego profilu temperaturowego lub jak zmiana katalizatora wpłynie na szybkość reakcji, stanowiąc zaawansowane narzędzie do kontroli i optymalizacji.

3.2. Analiza chemometryczna i regresja wieloczynnikowa

Produkcja poliuretanu to proces wielowymiarowy, w którym wiele czynników oddziałuje na siebie, aby określić jakość produktu końcowego. Tradycyjne eksperymenty jednoczynnikowe są czasochłonne i nie pozwalają na uchwycenie złożonych, nieliniowych zależności między zmiennymi. Techniki chemometryczne, takie jak regresja metodą cząstkowych najmniejszych kwadratów (PLS) i metodologia powierzchni odpowiedzi (RSM), zostały opracowane w celu rozwiązania tego problemu.

Regresja metodą cząstkowych najmniejszych kwadratów (PLS) to technika doskonale nadająca się do analizy dużych, skorelowanych zbiorów danych, takich jak te generowane przez spektrometr NIR w czasie rzeczywistym. PLS redukuje problem z dużej liczby powiązanych ze sobą zmiennych do niewielkiej liczby wyodrębnionych czynników, co czyni ją doskonałą do celów predykcyjnych. W kontekście produkcji poliuretanów, PLS może być wykorzystywana do diagnozowania problemów procesowych i ujawniania przestrzennego zróżnicowania zmiennych jakościowych w obrębie produktu.

Metodologia Powierzchni Odpowiedzi (RSM) to potężna metoda matematyczna i statystyczna, przeznaczona do modelowania i optymalizacji warunków eksperymentalnych. RSM umożliwia analizę łącznego wpływu wielu czynników – takich jak stosunek NCO/OH, współczynnik wydłużenia łańcucha i temperatura utwardzania – na pożądaną zmienną odpowiedzi, taką jak wytrzymałość na rozciąganie. Strategicznie rozmieszczając punkty eksperymentalne w obszarach krytycznych, RSM pozwala dokładnie scharakteryzować leżące u ich podstaw zależności nieliniowe i interakcje między czynnikami. Badanie wykazało skuteczność tego podejścia, a model przewidywał właściwości końcowe z imponującym błędem dokładności wynoszącym zaledwie 2,2%, co stanowi przekonującą walidację metodologii. Możliwość odwzorowania całej „powierzchni odpowiedzi” dla metryki jakości pozwala inżynierowi na jednoczesne zidentyfikowanie optymalnej kombinacji wszystkich czynników, co prowadzi do uzyskania lepszego rozwiązania.

3.3. Cyfrowy bliźniak procesu produkcyjnego

Cyfrowy bliźniak to dynamiczna, wirtualna replika fizycznego zasobu, systemu lub procesu. W przemyśle chemicznym replika ta jest zasilana danymi w czasie rzeczywistym z czujników IoT i modeli predykcyjnych. Służy jako żywa, wierna symulacja linii produkcyjnej. Prawdziwa wartość cyfrowego bliźniaka tkwi w jego zdolności do zapewnienia środowiska o niskim ryzyku dla optymalizacji o wysokiej stawce.

Produkcja poliuretanu jest kosztownym procesem ze względu na drogie surowce i wysokie zużycie energii. Przeprowadzanie eksperymentów fizycznych w celu optymalizacji procesu jest zatem przedsięwzięciem obarczonym wysokim ryzykiem i wysokimi kosztami. Cyfrowy bliźniak bezpośrednio rozwiązuje ten problem, umożliwiając inżynierom przeprowadzenie tysięcy scenariuszy „co by było, gdyby” na modelu wirtualnym, bez zużycia surowców ani czasu produkcji. Taka możliwość nie tylko przyspiesza wprowadzanie nowych formulacji na rynek, ale także znacznie obniża koszty i ryzyko optymalizacji procesów. Co więcej, cyfrowe bliźniaki mogą wypełnić lukę między nowymi technologiami cyfrowymi a starszymi, przestarzałymi systemami, integrując dane w czasie rzeczywistym z istniejącej infrastruktury, zapewniając ujednolicone środowisko cyfrowe bez konieczności przeprowadzania gruntownego remontu.

IV. Sztuczna inteligencja/uczenie maszynowe w sterowaniu procesami i wykrywaniu anomalii

Modele predykcyjne przekształcają dane w wiedzę, ale sztuczna inteligencja (AI) i uczenie maszynowe (ML) idą o krok dalej: przekształcają wiedzę w autonomiczne działanie i inteligentne sterowanie.

4.1. Systemy wykrywania anomalii i błędów

Tradycyjne systemy sterowania procesami opierają się na statycznych, zakodowanych progach, które wyzwalają alarmy. Takie podejście jest podatne na błędy, ponieważ może nie wykrywać stopniowych odchyleń, które mieszczą się w akceptowalnym zakresie, lub generować uciążliwe alarmy, które uniewrażliwiają operatorów. Wykrywanie anomalii oparte na sztucznej inteligencji stanowi istotną zmianę paradygmatu. Systemy te są trenowane na danych historycznych, aby uczyć się normalnych wzorców działania procesu. Następnie mogą automatycznie identyfikować i sygnalizować wszelkie odchylenia od tego wyuczonego wzorca, nawet jeśli parametr nie przekroczył jeszcze statycznego progu.

Na przykład stopniowy, ale stały wzrost lepkości w określonym przedziale czasowym, choć wciąż mieszczący się w dopuszczalnym zakresie, może być zwiastunem zbliżającego się problemu, którego tradycyjny system by nie wykrył. System wykrywania anomalii oparty na sztucznej inteligencji rozpoznałby to jako nietypowy wzorzec i generował wczesne ostrzeżenie, umożliwiając zespołowi podjęcie proaktywnych działań w celu zapobieżenia wadliwej partii. Ta funkcja znacznie usprawnia kontrolę jakości poprzez wykrywanie odchyleń od pożądanych specyfikacji, zmniejszając ryzyko wadliwych produktów i zapewniając zgodność z wymaganiami.

4.2. Konserwacja predykcyjna zasobów krytycznych

Nieplanowane przestoje stanowią jeden z największych kosztów w produkcji przemysłowej. Tradycyjne strategie konserwacji są albo reaktywne („napraw, gdy się zepsuje”), albo oparte na czasie (np. wymiana pompy co sześć miesięcy, niezależnie od jej stanu). Konserwacja predykcyjna, oparta na modelach uczenia maszynowego, stanowi znacznie lepszą alternatywę.

Dzięki ciągłej analizie danych w czasie rzeczywistym z czujników (np. wibracji, temperatury, ciśnienia), modele te mogą identyfikować wczesne oznaki degradacji sprzętu i przewidywać potencjalne awarie. System może zapewnić „prognozę czasu do awarii”, umożliwiając zespołowi planowanie napraw podczas planowanego przestoju z tygodniowym, a nawet miesięcznym wyprzedzeniem. Eliminuje to kosztowne przestoje spowodowane nieoczekiwaną awarią i pozwala na lepsze planowanie siły roboczej, części i logistyki. Zwrot z inwestycji (ROI) w przypadku tego podejścia jest znaczny i dobrze udokumentowany w studiach przypadków. Na przykład rafineria osiągnęła trzykrotnie wyższy zwrot z inwestycji (ROI) dzięki wdrożeniu proaktywnego programu kontroli, a firma naftowo-gazowa zaoszczędziła miliony dolarów dzięki systemowi wczesnego ostrzegania, który wykrywał nieprawidłowości w sprzęcie. Te wymierne korzyści finansowe uzasadniają przejście ze strategii konserwacji reaktywnej na predykcyjną.

4.3. Predykcyjna kontrola jakości

Predykcyjna kontrola jakości radykalnie zmienia rolę zapewnienia jakości z kontroli poprodukcyjnej na proaktywną funkcję w trakcie procesu. Zamiast czekać na przetestowanie produktu końcowego pod kątem właściwości, takich jak twardość czy wytrzymałość na rozciąganie, modele uczenia maszynowego mogą stale analizować dane procesowe w czasie rzeczywistym ze wszystkich czujników, aby z dużą dozą pewności prognozować, jakie będą końcowe parametry jakościowe.

Predykcyjny model jakości może identyfikować złożone zależności między jakością surowca, parametrami procesu i warunkami środowiskowymi, aby określić optymalne ustawienia produkcji dla uzyskania pożądanego rezultatu. Jeśli model przewiduje, że produkt końcowy będzie niezgodny ze specyfikacją (np. zbyt miękki), może ostrzec operatora, a nawet automatycznie dostosować parametr procesu (np. szybkość podawania katalizatora), aby skorygować odchylenie w czasie rzeczywistym. Ta funkcja nie tylko pomaga zapobiegać wadom, zanim wystąpią, ale także przyspiesza badania i rozwój, zapewniając szybsze prognozowanie właściwości i identyfikację ukrytych wzorców w danych. Takie podejście jest strategicznym imperatywem dla producentów dążących do maksymalizacji wydajności i poprawy efektywności operacyjnej.

V. Plan wdrożenia technicznego

Wdrożenie tych zaawansowanych rozwiązań wymaga ustrukturyzowanego, etapowego podejścia, uwzględniającego złożoność integracji danych i istniejącej infrastruktury. Dobrze zdefiniowany plan działania jest niezbędny do ograniczenia ryzyka i szybkiego osiągnięcia zwrotu z inwestycji (ROI).

5.1. Etapowe podejście do transformacji cyfrowej

Udana transformacja cyfrowa nie powinna zaczynać się od gruntownej przebudowy. Wysokie początkowe koszty inwestycyjne i złożoność integracji nowych systemów mogą być nieopłacalne, szczególnie dla małych i średnich przedsiębiorstw. Bardziej efektywnym podejściem jest wdrożenie etapowe, zaczynając od Proof of Concept (PoC) na pojedynczej pilotażowej linii produkcyjnej. Ten projekt o niskim ryzyku i niewielkiej skali pozwala firmie przetestować interoperacyjność nowych czujników i oprogramowania z istniejącą infrastrukturą oraz ocenić wydajność przed podjęciem decyzji o szerszym wdrożeniu. Skwantyfikowany zwrot z inwestycji (ROI) z tego początkowego sukcesu może następnie posłużyć do zbudowania przekonującego uzasadnienia biznesowego dla szerszego wdrożenia. Takie podejście jest zgodne z podstawowymi zasadami Przemysłu 4.0, które kładą nacisk na interoperacyjność, możliwości działania w czasie rzeczywistym i modułowość.

5.2. Architektura zarządzania danymi i integracji

Solidna infrastruktura danych stanowi fundament wszystkich rozwiązań predykcyjnych i opartych na sztucznej inteligencji. Architektura danych musi być w stanie obsłużyć ogromną ilość i różnorodność danych generowanych przez inteligentną fabrykę. Zazwyczaj wymaga to podejścia warstwowego, obejmującego historyka danych i jezioro danych.

Historyk danych:Historyk danych to specjalistyczna baza danych przeznaczona do gromadzenia, przechowywania i zarządzania ogromnymi ilościami danych szeregów czasowych z procesów przemysłowych. Pełni funkcję skrupulatnie zorganizowanego archiwum cyfrowego, rejestrując każdą zmianę temperatury, odczyt ciśnienia i natężenie przepływu z precyzyjnym znacznikiem czasu. Historyk danych to optymalne narzędzie do obsługi dużych, ciągłych strumieni danych z czujników procesowych i stanowi „idealne paliwo” dla zaawansowanej analityki.

Jezioro danych:Jezioro danych to centralne repozytorium, które przechowuje surowe dane w ich natywnym formacie i może obsługiwać różne typy danych, w tym ustrukturyzowane dane szeregów czasowych, nieustrukturyzowane obrazy z wysokiej jakości kamer oraz logi maszynowe. Jezioro danych zostało zaprojektowane z myślą o obsłudze ogromnych ilości zróżnicowanych danych ze wszystkich zakątków przedsiębiorstwa, umożliwiając bardziej holistyczny, kompleksowy wgląd. Skuteczna implementacja wymaga zarówno historyka danych dla danych procesów podstawowych, jak i jeziora danych dla szerszego, kompleksowego wglądu, który umożliwia złożoną analizę, taką jak analiza przyczyn źródłowych i korelacja z danymi niepochodzącymi z czujników.

Logiczna architektura warstwowa służąca do integracji danych wyglądałaby następująco:

| Warstwa | Część | Funkcjonować | Typ danych |

| Krawędź | Czujniki IoT, bramy, sterowniki PLC | Zbieranie danych w czasie rzeczywistym i przetwarzanie lokalne | Szeregi czasowe, binarne, dyskretne |

| Fundacja Danych | Historyk danych | Wysokowydajne przechowywanie danych procesowych ze znacznikami czasu | Ustrukturyzowane szeregi czasowe |

| Centralne Repozytorium | Jezioro danych | Centralne, skalowalne repozytorium dla wszystkich źródeł danych | Ustrukturyzowane, półustrukturyzowane, nieustrukturyzowane |

| Analityka i sztuczna inteligencja | Platforma analityczna | Uruchamia modele predykcyjne, uczenie maszynowe i analizę biznesową | Wszystkie typy danych |

Tabela 5.1: Kluczowe komponenty integracji i zarządzania danymi

5.3. Rozwiązywanie problemów związanych z integracją starszych systemów

Wiele zakładów chemicznych nadal korzysta z systemów technologii operacyjnej (OT) sprzed ponad dekady, które często wykorzystują zastrzeżone protokoły niezgodne z nowoczesnymi standardami. Wymiana tych starszych systemów, takich jak rozproszone systemy sterowania (DCS) czy programowalne sterowniki logiczne (PLC), to projekt wart wiele milionów dolarów, który może spowodować znaczne przestoje w produkcji. Bardziej praktycznym i ekonomicznym rozwiązaniem jest wykorzystanie bramek IoT i interfejsów API jako pomostu.

Bramy IoT działają jako pośrednicy, tłumacząc dane z nowych czujników IoT na format zrozumiały dla starszych systemów. Umożliwiają one firmie wdrożenie zaawansowanego monitoringu bez konieczności gruntownej modernizacji, bezpośrednio rozwiązując problem bariery kosztów i znacznie zwiększając dostępność proponowanych rozwiązań. Ponadto wdrożenie przetwarzania brzegowego (edge computing), gdzie dane są przetwarzane bezpośrednio u źródła, może zmniejszyć przepustowość sieci i poprawić responsywność w czasie rzeczywistym.

5.4. Decyzja: architektura lokalna czy chmurowa

Decyzja o tym, gdzie hostować platformy danych i analiz, jest kluczowa i ma istotny wpływ na koszty, bezpieczeństwo i skalowalność. Wybór nie jest prostym „albo-albo”, ale powinien opierać się na dokładnej analizie konkretnych przypadków użycia.

| Kryterium | Na miejscu | Chmura |

| Kontrola | Pełna kontrola nad sprzętem, oprogramowaniem i zabezpieczeniami. Idealne dla branż o wysokim poziomie regulacji. | Mniej bezpośredniej kontroli; model współodpowiedzialności. |

| Koszt | Wysokie początkowe koszty sprzętu; amortyzacja i konserwacja leżą w gestii firmy. | Niższe koszty początkowe dzięki modelowi „płać za to, z czego korzystasz”. |

| Skalowalność | Ograniczona elastyczność; wymaga ręcznego tworzenia rezerw i inwestycji kapitałowych w celu zwiększenia skali. | Ogromna skalowalność i elastyczność; możliwość dynamicznego skalowania w górę i w dół. |

| Utajenie | Niskie opóźnienie, gdyż dane znajdują się fizycznie blisko źródła. | Mogą występować nadmierne opóźnienia w przypadku niektórych obciążeń sterowania w czasie rzeczywistym. |

| Innowacja | Wolniejszy dostęp do nowych technologii; konieczność ręcznych aktualizacji oprogramowania i sprzętu. | Szybko rozszerzający się zestaw funkcji wraz z innowacjami takimi jak sztuczna inteligencja i uczenie maszynowe. |

| Bezpieczeństwo | Przedsiębiorstwo ponosi wyłączną odpowiedzialność za wszelkie praktyki bezpieczeństwa. | Współodpowiedzialność z dostawcą, który obsługuje wiele warstw bezpieczeństwa. |

Tabela 5.2: Macierz decyzyjna: chmura czy instalacja lokalna

Skuteczna strategia cyfrowa często opiera się na modelu hybrydowym. Krytyczne dla misji, pętle sterowania o niskim opóźnieniu i wysoce zastrzeżone dane o formulacjach mogą być przechowywane lokalnie, zapewniając maksymalne bezpieczeństwo i kontrolę. Jednocześnie platforma w chmurze może służyć jako scentralizowane jezioro danych, umożliwiające długoterminową analizę historyczną, współpracę badawczą z partnerami zewnętrznymi oraz dostęp do najnowocześniejszych narzędzi sztucznej inteligencji i uczenia maszynowego.

VI. Praktyczny podręcznik optymalizacji i diagnostyki

Prawdziwą wartość zaawansowanego monitorowania i modelowania można docenić, gdy wykorzystuje się je do tworzenia praktycznych narzędzi dla kierowników produkcji i inżynierów. Narzędzia te mogą zautomatyzować i usprawnić proces podejmowania decyzji, przechodząc od reaktywnego rozwiązywania problemów do proaktywnego sterowania opartego na modelach.

6.1. Modelowo sterowana struktura diagnostyczna

W tradycyjnym środowisku produkcyjnym rozwiązywanie problemów z defektami to czasochłonny, ręczny proces, który wymaga doświadczenia operatora i metody prób i błędów. Oparta na modelu platforma diagnostyczna automatyzuje ten proces, wykorzystując dane w czasie rzeczywistym i wyniki modeli do natychmiastowej identyfikacji najbardziej prawdopodobnej przyczyny problemu.

System działa jak drzewo decyzyjne lub logiczny schemat blokowy. W przypadku wykrycia symptomu defektu (np. nieprawidłowego odczytu lepkości z wiskozymetru inline), system automatycznie koreluje ten symptom z danymi z innych czujników (np. temperatury, stosunku NCO/OH) oraz wynikami modeli predykcyjnych (np. modelu RSM dla twardości). System może następnie przedstawić operatorowi listę potencjalnych przyczyn źródłowych z priorytetem, skracając czas diagnozy z godzin do minut i umożliwiając znacznie szybsze podjęcie działań korygujących. Takie podejście pozwala odejść od prostego znalezienia defektu i proaktywnie identyfikować i korygować problem.

Rysunek 6.1: Uproszczony schemat blokowy ilustrujący proces wykorzystywania danych z czujników w czasie rzeczywistym i modeli predykcyjnych do kierowania operatorów na konkretną przyczynę źródłową i działania naprawcze.

Podejście to można podsumować w postaci matrycy diagnostycznej, która stanowi szybki przewodnik dla grupy docelowej.

| Wada/Objaw | Odpowiedni strumień danych | Prawdopodobna przyczyna źródłowa |

| Niespójna twardość | Stosunek NCO/OH, profil temperaturowy | Nieprawidłowy stosunek materiałów, nierównomierny profil temperaturowy |

| Słaba przyczepność | Temperatura powierzchni, wilgotność | Niewłaściwe przygotowanie powierzchni, zakłócenia wilgoci środowiskowej |

| Bąbelki lub skazy | Profil lepkości, temperatura | Składniki lotne, nieprawidłowe mieszanie lub profil cieplny |

| Niespójny czas utwardzania | Stosunek NCO/OH, temperatura, szybkość podawania katalizatora | Nieprawidłowe stężenie katalizatora, wahania temperatury |

| Osłabiona struktura | Czas żelowania, profil lepkości | Niedostateczne ciepło, miejscowe kurczenie się w chłodnym obszarze |

Tabela 6.2: Macierz diagnostyczna defektu do wglądu

6.2. Inteligentne standardowe procedury operacyjne (SOP)

Tradycyjne Standardowe Procedury Operacyjne (SOP) to statyczne, papierowe dokumenty, które stanowią sztywny, krok po kroku przewodnik po procesach produkcyjnych. Choć są one niezbędne do standaryzacji operacji i zapewnienia zgodności, nie są w stanie uwzględniać odchyleń w procesach w czasie rzeczywistym. „Inteligentne SOP” to nowa, dynamiczna generacja procedur, zintegrowana z danymi procesowymi na żywo.

Na przykład, tradycyjna procedura operacyjna (SOP) dla procesu mieszania może określać stałą temperaturę i czas mieszania. Z kolei inteligentna procedura SOP byłaby powiązana z czujnikami temperatury i lepkości mierzącymi temperaturę w czasie rzeczywistym. Jeśli czujnik wykryje spadek temperatury otoczenia, inteligentna procedura SOP mogłaby dynamicznie dostosować wymagany czas lub temperaturę mieszania, aby skompensować zmianę, zapewniając stałą jakość produktu końcowego. Dzięki temu procedura SOP jest dynamicznym, adaptacyjnym dokumentem, który pomaga operatorom podejmować optymalne decyzje w płynnym środowisku w czasie rzeczywistym, minimalizując zmienność, redukując błędy i poprawiając ogólną wydajność.

6.3. Optymalizacja pętli sterowania

Pełna wartość czujników i modeli predykcyjnych ujawnia się po ich zintegrowaniu z systemem aktywnie sterującym procesem. Wymaga to stosowania najlepszych praktyk w zakresie dostrajania pętli sterowania i wdrażania zaawansowanych strategii sterowania.

Optymalizacja pętli sterowania to systematyczny proces, który rozpoczyna się od dogłębnego zrozumienia procesu, zdefiniowania celu sterowania, a następnie wykorzystania danych w czasie rzeczywistym do dostrojenia pętli. Zaawansowane strategie sterowania procesem (APC), takie jak sterowanie kaskadowe i sterowanie z wyprzedzeniem, mogą być stosowane w celu poprawy stabilności i responsywności. Ostatecznym celem jest zamknięcie cyklu „od danych do działania”: wbudowany czujnik NIR dostarcza w czasie rzeczywistym dane o stosunku NCO/OH, model predykcyjny prognozuje wynik, a pętla sterowania wykorzystuje te informacje do automatycznej regulacji pompy zasilającej izocyjanianem, utrzymując optymalny stosunek i eliminując zmienność. Ciągły monitoring wydajności pętli ma kluczowe znaczenie dla wykrycia dryftu, identyfikacji problemów z czujnikami i określenia, kiedy należy dokonać ponownego dostrojenia, zanim wydajność procesu ulegnie pogorszeniu.

VII. Studia przypadków i najlepsze praktyki

Korzyści płynące z zaawansowanego monitorowania i modelowania ilościowego nie są jedynie teoretyczne; potwierdzają je rzeczywiste sukcesy i wymierny zwrot z inwestycji (ROI). Doświadczenia liderów branży dostarczają cennych lekcji i przekonujących argumentów biznesowych za cyfryzacją.

7.1. Lekcje od liderów branży

Działania dużych firm chemicznych na rzecz cyfryzacji pokazują wyraźną tendencję: sukces jest efektem holistycznej, kompleksowej strategii, a nie fragmentarycznego podejścia.

DuPont:Dostrzeżono potrzebę odpornego łańcucha dostaw na niestabilnym rynku i wdrożono dostosowaną platformę cyfrową do modelowania scenariuszy „co by było, gdyby”. Umożliwiło to podejmowanie trafniejszych decyzji biznesowych i efektywną dystrybucję ponad 1000 produktów z ulepszonymi możliwościami predykcyjnymi. Lekcja jest taka, że połączenie rozproszonych systemów – od łańcucha dostaw po operacje – w scentralizowaną platformę zapewnia kompleksowy obraz całego łańcucha wartości.

Covestro:Wdrożono globalną strategię digitalizacji przedsiębiorstwa, aby stworzyć scentralizowane „pojedyncze źródło prawdy” dla danych projektowych, rezygnując z uzależnienia od arkuszy kalkulacyjnych. To zintegrowane podejście pozwoliło zaoszczędzić 90% czasu poświęcanego wcześniej na ręczne gromadzenie i walidację danych oraz znacznie zwiększyło niezawodność. Firma wykorzystała również digitalizację, aby szybciej opracowywać nowe produkty oraz poprawić ich jakość i rentowność produkcji.

SABIC:Wdrożyliśmy platformę Digital Operations Platform w całej firmie, która integruje dane dotyczące jakości surowców, parametrów procesów i warunków środowiskowych z cyfrowymi narzędziami predykcyjnymi. Na przykład, rozwiązanie do zarządzania zasobami, oparte na sztucznej inteligencji, działa w zakładach firmy na całym świecie, przewidując potencjalne awarie krytycznego sprzętu i umożliwiając proaktywną konserwację. To holistyczne podejście przyczyniło się do poprawy efektywności energetycznej, niezawodności zasobów i zasięgu operacyjnego.

7.2. Zwrot z inwestycji i wymierne korzyści

Inwestycja w te technologie to strategiczna decyzja biznesowa, która przynosi wyraźne i znaczące korzyści. Studia przypadków z różnych branż przekonująco potwierdzają korzyści finansowe i operacyjne.

Analityka predykcyjna:Oprogramowanie AVEVA Predictive Analytics pozwoliło na osiągnięcie oszczędności rzędu 37 milionów dolarów w ciągu 24 miesięcy, przy 10% redukcji kosztów konserwacji i wyeliminowaniu 3000 godzin konserwacji rocznie. Firma naftowo-gazowa zaoszczędziła 33 miliony dolarów, wykorzystując chmurowy system wczesnego ostrzegania do wykrywania anomalii w sprzęcie. Program rafinerii przyniósł 3-krotny zwrot z inwestycji (ROI) i bezpiecznie zmniejszył liczbę punktów monitorowania korozji o 27,4%.

Poprawa wydajności:Producent chemikaliów specjalistycznych stanął przed wyzwaniami związanymi z redukcją kosztów operacyjnych i poprawą przewidywalności produkcji. Dzięki wdrożeniu kompleksowej analizy w celu zidentyfikowania możliwości poprawy, osiągnął znaczący zwrot z inwestycji (ROI) na poziomie 2,7:1, przy jednoczesnej poprawie wydajności jednostkowej surowca i wzroście produkcji jednostkowej.

Bezpieczeństwo i logistyka:Zakład gazowy był w stanie skrócić czas ewakuacji i zbiórek o 70% dzięki automatyzacji po wielokrotnych niepowodzeniach w audytach bezpieczeństwa. Platforma cyfrowa SABIC zautomatyzowała ręczne procesy dokumentowania, które wcześniej zajmowały cztery dni, skracając czas do zaledwie jednego dnia, eliminując główne wąskie gardła i unikając opłat za przestoje.

Wyniki te pokazują, że proponowane strategie nie są abstrakcyjną koncepcją, ale sprawdzoną, wymierną drogą do osiągnięcia większej rentowności, wydajności i bezpieczeństwa.

7.3. Studium przypadku teoretycznego: optymalizacja stosunku NCO/OH

To ostatnie studium przypadku ilustruje, w jaki sposób koncepcje przedstawione w niniejszym raporcie można zastosować w ramach jednej, spójnej narracji, aby rozwiązać powszechny, kosztowny problem w produkcji poliuretanów.

Scenariusz:Producent powłok poliuretanowych doświadcza rozbieżności między partiami w zakresie twardości i czasu utwardzania produktu końcowego. Tradycyjne testy laboratoryjne są zbyt powolne, aby zdiagnozować problem na czas i uratować partię, co prowadzi do znacznych strat materiału. Zespół podejrzewa, że przyczyną jest wahający się stosunek NCO/OH.

Rozwiązanie:

Monitorowanie w czasie rzeczywistym:Zespół instaluje czujnik spektroskopii NIR w czasie rzeczywistym w linii zasilającej, aby stale monitorować stosunek NCO/OH.2Dane z tego czujnika przesyłane są strumieniowo do rejestratora danych, co umożliwia ciągły i dokładny zapis tego krytycznego parametru.

Modelowanie ilościowe:Wykorzystując historyczne dane NIR, zespół opracowuje model RSM, który określa precyzyjną zależność między stosunkiem NCO/OH a twardością i czasem utwardzania produktu końcowego. Model ten pozwala im określić optymalny stosunek, aby uzyskać pożądane właściwości, oraz przewidzieć końcową jakość partii, gdy znajduje się ona jeszcze w reaktorze.

Wykrywanie anomalii wspomagane sztuczną inteligencją:Model wykrywania anomalii oparty na sztucznej inteligencji (AI) jest wdrażany w strumieniu danych z czujnika NIR. Model uczy się normalnego profilu działania dla stosunku NCO/OH. Jeśli wykryje odchylenie od tego wyuczonego wzorca – nawet niewielkie, stopniowe dryftowanie – wysyła wczesne ostrzeżenie do zespołu produkcyjnego. Zapewnia to alert na kilka tygodni przed wykryciem problemu przez tradycyjne próbkowanie laboratoryjne.

Zautomatyzowana kontrola procesów:Ostatnim krokiem jest zamknięcie pętli. Wdrażany jest predykcyjny system sterowania, który wykorzystuje dane z czujnika NIR w czasie rzeczywistym do automatycznej regulacji pompy zasilającej izocyjanian. Eliminuje to czynnik ludzki i zapewnia utrzymanie optymalnego stosunku NCO/OH przez cały czas trwania reakcji, eliminując zmienność i gwarantując stałą jakość.

Dzięki zastosowaniu tych kompleksowych ram producent może przejść od reaktywnego modelu produkcji opartego na błędach do modelu proaktywnego, opartego na danych, zapewniając, że każda partia spełnia standardy jakości, redukując ilość odpadów i zwiększając ogólną rentowność.

Czas publikacji: 08.09.2025