Produksjonen av polyuretanbelegg og lim (PU) er en kompleks prosess i flere trinn som styres av sensitive kjemiske reaksjoner. Selv om etterspørselen etter disse materialene fortsetter å vokse på tvers av bransjer, presenterer produksjonen en rekke kjerneutfordringer som direkte påvirker produktkvalitet, produksjonseffektivitet og generell lønnsomhet. En grundig forståelse av disse grunnleggende problemstillingene er avgjørende for å utvikle en strategisk og praktisk plan for forbedring.

1.1. Iboende kjemisk kompleksitet og variasjon: Utfordringen med rask herding

Polyuretanproduksjon er en polyaddisjonsreaksjon mellom polyoler og isocyanater, en prosess som ofte er rask og svært eksoterm. Hastigheten og varmen som genereres av denne reaksjonen gjør presis kontroll usedvanlig vanskelig. Den iboende kompleksiteten forverres ytterligere av reaksjonens følsomhet for eksterne faktorer som temperatur, fuktighet og tilstedeværelsen av katalysatorer. Små, ukontrollerte svingninger i disse miljøforholdene eller materialtilførselen kan føre til betydelige variasjoner i sluttproduktets egenskaper, inkludert herdetid og fysisk ytelse.

En fundamental utfordring i denne sammenhengen er den "korte brukstiden" til mange hurtigherdende PU-systemer. Tidsskalaene for gassproduksjon og PU-tverrbinding er ofte for korte til å være kompatible med tradisjonelle karakteriseringsmetoder. Dette er et sentralt teknisk og økonomisk problem. Tradisjonelle kvalitetskontrollprosedyrer (QC), som innebærer å ta en prøve fra reaktoren og transportere den til et laboratorium for analyse, er iboende mangelfulle. Prosessen med laboratorietitrering er langsom, og kritisk nok begynner prøvens kjemiske egenskaper å endre seg i det øyeblikket den fjernes fra reaktoren og eksponeres for omgivelsesforhold. Denne latensen betyr at laboratorieresultatene er en post mortem-analyse av et parti som allerede er produsert. Dataene er ikke bare ikke-handlingsrettede, da de kommer for sent til å tillate intervensjon, men også potensielt unøyaktige, ettersom de ikke lenger representerer materialets tilstand inne i produksjonsbeholderen. Denne fundamentale inkompatibiliteten mellom tradisjonell, forsinkelsesbasert kvalitetskontroll og den raske kinetikken til PU-kjemi er det primære problemet som avansert overvåking og modellering må løse.

1.2. De grunnleggende årsakene til inkonsekvens i batcher og defektdannelse

Inkonsistens fra batch til batch og dannelse av defekter er ikke tilfeldige hendelser, men en direkte konsekvens av mangel på presisjon i kontrollen av kritiske prosessparametere. Sluttproduktet er svært følsomt for komponentforholdet, blandeteknikken og temperaturprofilen gjennom hele prosessen. En feil blanding kan for eksempel føre til ujevnt fordelte fyllstoffer eller herdere, noe som forårsaker "innebygde spenninger" og defekter i sluttproduktet.

Presisjonen i råmaterialetilførselen, spesielt molforholdet mellom isocyanat (NCO) og hydroksylgrupper (OH), er avgjørende for å opprettholde kvalitetskontinuitet. Dette NCO/OH-forholdet er en direkte determinant for sluttproduktets egenskaper. Etter hvert som forholdet øker, øker også viktige fysiske egenskaper som strekkfasthet, modul og hardhet. Forholdet påvirker også materialets viskositet og herdeegenskaper. Andre kritiske prosessforhold, som varmeprofilen, er like viktige. Utilstrekkelig eller ikke-jevn oppvarming kan forårsake ujevn herding og lokal krymping, mens flyktige komponenter kan avflamme, noe som fører til bobler og flekker.

En detaljert analyse av årsakene til defekter viser at en enkelt sensor eller parameter ofte er utilstrekkelig for nøyaktig diagnose. Et problem som «Ingen gel eller herder ikke» kan være forårsaket av feil blandingsforhold, utilstrekkelig varme eller feil blanding. Disse årsakene er ofte sammenhengende. For eksempel vil en for lav temperatur forsinke herdeprosessen og kan feilaktig diagnostiseres som et problem med materialforholdet. For å virkelig forstå og adressere årsaken er det nødvendig å måle flere parametere samtidig. Dette krever en omfattende sensorpakke som kan korrelere sanntidsdata fra ulike kilder for å isolere den sanne årsaksfaktoren fra de resulterende symptomene, en oppgave som ligger utenfor rammen av tradisjonell enkeltpunktsovervåking.

1.3. Økonomisk og miljømessig innvirkning av ineffektivitet

De tekniske utfordringene i polyuretanproduksjon har direkte og betydelige økonomiske og miljømessige konsekvenser. Råvarer av høy kvalitet, som polyoler og isocyanater, er dyre, og prisene deres varierer på grunn av brudd i forsyningskjeden, avhengighet av råolje og global etterspørsel. Når et parti med produkter ikke oppfyller kvalitetsspesifikasjonene, representerer de bortkastede råvarene et direkte økonomisk tap som forverrer disse høye kostnadene. Uplanlagt nedetid, som følge av behovet for å feilsøke og korrigere prosessavvik, er en annen stor økonomisk belastning.

På miljøfronten er ineffektiviteten og avfallet som er forbundet med tradisjonelle produksjonsmetoder en betydelig bekymring. Mange konvensjonelle polyuretanbelegg er løsemiddelbaserte og bidrar til luftforurensning gjennom utslipp av flyktige organiske forbindelser (VOC). Selv om industrier i økende grad tar i bruk vannbaserte og lav-VOC-alternativer, klarer disse ofte ikke å matche ytelsen til sine løsemiddelbaserte motparter i høytytende applikasjoner. Dessuten er råmaterialene som brukes i tradisjonell PU-produksjon petroleumsbaserte, ikke-fornybare og ikke-biologisk nedbrytbare. Defekte produkter som ender opp som avfall, kan frigjøre skadelige kjemikalier i miljøet når de brytes ned over en periode på opptil 200 år.

Konvergensen av disse økonomiske og miljømessige faktorene skaper et sterkt forretningsargument for digitalisering. Ved å implementere løsningene som foreslås i denne rapporten, kan et selskap samtidig redusere kostnader, forbedre lønnsomheten og forbedre sin bærekraftsprofil. Å håndtere det tekniske problemet med batch-inkonsekvens reduserer direkte de økonomiske og miljømessige problemene, og forvandler en teknisk oppgradering til et strategisk forretningsmessig imperativ.

Inline-overvåking av fritt isocyanatinnhold i polyuretan

II. Avanserte teknologier for sanntidsovervåking

For å overvinne de iboende utfordringene ved PU-produksjon er det viktig å gå fra tradisjonell laboratoriebasert testing til sanntids, inline-overvåking. Dette nye paradigmet er avhengig av en rekke avanserte sensorteknologier som kan gi kontinuerlige, handlingsrettede data om kritiske prosessparametere.

2.1. Reologisk overvåking i linjen

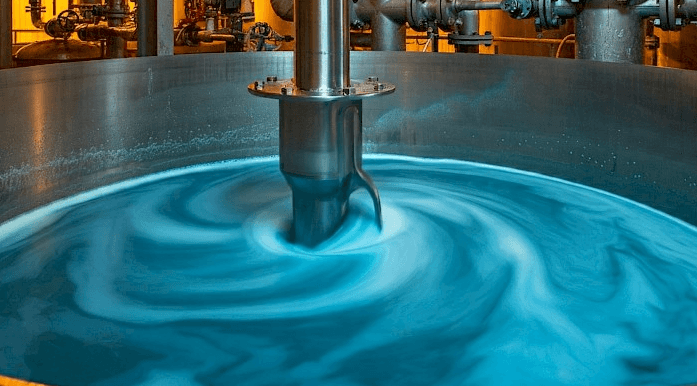

Reologiske egenskaper som viskositet og tetthet er grunnleggende for at en polyuretanreaksjon skal lykkes. De er ikke bare fysiske egenskaper, men fungerer som direkte indikatorer på polymerisasjons- og tverrbindingsprosessene. Sanntidsovervåking av disse egenskapene oppnås ved hjelp av inline-prosessviskosimetre og tetthetsmålere.

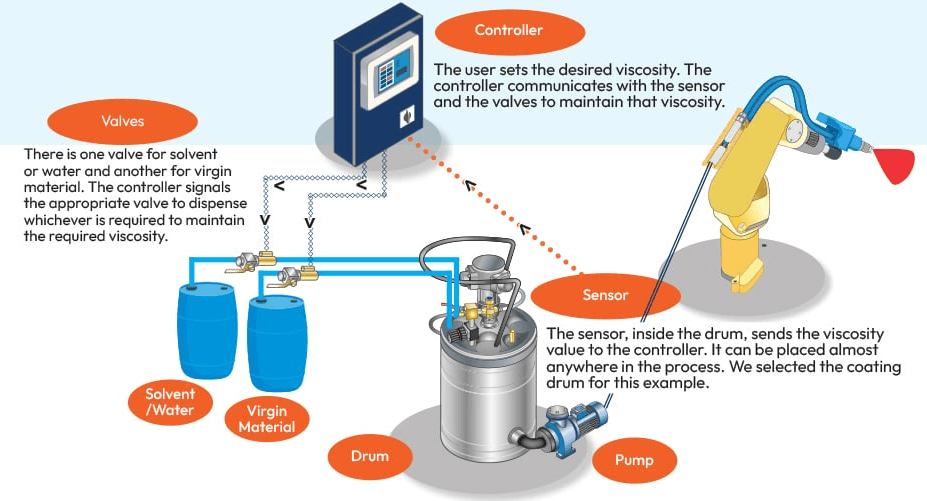

Instrumenter somLonnmøtteehPolysjømannViscometerogViscositakkProffcessorer designet for direkte innsetting i rørledninger og reaktorer, noe som muliggjør kontinuerlig måling av en væskes viskositet, tetthet og temperatur. Disse enhetene opererer etter prinsipper som vibrerende gaffelteknologi, som er robust, ikke krever bevegelige deler og er ufølsom for eksterne vibrasjoner og strømningsvariasjoner. Denne funksjonen gir en ikke-destruktiv sanntidsmetode for å spore polymerisasjonsprosessen. Molforholdet NCO/OH og dannelsen av polare bindinger påvirker for eksempel direkte viskositeten, noe som gjør den til en pålitelig indikator på reaksjonens fremgang. Ved å sikre at viskositeten forblir innenfor et spesifisert område, kan et produksjonsteam bekrefte at reaksjonen går som ønsket og kontrollere tilsetningen av kjedeforlengere for å oppnå målmolekylvekten og tverrbindingen. Denne stramme sanntidskontrollen forbedrer produktkvaliteten og reduserer avfall ved å forhindre produksjon av batcher utenfor spesifikasjonene.

2.2. Spektroskopisk analyse for kjemisk sammensetning

Selv om reologiske egenskaper indikerer materialets fysiske tilstand,sanntidsspektroskopisk analysegir en dypere forståelse av reaksjonen på kjemisk nivå. Nær-infrarød (NIR) spektroskopi er en overlegen metode for kontinuerlig overvåking av kjernereaksjonen ved å kvantifisere konsentrasjonen av isocyanat (%NCO) og hydroksylgrupper.

Denne metoden representerer et betydelig fremskritt i forhold til tradisjonell laboratorietitrering, som er langsom og bruker kjemikalier som krever riktig avhending. Evnen til et sanntids-NIR-system til å overvåke flere prosesspunkter fra en enkelt analysator gir en betydelig fordel når det gjelder effektivitet og sikkerhet. NCO/OH-forholdet er ikke bare en prosessvariabel; det er en direkte determinant for sluttproduktets egenskaper, inkludert strekkfasthet, modulus og hardhet. Ved å gi kontinuerlige sanntidsdata om dette kritiske forholdet, muliggjør en NIR-sensor proaktiv justering av materialtilførselshastigheter. Dette transformerer kontrollprosessen fra en reaktiv, defektdrevet tilnærming til en proaktiv, kvalitetsbasert strategi, der et presist NCO/OH-forhold opprettholdes gjennom hele reaksjonen for å garantere et resultat av høy kvalitet.

2.3. Dielektrisk analyse (DEA) for overvåking av herdetilstand

Dielektrisk analyse (DEA), også kjent som dielektrisk termisk analyse (DETA), er en kraftig teknikk for å overvåke den "usynlige herdingen i formen" som er avgjørende for sluttproduktets kvalitet. Den måler direkte endringer i et materiales viskositet og herdetilstand ved å påføre en sinusformet spenning og måle de resulterende endringene i mobiliteten til ladningsbærere (ioner og dipoler). Når et materiale herder, øker viskositeten dramatisk, og mobiliteten til disse ladningsbærerne avtar, noe som gir et direkte, kvantifiserbart mål på herdingens fremgang.

DEA kan nøyaktig bestemme gelpunktet og slutten av herdeprosessen, selv for hurtigherdende systemer. Det gir et nyansert perspektiv som utfyller andre teknologier. Mens et inline-viskosimeter måler materialets totale bulkviskositet, gir en DEA-sensor innsikt i den kjemiske utviklingen av tverrbindingsreaksjonen. Kombinasjonen av eninnebygd viskometer(måling avresultatav kuren) og en DEA-sensor (som målerprogresjonav kuren) gir et omfattende, todelt bilde av prosessen som muliggjør svært presis kontroll og diagnose. DEA kan også brukes til å overvåke effektiviteten til ulike tilsetningsstoffer og fyllstoffer.

En sammenligning av disse teknologiene fremhever deres komplementære natur. Ingen enkelt sensor kan gi et fullstendig bilde av den komplekse PU-reaksjonen. En helhetlig løsning krever integrering av flere sensorer for å overvåke ulike fysiske og kjemiske egenskaper samtidig.

| Parameter overvåket | Teknologiprinsipp | Primære brukstilfeller |

| Viskositet, temperatur | Vibrerende gaffelviskosimeter | Råmateriale-QC, reaksjonsovervåking i sanntid, endepunktsdeteksjon. |

| %NCO, hydroksylnummer | Nær-infrarød (NIR) spektroskopi | Overvåking av kjemisk sammensetning i sanntid, kontroll av tilførselsforhold, optimalisering av katalysator. |

| Herdetilstand, gelpunkt | Dielektrisk analyse (DEA) | Overvåking av herding i formen, verifisering av geleringstid, analyse av additiv effektivitet. |

Tabell 2.1: Sammenligning av avanserte inline-overvåkingsteknologier for PU-produksjon

III. Rammeverk for kvantitative prediktive modelleringer

De rike datastrømmene fra avanserte overvåkingsteknologier er en forutsetning for digitalisering, men deres fulle verdi realiseres når de brukes til å bygge kvantitative prediktive modeller. Disse modellene oversetter rådata til handlingsrettet innsikt, noe som muliggjør en dypere forståelse av prosessen og et skifte mot proaktiv optimalisering.

3.1. Kjemorheologisk modellering og modellering av herdingskinetikk

Det er ikke tilstrekkelig å bare samle inn sensordatapunkter for å oppnå ekte prosesskontroll; dataene må brukes til å bygge en modell som forklarer den underliggende oppførselen til den kjemiske reaksjonen. Kjemorheologiske og herdekinetiske modeller knytter kjemisk omdannelse til fysiske endringer, som økning i viskositet og geleringstid. Disse modellene er spesielt verdifulle for hurtigherdende systemer, der et fenomens forbigående natur gjør tradisjonell analyse vanskelig.5

Isokonversjonelle metoder, også kjent som modellfrie tilnærminger, kan brukes på ikke-isotermiske data for å forutsi reaksjonskinetikken til hurtigherdende harpikser. Slike modeller involverer sterkt koblet termo-kjemo-reologisk analyse, som betyr at de vurderer samspillet mellom temperatur, kjemisk sammensetning og materialflytegenskaper. Ved å bygge en matematisk representasjon av hele reaksjonen, går disse modellene utover enkel overvåking for å gi reell prosessforståelse. De kan forutsi hvordan viskositeten vil endre seg over tid for en gitt temperaturprofil, eller hvordan en endring i en katalysator vil endre reaksjonshastigheten, noe som gir et sofistikert verktøy for kontroll og optimalisering.

3.2. Kjemometrisk analyse og multivariat regresjon

Polyuretanproduksjon er en multivariat prosess der flere faktorer samhandler for å bestemme kvaliteten på sluttproduktet. Tradisjonell eksperimentering med én faktor er tidkrevende og klarer ikke å fange opp de komplekse, ikke-lineære sammenhengene mellom variabler. Kjemometriske teknikker, som partiell minste kvadraters regresjon (PLS) og responsoverflatemetodikk (RSM), er utviklet for å møte denne utfordringen.

Partial Least Squares (PLS) regresjon er en teknikk som er godt egnet for analyse av store, korrelerte datasett, som de som genereres av et sanntids NIR-spektrometer. PLS reduserer problemet fra et stort antall sammenhengende variabler til et lite antall ekstraherte faktorer, noe som gjør den utmerket for prediktive formål. I sammenheng med polyuretanproduksjon kan PLS brukes til å diagnostisere prosessproblemer og avsløre hvordan kvalitetsvariabler varierer romlig innenfor produktet.

Response Surface Methodology (RSM) er en kraftig matematisk og statistisk metode spesielt for modellering og optimalisering av eksperimentelle forhold. RSM muliggjør analyse av de kombinerte effektene av flere faktorer – som NCO/OH-forhold, kjedeforlengelseskoeffisient og herdetemperatur – på en ønsket responsvariabel som strekkfasthet. Ved å plassere eksperimentelle punkter strategisk i kritiske områder, kan RSM nøyaktig karakterisere de underliggende ikke-lineære forholdene og interaktive effektene mellom faktorer. En studie demonstrerte effektiviteten av denne tilnærmingen, med en modell som forutsier endelige egenskaper med en imponerende nøyaktighetsfeil på bare 2,2 %, noe som gir en overbevisende validering av metodikken. Evnen til å kartlegge hele "responsflaten" for en kvalitetsmåling gjør det mulig for en ingeniør å identifisere den optimale kombinasjonen av alle faktorer samtidig, noe som fører til en overlegen løsning.

3.3. Digital tvilling i produksjonsprosessen

En digital tvilling er en dynamisk, virtuell kopi av en fysisk ressurs, et system eller en prosess. I kjemisk produksjon drives denne kopien av sanntidsdata fra IoT-sensorer og prediktive modeller. Den fungerer som en levende, høykvalitets simulering av produksjonslinjen. Den sanne verdien av en digital tvilling ligger i dens evne til å tilby et lavrisikomiljø for optimalisering med høy innsats.

Polyuretanproduksjon er en kostbar prosess på grunn av dyre råvarer og høyt energiforbruk. Å gjennomføre fysiske eksperimenter for å optimalisere prosessen er derfor et høyrisiko- og kostnadsprosjekt. En digital tvilling adresserer denne utfordringen direkte ved å la ingeniører kjøre tusenvis av "hva om"-scenarier på en virtuell modell uten å forbruke råvarer eller produksjonstid. Denne funksjonen akselererer ikke bare tiden det tar å få nye formuleringer på markedet, men reduserer også kostnadene og risikoen ved prosessoptimalisering betydelig. Videre kan digitale tvillinger bygge bro mellom nye digitale teknologier og eldre, eldre systemer ved å integrere sanntidsdata fra eksisterende infrastruktur, noe som gir et enhetlig digitalt miljø uten behov for omfattende overhalinger.

IV. AI/maskinlæring for prosesskontroll og avviksdeteksjon

Prediktive modeller omdanner data til forståelse, men kunstig intelligens (KI) og maskinlæring (ML) tar neste steg: å omdanne forståelse til autonom handling og intelligent kontroll.

4.1. Systemer for feilsøking og anomali

Tradisjonelle prosesskontrollsystemer er avhengige av statiske, hardkodede terskler for å utløse alarmer. Denne tilnærmingen er utsatt for feil, da den kan mislykkes i å oppdage gradvise avvik som holder seg innenfor et akseptabelt område, eller kan generere plagsomme alarmer som desensibiliserer operatører. AI-drevet anomalideteksjon representerer et betydelig paradigmeskifte. Disse systemene er trent på historiske data for å lære de normale driftsmønstrene til en prosess. De kan deretter automatisk identifisere og flagge eventuelle avvik fra dette lærte mønsteret, selv om en parameter ennå ikke har krysset en statisk terskel.

For eksempel kan en gradvis, men jevn økning i viskositet over en bestemt tidsramme, selv om den fortsatt er innenfor det akseptable området, være et varsel om et forestående problem som et tradisjonelt system ville overse. Et AI-avviksdeteksjonssystem ville gjenkjenne dette som et uvanlig mønster og generere en tidlig advarsel, slik at teamet kan iverksette proaktive tiltak for å forhindre en defekt batch. Denne funksjonen forbedrer kvalitetskontrollen betydelig ved å oppdage avvik fra ønskede spesifikasjoner, redusere risikoen for defekte produkter og sikre samsvar.

4.2. Prediktivt vedlikehold for kritiske eiendeler

Uplanlagt nedetid er en av de største kostnadene i industriell produksjon. Tradisjonelle vedlikeholdsstrategier er enten reaktive ("reparer det når det går i stykker") eller tidsbaserte (f.eks. å bytte en pumpe hver sjette måned, uavhengig av tilstanden). Prediktivt vedlikehold, drevet av ML-modeller, gir et langt bedre alternativ.

Ved kontinuerlig å analysere sanntidsdata fra sensorer (f.eks. vibrasjon, temperatur, trykk), kan disse modellene identifisere tidlige tegn på utstyrsdegradering og forutsi potensiell feil. Systemet kan gi en "tids-til-feil-prognose", slik at teamet kan planlegge reparasjoner under en planlagt nedstengning uker eller til og med måneder i forveien. Dette eliminerer den kostbare nedetiden ved en uventet feil og gir bedre planlegging av arbeidsstyrke, deler og logistikk. Avkastningen på investeringen (ROI) for denne tilnærmingen er betydelig og godt dokumentert i casestudier. For eksempel oppnådde et raffineri en 3X ROI ved å implementere et proaktivt inspeksjonsprogram, mens et olje- og gasselskap sparte millioner av dollar med et tidlig varslingssystem som oppdaget utstyrsavvik. Disse konkrete økonomiske fordelene taler for å gå over fra en reaktiv til en prediktiv vedlikeholdsstrategi.

4.3. Prediktiv kvalitetskontroll

Prediktiv kvalitetskontroll endrer fundamentalt rollen til kvalitetssikring fra en etterproduksjonskontroll til en proaktiv funksjon i prosessen. I stedet for å vente på at et sluttprodukt skal testes for egenskaper som hardhet eller strekkfasthet, kan ML-modeller kontinuerlig analysere sanntids prosessdata fra alle sensorer for å forutsi, med høy grad av sikkerhet, hva de endelige kvalitetsegenskapene vil være.

En prediktiv kvalitetsmodell kan identifisere det komplekse samspillet mellom råvarekvalitet, prosessparametere og miljøforhold for å bestemme de optimale produksjonsinnstillingene for et ønsket resultat. Hvis modellen forutsier at sluttproduktet vil være utenfor spesifikasjonene (f.eks. for mykt), kan den varsle operatøren eller til og med automatisk justere en prosessparameter (f.eks. katalysatortilførselshastighet) for å korrigere avviket i sanntid. Denne funksjonen bidrar ikke bare til å forhindre feil før de oppstår, men akselererer også forskning og utvikling ved å gi raskere prediksjoner av egenskaper og identifisere underliggende mønstre i dataene. Denne tilnærmingen er et strategisk imperativ for produsenter som ønsker å maksimere utbyttet og forbedre driftseffektiviteten.

V. Teknisk implementeringsplan

Implementering av disse avanserte løsningene krever en strukturert, faseinndelt tilnærming som tar for seg kompleksiteten ved dataintegrasjon og eldre infrastruktur. En veldefinert plan er avgjørende for å redusere risiko og demonstrere tidlig avkastning på investeringen (ROI).

5.1. Fasebasert tilnærming til digital transformasjon

En vellykket digital transformasjonsreise bør ikke starte med en fullskala overhaling. De høye initiale investeringskostnadene og kompleksiteten ved å integrere nye systemer kan være uoverkommelige, spesielt for små og mellomstore bedrifter. En mer effektiv tilnærming er å ta i bruk en trinnvis implementering, som starter med et Proof of Concept (PoC) på en enkelt pilotproduksjonslinje. Dette lavrisikoprosjektet i liten skala lar et selskap teste interoperabiliteten til nye sensorer og programvare med eksisterende infrastruktur og evaluere ytelsen før de forplikter seg til en bredere utrulling. Den kvantifiserte avkastningen fra denne første suksessen kan deretter brukes til å bygge en overbevisende forretningsplan for bredere implementering. Denne tilnærmingen er i samsvar med kjerneprinsippene i Industri 4.0, som vektlegger interoperabilitet, sanntidskapasitet og modularitet.

5.2. Datahåndterings- og integrasjonsarkitektur

En robust datainfrastruktur er grunnlaget for alle prediktive og AI-drevne løsninger. Dataarkitekturen må være i stand til å håndtere det enorme volumet og de ulike datatypene som genereres av en smart fabrikk. Dette innebærer vanligvis en lagdelt tilnærming som inkluderer en datahistoriker og en datasjø.

Datahistoriker:En datahistoriker er en spesialisert database designet for å samle inn, lagre og administrere store mengder tidsseriedata fra industrielle prosesser. Den fungerer som et omhyggelig organisert digitalt arkiv, som fanger opp alle temperatursvingninger, trykkavlesninger og strømningshastigheter med et presist tidsstempel. Datahistorikeren er det optimale verktøyet for å håndtere kontinuerlige datastrømmer med stort volum fra prosessensorer, og er det «perfekte drivstoffet» for avansert analyse.

Datasjø:En datasjø er et sentralt lagringssted som inneholder rådata i sitt opprinnelige format og kan håndtere ulike datatyper, inkludert strukturerte tidsseriedata, ustrukturerte bilder fra kvalitetskameraer og maskinlogger. Datasjøen er designet for å håndtere de enorme mengdene med ulike data fra alle hjørner av en bedrift, noe som muliggjør et mer helhetlig, ende-til-ende-perspektiv. En vellykket implementering krever både en datahistoriker for kjerneprosessdata og en datasjø for et bredere, omfattende perspektiv som muliggjør kompleks analyse som rotårsaksanalyse og korrelasjon med ikke-sensordata.

En logisk lagdelt arkitektur for dataintegrasjon ville se slik ut:

| Lag | Komponent | Funksjon | Datatype |

| Kant | IoT-sensorer, gatewayer, PLS-er | Datainnsamling og lokal prosessering i sanntid | Tidsserie, binær, diskret |

| Data Foundation | Datahistoriker | Høytytende, tidsstemplet lagring av prosessdata | Strukturerte tidsserier |

| Sentralt arkiv | Datasjøen | Sentralisert, skalerbart arkiv for alle datakilder | Strukturert, semistrukturert, ustrukturert |

| Analyse og AI | Analyseplattform | Kjører prediktive modeller, maskinlæring og forretningsintelligens | Alle datatyper |

Tabell 5.1: Viktige komponenter for dataintegrasjon og -administrasjon

5.3. Håndtering av utfordringer med integrering av eldre systemer

Mange kjemiske anlegg er fortsatt avhengige av driftsteknologisystemer (OT) som er over ti år gamle, og som ofte bruker proprietære protokoller som ikke er kompatible med moderne standarder. Å erstatte disse eldre systemene, som distribuerte kontrollsystemer (DCS) eller programmerbare logiske kontrollere (PLC), er et prosjekt på flere millioner dollar som kan forårsake betydelig produksjonsnedetid. En mer praktisk og kostnadseffektiv løsning er å bruke IoT-gatewayer og API-er som en bro.

IoT-gatewayer fungerer som mellomledd og oversetter data fra nye IoT-sensorer til et format som eldre systemer kan forstå. De gjør det mulig for et selskap å implementere avansert overvåking uten en fullskala overhaling, noe som direkte adresserer kostnadsbarrieren og gjør de foreslåtte løsningene langt mer tilgjengelige. I tillegg kan implementering av edge computing, der data behandles direkte ved kilden, redusere nettverksbåndbredden og forbedre responsen i sanntid.

5.4. Avgjørelse om lokal vs. skyarkitektur

Beslutningen om hvor data- og analyseplattformer skal være vertskap for, er kritisk med betydelige implikasjoner for kostnader, sikkerhet og skalerbarhet. Valget er ikke et enkelt «enten/eller», men bør baseres på en nøye analyse av de spesifikke brukstilfellene.

| Kriterium | Lokalt | Sky |

| Kontroll | Full kontroll over maskinvare, programvare og sikkerhet. Ideelt for strengt regulerte bransjer. | Mindre direkte kontroll; en modell for delt ansvar. |

| Koste | Høye initiale maskinvarekostnader; avskrivninger og vedlikehold er selskapets ansvar. | Lavere startkostnad med en «betal-for-det-du-bruker»-modell. |

| Skalerbarhet | Begrenset elastisitet; krever manuell provisjonering og kapitalinvesteringer for å skalere opp. | Enorm skalerbarhet og elastisitet; kan skaleres dynamisk opp og ned. |

| Latens | Lav latens, ettersom dataene er fysisk nær kilden. | Kan ha for høy latens for enkelte kontrollarbeidsbelastninger i sanntid. |

| Innovasjon | Tregere tilgang til ny teknologi; krever manuelle programvare- og maskinvareoppdateringer. | Raskt voksende funksjonssett med innovasjoner som AI og ML. |

| Sikkerhet | Bedriften har eneansvar for alle sikkerhetsrutiner. | Delt ansvar med leverandøren, som håndterer mange sikkerhetslag. |

Tabell 5.2: Beslutningsmatrise for skybasert vs. lokal administrasjon

En vellykket digital strategi bruker ofte en hybridmodell. Driftskritiske kontrollløkker med lav latens og svært proprietære formuleringsdata kan oppbevares lokalt for maksimal sikkerhet og kontroll. Samtidig kan en skybasert plattform brukes til en sentralisert datasjø, som muliggjør langsiktig historisk analyse, samarbeidende forskning med eksterne partnere og tilgang til banebrytende verktøy for kunstig intelligens og maskinlæring.

VI. Praktisk optimaliserings- og diagnostikkmanual

Den sanne verdien av avansert overvåking og modellering realiseres når de brukes til å lage handlingsrettede verktøy for produksjonsledere og ingeniører. Disse verktøyene kan automatisere og forbedre beslutningsprosessen, og gå fra reaktiv feilsøking til proaktiv, modelldrevet kontroll.

6.1. Et modelldrevet diagnostisk rammeverk

I et tradisjonelt produksjonsmiljø er feilsøking av defekter en tidkrevende, manuell prosess som er avhengig av operatørens erfaring og en prøving-og-feiling-tilnærming. Et modelldrevet diagnostisk rammeverk automatiserer denne prosessen ved å bruke sanntidsdata og modellutganger for umiddelbart å identifisere den mest sannsynlige rotårsaken til et problem.

Rammeverket fungerer som et beslutningstre eller et logisk flytskjema. Når et defektsymptom oppdages (f.eks. en unormal viskositetsavlesning fra et inline-viskosimeter), korrelerer systemet automatisk dette symptomet med data fra andre sensorer (f.eks. temperatur, NCO/OH-forhold) og resultatene fra prediktive modeller (f.eks. RSM-modellen for hardhet). Systemet kan deretter presentere en prioritert liste over potensielle underliggende årsaker for operatøren, noe som reduserer diagnosetiden fra timer til minutter og muliggjør en mye raskere korrigerende handling. Denne tilnærmingen går fra å bare finne en defekt til å proaktivt identifisere og korrigere det underliggende problemet.

Figur 6.1: Et forenklet flytskjema som illustrerer prosessen med å bruke sanntids sensordata og prediktive modeller for å veilede operatører mot en spesifikk rotårsak og et korrigerende tiltak.

Denne tilnærmingen kan oppsummeres i en diagnostisk matrise som gir en hurtigreferanseguide for målgruppen.

| Feil/symptom | Relevant datastrøm | Sannsynlig rotårsak |

| Inkonsekvent hardhet | NCO/OH-forhold, temperaturprofil | Feil materialforhold, ujevn temperaturprofil |

| Dårlig vedheft | Overflatetemperatur, fuktighet | Feil overflatebehandling, fuktighetspåvirkning fra omgivelsene |

| Bobler eller flekker | Viskositetsprofil, temperatur | Flyktige komponenter, feil blanding eller varmeprofil |

| Inkonsekvent herdetid | NCO/OH-forhold, temperatur, katalysatortilførselshastighet | Feil katalysatorkonsentrasjon, temperatursvingninger |

| Svekket struktur | Geleringstid, viskositetsprofil | Utilstrekkelig varme, lokalisert krymping over et kjølig område |

Tabell 6.2: Diagnostikkmatrise fra feil til innsikt

6.2. Smarte standard driftsprosedyrer (SOP-er)

Tradisjonelle standard driftsprosedyrer (SOP-er) er statiske, papirbaserte dokumenter som gir en rigid, trinnvis veiledning for produksjonsprosesser. Selv om de er viktige for å standardisere driften og sikre samsvar, kan de ikke ta hensyn til prosessavvik i sanntid. En «smart SOP» er en ny, dynamisk generasjon prosedyrer som er integrert med live prosessdata.

For eksempel kan en tradisjonell SOP for en blandeprosess spesifisere en konstant temperatur og blandetid. En smart SOP, derimot, ville være koblet til sanntidstemperatur- og viskositetssensorer. Hvis en sensor oppdager at omgivelsestemperaturen har sunket, kan den smarte SOP-en dynamisk justere den nødvendige blandetiden eller temperaturen for å kompensere for endringen, og dermed sikre at den endelige produktkvaliteten forblir konsistent. Dette gjør SOP-en til et levende, tilpasningsdyktig dokument som hjelper operatører med å ta den optimale beslutningen i et flytende sanntidsmiljø, minimere variasjon, redusere feil og forbedre den generelle effektiviteten.

6.3. Optimalisering av kontrollsløyfer

Sensorene og prediktive modellene får full verdi når de integreres i et system som aktivt styrer prosessen. Dette innebærer å anvende beste praksis for finjustering av kontrollsløyfer og implementering av avanserte kontrollstrategier.

Optimalisering av kontrollsløyfer er en systematisk prosess som starter med en dyp forståelse av prosessen, definerer kontrollmålet og bruker deretter sanntidsdata for å finjustere sløyfen. Avanserte prosesskontrollstrategier (APC), som kaskade- og foroverkoblingskontroll, kan brukes til å forbedre stabilitet og respons. Det endelige målet er å lukke data-til-handling-syklusen: en innebygd NIR-sensor gir sanntidsdata om NCO/OH-forholdet, en prediktiv modell forutsier resultatet, og kontrollsløyfen bruker denne informasjonen til å automatisk justere isocyanat-fødepumpen, opprettholder det optimale forholdet og eliminerer variasjon. Kontinuerlig overvåking av sløyfens ytelse er avgjørende for å fange opp drift, identifisere sensorproblemer og bestemme når man skal justere på nytt før prosessytelsen forringes.

VII. Casestudier og beste praksis

Fordelene med avansert overvåking og kvantitativ modellering er ikke bare teoretiske; de valideres av suksesser i den virkelige verden og kvantifiserbar avkastning. Erfaringene til bransjeledere gir verdifull lærdom og et overbevisende forretningsargument for digitalisering.

7.1. Lærdommer fra bransjeledere

Digitaliseringsarbeidet til store kjemiske selskaper viser en klar trend: suksess kommer fra en helhetlig, ende-til-ende-strategi, ikke en stykkevis tilnærming.

DuPont:Anerkjente behovet for en robust forsyningskjede i et volatilt marked og implementerte en tilpasset digital plattform for «hva om»-scenariomodellering. Dette gjorde det mulig for dem å ta smartere forretningsbeslutninger og effektivt distribuere over 1000 produkter med forbedrede prediksjonsmuligheter. Lærdommen er at det å koble ulike systemer – fra forsyningskjeden til driften – til en sentralisert plattform gir en omfattende oversikt over hele verdikjeden.

Covestro:Lanserte en global strategi for digitalisering av bedrifter for å skape en sentralisert «enkelt sannhetskilde» for prosjektdata, og dermed gå bort fra avhengigheten av regneark. Denne integrerte tilnærmingen sparte 90 % av tiden som tidligere ble brukt på manuell datainnsamling og validering, og økte påliteligheten betydelig. Selskapet utnyttet også digitalisering for å utvikle nye produkter raskere og øke produktkvaliteten og lønnsomheten i produksjonen.

SABIC:Implementerte en digital driftsplattform for hele selskapet som integrerer råvarekvalitet, prosessparametere og miljøforhold i digitale prediktive verktøy. En AI-drevet løsning for helsetjenester for eiendeler opererer for eksempel på tvers av anleggene globalt, og forutsier potensielle feil på kritisk utstyr og muliggjør proaktivt vedlikehold. Denne helhetlige tilnærmingen har ført til forbedringer i energieffektivitet, pålitelighet av eiendeler og driftsavtrykk.

7.2. Avkastning og konkrete fordeler

Investeringen i disse teknologiene er en strategisk forretningsbeslutning med en klar og betydelig avkastning. Casestudier fra ulike bransjer gir en overbevisende bekreftelse på de økonomiske og driftsmessige fordelene.

Prediktiv analyse:AVEVA Predictive Analytics-programvaren har vist seg å oppnå effektivitetsbesparelser på opptil 37 millioner dollar i løpet av 24 måneder, med en reduksjon på 10 % i gjentakende vedlikeholdskostnader og eliminering av 3000 årlige vedlikeholdstimer. Et olje- og gasselskap sparte 33 millioner dollar ved å bruke et skybasert tidlig varslingssystem for å oppdage utstyrsavvik. Et raffineriprogram ga en 3 ganger høyere avkastning og reduserte antallet korrosjonsovervåkingssteder på en sikker måte med 27,4 %.

Effektivitetsforbedringer:En produsent av spesialkjemikalier sto overfor utfordringer med å redusere driftskostnader og forbedre produksjonsforutsigbarheten. Ved å implementere en omfattende analyse for å finne forbedringsmuligheter, oppnådde de en betydelig avkastning på investeringen på 2,7:1, med forbedringer i råvareutbyttet per enhet og en økning i enhetsproduksjonen.

Sikkerhet og logistikk:Et gassanlegg klarte å redusere evakuerings- og mønstringstiden med 70 % gjennom automatisering etter gjentatte mislykkede sikkerhetsrevisjoner. SABICs digitale plattform automatiserte manuelle dokumentasjonsprosesser, som tidligere tok fire dager, og reduserte tiden til bare én dag, eliminerte store flaskehalser og unngikk demurrage-gebyrer.

Disse resultatene viser at de foreslåtte strategiene ikke er et abstrakt konsept, men en velprøvd, kvantifiserbar vei til å oppnå større lønnsomhet, effektivitet og sikkerhet.

7.3. Teoretisk casestudie: Optimalisering av NCO/OH-forhold

Denne siste casestudien illustrerer hvordan konseptene som presenteres i denne rapporten kan brukes i én enkelt, sammenhengende fortelling for å løse et vanlig og kostbart problem i PU-produksjon.

Scenario:En produsent av PU-belegg opplever uoverensstemmelser mellom partier i hardhet og herdetid for sluttproduktet. Tradisjonelle laboratorietester er for trege til å diagnostisere problemet i tide for å redde partiet, noe som fører til betydelig materialsvinn. Teamet mistenker at et fluktuerende NCO/OH-forhold er den underliggende årsaken.

Løsning:

Sanntidsovervåking:Teamet installerer en sanntids NIR-spektroskopisensor i mateledningen for kontinuerlig å overvåke NCO/OH-forholdet.2Dataene fra denne sensoren strømmes til en datahistoriker, noe som gir en kontinuerlig og nøyaktig registrering av denne kritiske parameteren.

Kvantitativ modellering:Ved hjelp av historiske NIR-data utvikler teamet en RSM-modell som etablerer det nøyaktige forholdet mellom NCO/OH-forholdet og sluttproduktets hardhet og herdetid. Denne modellen lar dem bestemme det optimale forholdet for å oppnå de ønskede egenskapene og forutsi den endelige kvaliteten på en batch mens den fortsatt er i reaktoren.

AI-drevet anomalideteksjon:En AI-modell for avviksdeteksjon distribueres på datastrømmen fra NIR-sensoren. Modellen lærer den normale driftsprofilen for NCO/OH-forholdet. Hvis den oppdager et avvik fra dette lærte mønsteret – selv en liten, gradvis avvikelse – sender den en tidlig advarsel til produksjonsteamet. Dette gir et varsel uker før et problem ville blitt oppdaget ved tradisjonell laboratorieprøvetaking.

Automatisert prosesskontroll:Det siste trinnet er å lukke sløyfen. Et prediktivt kontrollsystem implementeres som bruker sanntidsdata fra NIR-sensoren til automatisk å justere matepumpen for isocyanatet. Dette eliminerer den menneskelige faktoren og sikrer at NCO/OH-forholdet opprettholdes på den optimale verdien gjennom hele reaksjonen, noe som eliminerer variasjon og garanterer jevn kvalitet.

Ved å anvende dette omfattende rammeverket kan produsenten gå fra en reaktiv, feildrevet produksjonsmodell til en proaktiv, datadrevet modell, og sikre at hvert parti oppfyller kvalitetsstandarder, redusere svinn og forbedre den generelle lønnsomheten.

Publisert: 08.09.2025