La produzione di rivestimenti e adesivi in poliuretano (PU) è un processo complesso e articolato in più fasi, governato da delicate reazioni chimiche. Sebbene la domanda di questi materiali continui a crescere in tutti i settori, la loro produzione presenta una serie di sfide fondamentali che incidono direttamente sulla qualità del prodotto, sull'efficienza produttiva e sulla redditività complessiva. Una comprensione approfondita di queste problematiche fondamentali è fondamentale per sviluppare una roadmap strategica e pratica per il miglioramento.

1.1. Complessità e variabilità chimica intrinseca: la sfida della polimerizzazione rapida

La produzione di poliuretano è una reazione di poliaddizione tra polioli e isocianati, un processo spesso rapido e altamente esotermico. La velocità e il calore generati da questa reazione rendono il controllo preciso estremamente difficile. La complessità intrinseca è ulteriormente aggravata dalla sensibilità della reazione a fattori esterni come temperatura, umidità e presenza di catalizzatori. Piccole fluttuazioni incontrollate di queste condizioni ambientali o dei materiali in ingresso possono portare a variazioni significative nelle proprietà del prodotto finale, inclusi il tempo di polimerizzazione e le prestazioni fisiche.

Una sfida fondamentale in questo contesto è il "breve pot life" di molti sistemi PU a polimerizzazione rapida. I tempi di produzione del gas e di reticolazione del PU sono spesso troppo brevi per essere compatibili con i metodi di caratterizzazione tradizionali. Questo rappresenta un problema ingegneristico ed economico cruciale. Le procedure tradizionali di controllo qualità (CQ), che prevedono il prelievo di un campione dal reattore e il suo trasporto in laboratorio per l'analisi, sono intrinsecamente imperfette. Il processo di titolazione in laboratorio è lento e, cosa critica, le proprietà chimiche del campione iniziano a cambiare nel momento in cui viene rimosso dal reattore ed esposto alle condizioni ambientali. Questa latenza implica che i risultati di laboratorio siano un'analisi post-mortem di un lotto già prodotto. I dati non solo non sono fruibili, arrivando troppo tardi per consentire un intervento, ma sono anche potenzialmente imprecisi, poiché non rappresentano più lo stato del materiale all'interno del contenitore di produzione. Questa fondamentale incompatibilità del controllo qualità tradizionale, basato sui ritardi, con la rapida cinetica della chimica del PU è il problema principale che il monitoraggio e la modellazione avanzati devono affrontare.

1.2. Cause principali dell'incoerenza dei lotti e della formazione di difetti

L'incoerenza tra i lotti e la formazione di difetti non sono eventi casuali, ma la conseguenza diretta di una mancanza di precisione nel controllo dei parametri critici di processo. Il prodotto finale è altamente sensibile al rapporto tra i componenti, alla tecnica di miscelazione e al profilo di temperatura durante l'intero processo. Una miscelazione impropria, ad esempio, può portare a una dispersione non uniforme di cariche o indurenti, causando "stress intrinseci" e difetti nel prodotto finale.

La precisione dell'input delle materie prime, in particolare il rapporto molare tra gruppi isocianato (NCO) e ossidrile (OH), è fondamentale per il mantenimento della continuità qualitativa. Il rapporto NCO/OH è un fattore determinante per le proprietà del prodotto finale; all'aumentare del rapporto, aumentano anche proprietà fisiche chiave come resistenza alla trazione, modulo elastico e durezza. Il rapporto influenza anche la viscosità del materiale e il comportamento di polimerizzazione. Altre condizioni di processo critiche, come il profilo termico, sono altrettanto importanti. Un riscaldamento insufficiente o non uniforme può causare una polimerizzazione irregolare e un ritiro localizzato, mentre i componenti volatili possono evaporare, causando bolle e imperfezioni.

Un'analisi dettagliata delle cause profonde dei difetti rivela che un singolo sensore o parametro è spesso insufficiente per una diagnosi accurata. Un problema come "Nessun gel o mancata polimerizzazione" potrebbe essere causato da un rapporto di miscelazione errato, da calore insufficiente o da una miscelazione impropria. Queste cause sono spesso correlate. Ad esempio, una temperatura troppo bassa rallenta il processo di polimerizzazione e può essere erroneamente diagnosticata come un problema con il rapporto di materiale. Per comprendere e affrontare veramente la causa principale, è necessario misurare più parametri contemporaneamente. Ciò richiede una suite completa di sensori in grado di correlare dati in tempo reale provenienti da diverse fonti per isolare il vero fattore causale dai sintomi risultanti, un compito che va oltre la portata del tradizionale monitoraggio a punto singolo.

1.3. Impatto economico e ambientale delle inefficienze

Le sfide tecniche nella produzione di poliuretano hanno ripercussioni economiche e ambientali dirette e significative. Materie prime di alta qualità, come polioli e isocianati, sono costose e i loro prezzi sono soggetti a fluttuazioni dovute alle discontinuità della catena di approvvigionamento, alla dipendenza dal petrolio greggio e alla domanda globale. Quando un lotto di prodotti non soddisfa le specifiche di qualità, lo spreco di materie prime rappresenta una perdita finanziaria diretta che aggrava questi costi elevati. I tempi di fermo non pianificati, derivanti dalla necessità di risolvere i problemi e correggere le deviazioni di processo, rappresentano un'altra importante perdita finanziaria.

Sul fronte ambientale, le inefficienze e gli sprechi insiti nei metodi di produzione tradizionali rappresentano una preoccupazione significativa. Molti rivestimenti poliuretanici convenzionali sono a base di solventi e contribuiscono all'inquinamento atmosferico attraverso le emissioni di Composti Organici Volatili (COV). Sebbene le industrie stiano adottando sempre più alternative a base d'acqua e a basso contenuto di COV, queste spesso non riescono a eguagliare le prestazioni delle loro controparti a base di solventi nelle applicazioni ad alte prestazioni. Inoltre, le materie prime utilizzate nella produzione tradizionale di PU sono a base di petrolio, non rinnovabili e non biodegradabili. I prodotti difettosi che finiscono come rifiuti possono rilasciare sostanze chimiche nocive nell'ambiente durante la loro decomposizione, che può durare fino a 200 anni.

La convergenza di questi fattori economici e ambientali crea un solido business case per la digitalizzazione. Implementando le soluzioni proposte in questo rapporto, un'azienda può contemporaneamente ridurre i costi, migliorare la redditività e potenziare il proprio profilo di sostenibilità. Affrontare il problema tecnico dell'incoerenza dei lotti mitiga direttamente i problemi finanziari e ambientali, trasformando un aggiornamento tecnico in un imperativo aziendale strategico.

Monitoraggio in linea del contenuto di isocianato libero nel poliuretano

II. Tecnologie avanzate di monitoraggio in tempo reale

Per superare le sfide intrinseche della produzione di poliuretano, è essenziale passare dai tradizionali test di laboratorio al monitoraggio in linea in tempo reale. Questo nuovo paradigma si basa su una suite di tecnologie di sensori avanzate in grado di fornire dati continui e fruibili sui parametri critici di processo.

2.1. Monitoraggio reologico in linea

Proprietà reologiche come viscosità e densità sono fondamentali per il successo di una reazione poliuretanica. Non sono semplici caratteristiche fisiche, ma servono come indicatori diretti dei processi di polimerizzazione e reticolazione. Il monitoraggio in tempo reale di queste proprietà viene effettuato utilizzando viscosimetri e densimetri in linea.

Strumenti come ilLonnincontratoluiPolymareViscometerEViscosigrazieProfessionistacessorSono progettati per l'inserimento diretto in condotte e reattori, consentendo la misurazione continua della viscosità, della densità e della temperatura di un fluido. Questi dispositivi funzionano secondo principi come la tecnologia a forcella vibrante, che è robusta, non richiede parti in movimento ed è insensibile alle vibrazioni esterne e alle variazioni di flusso. Questa capacità fornisce un metodo non distruttivo e in tempo reale per monitorare il processo di polimerizzazione. Il rapporto molare NCO/OH e la formazione di legami polari, ad esempio, influenzano direttamente la viscosità, rendendola un indicatore affidabile per l'avanzamento della reazione. Garantendo che la viscosità rimanga entro un intervallo specificato, un team di produzione può confermare che la reazione procede come desiderato e controllare l'aggiunta di estensori di catena per raggiungere il peso molecolare e la reticolazione desiderati. Questo controllo rigoroso e in tempo reale migliora la qualità del prodotto e riduce gli sprechi, impedendo la produzione di lotti fuori specifica.

2.2. Analisi spettroscopica per la composizione chimica

Mentre le proprietà reologiche indicano lo stato fisico del materiale,analisi spettroscopica in tempo realeFornisce una comprensione più approfondita della reazione a livello chimico. La spettroscopia nel vicino infrarosso (NIR) è un metodo avanzato per il monitoraggio continuo della reazione principale, quantificando la concentrazione di isocianato (%NCO) e gruppi idrossilici.

Questo metodo rappresenta un significativo progresso rispetto alla tradizionale titolazione di laboratorio, che è lenta e utilizza sostanze chimiche che richiedono un corretto smaltimento. La capacità di un sistema NIR in tempo reale di monitorare più punti di processo da un singolo analizzatore offre un vantaggio significativo in termini di efficienza e sicurezza. Il rapporto NCO/OH non è solo una variabile di processo; è un determinante diretto delle proprietà del prodotto finale, tra cui resistenza alla trazione, modulo e durezza. Fornendo dati continui e in tempo reale su questo rapporto critico, un sensore NIR consente la regolazione proattiva delle velocità di alimentazione del materiale. Questo trasforma il processo di controllo da un approccio reattivo, basato sui difetti, a una strategia proattiva, basata sulla qualità fin dalla progettazione, in cui un rapporto NCO/OH preciso viene mantenuto durante tutta la reazione per garantire un risultato di alta qualità.

2.3. Analisi dielettrica (DEA) per il monitoraggio dello stato di polimerizzazione

L'analisi dielettrica (DEA), nota anche come analisi termica dielettrica (DETA), è una tecnica potente per monitorare la "polimerizzazione invisibile nello stampo", fondamentale per la qualità del prodotto finale. Misura direttamente le variazioni di viscosità e stato di polimerizzazione di un materiale applicando una tensione sinusoidale e misurando le conseguenti variazioni nella mobilità dei portatori di carica (ioni e dipoli). Durante la polimerizzazione, la viscosità di un materiale aumenta drasticamente e la mobilità di questi portatori di carica diminuisce, fornendo una misura diretta e quantificabile dell'avanzamento della polimerizzazione.

DEA è in grado di determinare con precisione il punto di gelificazione e la fine del processo di polimerizzazione, anche per i sistemi a polimerizzazione rapida. Offre una visione dettagliata che integra altre tecnologie. Mentre un viscosimetro in linea misura la viscosità complessiva del materiale, un sensore DEA fornisce informazioni sulla progressione a livello chimico della reazione di reticolazione. La combinazione di unviscosimetro in linea(misurando ilrisultatodella cura) e un sensore DEA (che misura laprogressionedella polimerizzazione) fornisce una visione completa e a due livelli del processo, che consente un controllo e una diagnosi estremamente precisi. La DEA può essere utilizzata anche per monitorare l'efficacia di vari additivi e riempitivi.

Un confronto tra queste tecnologie ne evidenzia la complementarietà. Nessun singolo sensore può fornire un quadro completo della complessa reazione del PU. Una soluzione olistica richiede l'integrazione di più sensori per monitorare simultaneamente diverse proprietà fisiche e chimiche.

| Parametro monitorato | Principio tecnologico | Casi d'uso principali |

| Viscosità, Temperatura | Viscosimetro a forcella vibrante | Controllo qualità delle materie prime, monitoraggio delle reazioni in tempo reale, rilevamento del punto finale. |

| %NCO, numero di ossidrile | Spettroscopia nel vicino infrarosso (NIR) | Monitoraggio in tempo reale della composizione chimica, controllo del rapporto di alimentazione, ottimizzazione del catalizzatore. |

| Stato di polimerizzazione, punto di gelificazione | Analisi dielettrica (DEA) | Monitoraggio della polimerizzazione nello stampo, verifica del tempo di gelificazione, analisi dell'efficacia degli additivi. |

Tabella 2.1: Confronto delle tecnologie avanzate di monitoraggio in linea per la produzione di PU

III. Quadri di modellazione predittiva quantitativa

I ricchi flussi di dati provenienti da tecnologie di monitoraggio avanzate sono un prerequisito per la digitalizzazione, ma il loro pieno valore si realizza quando vengono utilizzati per costruire modelli predittivi quantitativi. Questi modelli traducono i dati grezzi in informazioni fruibili, consentendo una comprensione più approfondita del processo e un passaggio verso un'ottimizzazione proattiva.

3.1. Modellazione chemoreologica e cinetica di cura

La semplice raccolta di dati dai sensori non è sufficiente per ottenere un vero controllo di processo; i dati devono essere utilizzati per costruire un modello che spieghi il comportamento sottostante della reazione chimica. I modelli chemoreologici e di cinetica di polimerizzazione collegano la conversione chimica a cambiamenti fisici, come l'aumento della viscosità e del tempo di gelificazione. Questi modelli sono particolarmente preziosi per i sistemi a polimerizzazione rapida, dove la natura transitoria di un fenomeno rende difficile l'analisi tradizionale.5

I metodi isoconversionali, noti anche come approcci model-free, possono essere applicati a dati non isotermici per prevedere la cinetica di reazione delle resine a polimerizzazione rapida. Tali modelli implicano un'analisi termo-chemo-reologica altamente accoppiata, ovvero considerano l'interazione tra temperatura, composizione chimica e proprietà di flusso del materiale. Costruendo una rappresentazione matematica dell'intera reazione, questi modelli vanno oltre il semplice monitoraggio per fornire una reale comprensione del processo. Possono prevedere come la viscosità cambierà nel tempo per un dato profilo di temperatura, o come una variazione in un catalizzatore altererà la velocità di reazione, fornendo uno strumento sofisticato per il controllo e l'ottimizzazione.

3.2. Analisi chemiometrica e regressione multivariata

La produzione di poliuretano è un processo multivariato in cui molteplici fattori interagiscono per determinare la qualità del prodotto finale. La sperimentazione tradizionale, basata su un singolo fattore, richiede molto tempo e non riesce a cogliere le complesse relazioni non lineari tra le variabili. Tecniche chemiometriche, come la regressione ai minimi quadrati parziali (PLS) e la metodologia delle superfici di risposta (RSM), sono progettate per affrontare questa sfida.

La regressione ai minimi quadrati parziali (PLS) è una tecnica particolarmente adatta all'analisi di grandi set di dati correlati, come quelli generati da uno spettrometro NIR in tempo reale. La PLS riduce il problema da un elevato numero di variabili interrelate a un piccolo numero di fattori estratti, rendendola eccellente per scopi predittivi. Nel contesto della produzione di poliuretano, la PLS può essere utilizzata per diagnosticare problemi di processo e rivelare come le variabili qualitative variano spazialmente all'interno del prodotto.

La metodologia della superficie di risposta (RSM) è un potente metodo matematico e statistico specificamente per la modellazione e l'ottimizzazione delle condizioni sperimentali. La RSM consente l'analisi degli effetti combinati di molteplici fattori, come il rapporto NCO/OH, il coefficiente di estensione della catena e la temperatura di polimerizzazione, su una variabile di risposta desiderata come la resistenza alla trazione. Posizionando strategicamente i punti sperimentali in regioni critiche, la RSM può caratterizzare accuratamente le relazioni non lineari sottostanti e gli effetti interattivi tra i fattori. Uno studio ha dimostrato l'efficacia di questo approccio, con un modello che prevede le proprietà finali con un impressionante errore di accuratezza di appena il 2,2%, fornendo una validazione convincente della metodologia. La capacità di mappare l'intera "superficie di risposta" per una metrica di qualità consente a un ingegnere di identificare la combinazione ottimale di tutti i fattori simultaneamente, portando a una soluzione superiore.

3.3. Gemello digitale del processo produttivo

Un gemello digitale è una replica virtuale e dinamica di un asset, sistema o processo fisico. Nella produzione chimica, questa replica si basa su dati in tempo reale provenienti da sensori IoT e modelli predittivi. Funge da simulazione dinamica e ad alta fedeltà della linea di produzione. Il vero valore di un gemello digitale risiede nella sua capacità di fornire un ambiente a basso rischio per un'ottimizzazione ad alto rischio.

La produzione di poliuretano è un processo costoso a causa delle materie prime costose e dell'elevato consumo energetico. Condurre esperimenti fisici per ottimizzare il processo è quindi un'impresa ad alto rischio e costo elevato. Un gemello digitale affronta direttamente questa sfida consentendo agli ingegneri di eseguire migliaia di scenari "what-if" su un modello virtuale senza consumare materie prime o tempi di produzione. Questa capacità non solo accelera il time-to-market per le nuove formulazioni, ma riduce anche significativamente i costi e i rischi dell'ottimizzazione dei processi. Inoltre, i gemelli digitali possono colmare il divario tra le nuove tecnologie digitali e i sistemi legacy più vecchi integrando dati in tempo reale dall'infrastruttura esistente, fornendo un ambiente digitale unificato senza la necessità di revisioni estese.

IV. AI/Machine Learning per il controllo dei processi e il rilevamento delle anomalie

I modelli predittivi trasformano i dati in comprensione, ma l'intelligenza artificiale (IA) e l'apprendimento automatico (ML) compiono il passo successivo: trasformano la comprensione in azione autonoma e controllo intelligente.

4.1. Sistemi di rilevamento anomalie e guasti

I sistemi di controllo di processo tradizionali si basano su soglie statiche e codificate per attivare gli allarmi. Questo approccio è soggetto a errori, poiché può non rilevare deviazioni graduali che rimangono entro un intervallo accettabile o può generare allarmi indesiderati che desensibilizzano gli operatori. Il rilevamento delle anomalie basato sull'intelligenza artificiale rappresenta un significativo cambiamento di paradigma. Questi sistemi vengono addestrati su dati storici per apprendere i normali schemi operativi di un processo. Possono quindi identificare e segnalare automaticamente eventuali deviazioni da questo schema appreso, anche se un parametro non ha ancora superato una soglia statica.

Ad esempio, un aumento graduale ma costante della viscosità in un intervallo di tempo specifico, pur rimanendo entro i limiti accettabili, potrebbe essere il presagio di un problema imminente che un sistema tradizionale non riuscirebbe a rilevare. Un sistema di rilevamento delle anomalie basato sull'intelligenza artificiale riconoscerebbe questo come un andamento insolito e genererebbe un allarme tempestivo, consentendo al team di adottare misure proattive per prevenire un lotto difettoso. Questa capacità migliora significativamente il controllo qualità rilevando deviazioni dalle specifiche desiderate, riducendo il rischio di prodotti difettosi e garantendo la conformità.

4.2. Manutenzione predittiva per asset critici

I tempi di fermo non pianificati rappresentano uno dei costi più significativi nella produzione industriale. Le strategie di manutenzione tradizionali sono reattive ("ripara quando si rompe") o basate sul tempo (ad esempio, sostituire una pompa ogni sei mesi, indipendentemente dalle sue condizioni). La manutenzione predittiva, basata su modelli di apprendimento automatico, offre un'alternativa di gran lunga superiore.

Analizzando costantemente i dati in tempo reale provenienti dai sensori (ad esempio, vibrazioni, temperatura, pressione), questi modelli possono identificare i primi segnali di degrado delle apparecchiature e prevedere potenziali guasti. Il sistema può fornire una "previsione del tempo necessario al guasto", consentendo al team di pianificare le riparazioni durante un arresto programmato con settimane o addirittura mesi di anticipo. Ciò elimina i costosi tempi di fermo dovuti a guasti imprevisti e consente una migliore pianificazione di manodopera, ricambi e logistica. Il ritorno sull'investimento (ROI) di questo approccio è sostanziale e ben documentato in casi di studio. Ad esempio, una raffineria ha ottenuto un ROI 3 volte superiore implementando un programma di ispezione proattivo, mentre un'azienda petrolifera e del gas ha risparmiato milioni di dollari con un sistema di allerta precoce che ha rilevato anomalie nelle apparecchiature. Questi tangibili vantaggi finanziari giustificano la transizione da una strategia di manutenzione reattiva a una predittiva.

4.3. Controllo di qualità predittivo

Il controllo qualità predittivo cambia radicalmente il ruolo della garanzia della qualità, da un controllo post-produzione a una funzione proattiva in-process. Invece di attendere che un prodotto finale venga testato per proprietà come la durezza o la resistenza alla trazione, i modelli di apprendimento automatico possono analizzare continuamente i dati di processo in tempo reale provenienti da tutti i sensori per prevedere, con un elevato grado di affidabilità, quali saranno gli attributi qualitativi finali.

Un modello di qualità predittivo può identificare la complessa interazione tra qualità delle materie prime, parametri di processo e condizioni ambientali per determinare le impostazioni di produzione ottimali per il risultato desiderato. Se il modello prevede che il prodotto finale non sarà conforme alle specifiche (ad esempio, troppo morbido), può avvisare l'operatore o persino regolare automaticamente un parametro di processo (ad esempio, la velocità di alimentazione del catalizzatore) per correggere la deviazione in tempo reale. Questa capacità non solo aiuta a prevenire i difetti prima che si verifichino, ma accelera anche la ricerca e lo sviluppo fornendo previsioni più rapide delle proprietà e identificando i modelli sottostanti nei dati. Questo approccio è un imperativo strategico per i produttori che cercano di massimizzare la resa e migliorare l'efficienza operativa.

V. Roadmap di implementazione tecnica

L'implementazione di queste soluzioni avanzate richiede un approccio strutturato e graduale che affronti le complessità dell'integrazione dei dati e delle infrastrutture legacy. Una roadmap ben definita è essenziale per mitigare i rischi e dimostrare un rapido ritorno sull'investimento (ROI).

5.1. Approccio graduale alla trasformazione digitale

Un percorso di trasformazione digitale di successo non dovrebbe iniziare con una revisione completa. Gli elevati costi di investimento iniziali e la complessità dell'integrazione di nuovi sistemi possono essere proibitivi, soprattutto per le piccole e medie imprese. Un approccio più efficace consiste nell'adottare un'implementazione graduale, iniziando con una Proof of Concept (PoC) su una singola linea di produzione pilota. Questo progetto su piccola scala e a basso rischio consente all'azienda di testare l'interoperabilità di nuovi sensori e software con l'infrastruttura esistente e di valutarne le prestazioni prima di impegnarsi in un'implementazione più ampia. Il ROI quantificato di questo successo iniziale può quindi essere utilizzato per costruire un business case convincente per un'implementazione più ampia. Questo approccio è in linea con i principi fondamentali dell'Industria 4.0, che enfatizzano l'interoperabilità, la capacità in tempo reale e la modularità.

5.2. Architettura di gestione e integrazione dei dati

Un'infrastruttura dati solida è la base di tutte le soluzioni predittive e basate sull'intelligenza artificiale. L'architettura dati deve essere in grado di gestire l'enorme volume e le diverse tipologie di dati generati da una fabbrica intelligente. Questo in genere comporta un approccio a più livelli che include uno storico dei dati e un data lake.

Storico dei dati:Uno storico dei dati è un database specializzato progettato per raccogliere, archiviare e gestire grandi quantità di dati temporali provenienti da processi industriali. Funge da archivio digitale meticolosamente organizzato, catturando ogni fluttuazione di temperatura, lettura della pressione e portata con una marca temporale precisa. Lo storico dei dati è lo strumento ottimale per gestire flussi di dati continui e ad alto volume provenienti dai sensori di processo ed è il "carburante perfetto" per analisi avanzate.

Lago di dati:Un data lake è un repository centrale che contiene dati grezzi nel loro formato nativo e può ospitare diverse tipologie di dati, tra cui dati strutturati di serie temporali, immagini non strutturate provenienti da telecamere di qualità e log delle macchine. Il data lake è progettato per gestire enormi quantità di dati eterogenei provenienti da ogni angolo di un'azienda, consentendo una visione end-to-end più olistica. Un'implementazione di successo richiede sia uno storico dei dati per i dati di processo principali sia un data lake per una visione più ampia e completa che consenta analisi complesse come l'analisi delle cause profonde e la correlazione con dati non provenienti da sensori.

Un'architettura logica a strati per l'integrazione dei dati potrebbe apparire come segue:

| Strato | Componente | Funzione | Tipo di dati |

| Bordo | Sensori IoT, gateway, PLC | Acquisizione dati in tempo reale ed elaborazione locale | Serie temporali, binarie, discrete |

| Fondazione dati | Storico dei dati | Archiviazione ad alte prestazioni e con timestamp dei dati di processo | Serie temporali strutturate |

| Deposito centrale | Lago di dati | Repository centralizzato e scalabile per tutte le fonti di dati | Strutturato, semi-strutturato, non strutturato |

| Analisi e intelligenza artificiale | Piattaforma di analisi | Esegue modelli predittivi, apprendimento automatico e business intelligence | Tutti i tipi di dati |

Tabella 5.1: Componenti chiave per l'integrazione e la gestione dei dati

5.3. Affrontare le sfide dell'integrazione dei sistemi legacy

Molti impianti chimici si affidano ancora a sistemi di tecnologia operativa (OT) vecchi di oltre un decennio, che spesso utilizzano protocolli proprietari incompatibili con gli standard moderni. La sostituzione di questi sistemi legacy, come i sistemi di controllo distribuito (DCS) o i controllori logici programmabili (PLC), è un progetto multimilionario che può causare significativi tempi di fermo della produzione. Una soluzione più pratica ed economica è quella di utilizzare gateway IoT e API come ponte.

I gateway IoT fungono da intermediari, traducendo i dati provenienti dai nuovi sensori IoT in un formato comprensibile anche per i sistemi più datati. Consentono alle aziende di implementare un monitoraggio avanzato senza dover ricorrere a una revisione completa, affrontando direttamente la barriera dei costi e rendendo le soluzioni proposte molto più accessibili. Inoltre, l'implementazione dell'edge computing, in cui i dati vengono elaborati direttamente alla fonte, può ridurre la larghezza di banda della rete e migliorare la reattività in tempo reale.

5.4. Decisione tra architettura on-premise e cloud

La decisione su dove ospitare le piattaforme di dati e analisi è fondamentale, con implicazioni significative in termini di costi, sicurezza e scalabilità. La scelta non è un semplice "o l'uno o l'altro", ma dovrebbe basarsi su un'attenta analisi dei casi d'uso specifici.

| Criterio | In sede | Nuvola |

| Controllare | Controllo completo su hardware, software e sicurezza. Ideale per settori altamente regolamentati. | Controllo meno diretto; modello di responsabilità condivisa. |

| Costo | Elevati costi iniziali dell'hardware; ammortamento e manutenzione sono a carico dell'azienda. | Costi iniziali più bassi con un modello "paga per quello che usi". |

| Scalabilità | Elasticità limitata; richiede provisioning manuale e investimenti di capitale per l'espansione. | Enorme scalabilità ed elasticità; può essere scalato in modo dinamico. |

| Latenza | Bassa latenza, poiché i dati sono fisicamente vicini alla fonte. | Potrebbe presentare una latenza eccessiva per alcuni carichi di lavoro di controllo in tempo reale. |

| Innovazione | Accesso più lento alle nuove tecnologie; richiede aggiornamenti manuali di software e hardware. | Set di funzionalità in rapida espansione con innovazioni come AI e ML. |

| Sicurezza | L'impresa è l'unica responsabile di tutte le pratiche di sicurezza. | Responsabilità condivisa con il fornitore, che gestisce numerosi livelli di sicurezza. |

Tabella 5.2: Matrice decisionale Cloud vs. On-Premise

Una strategia digitale di successo utilizza spesso un modello ibrido. Loop di controllo mission-critical a bassa latenza e dati di formulazione altamente proprietari possono essere conservati on-premise per la massima sicurezza e controllo. Allo stesso tempo, è possibile utilizzare una piattaforma cloud per un data lake centralizzato, consentendo analisi storiche a lungo termine, ricerca collaborativa con partner esterni e accesso a strumenti di intelligenza artificiale e apprendimento automatico all'avanguardia.

VI. Manuale pratico di ottimizzazione e diagnostica

Il vero valore del monitoraggio e della modellazione avanzati si realizza quando vengono utilizzati per creare strumenti fruibili per responsabili di produzione e ingegneri. Questi strumenti possono automatizzare e migliorare il processo decisionale, passando dalla risoluzione dei problemi reattiva al controllo proattivo basato su modelli.

6.1. Un quadro diagnostico basato su modelli

In un ambiente di produzione tradizionale, la risoluzione dei problemi è un processo manuale che richiede molto tempo e si basa sull'esperienza dell'operatore e su un approccio basato su tentativi ed errori. Un framework diagnostico basato su modelli automatizza questo processo utilizzando dati in tempo reale e output di modelli per identificare immediatamente la causa principale più probabile di un problema.

Il framework funziona come un albero decisionale o un diagramma di flusso logico. Quando viene rilevato un sintomo di difetto (ad esempio, una lettura anomala della viscosità da un viscosimetro in linea), il sistema correla automaticamente questo sintomo con i dati provenienti da altri sensori (ad esempio, temperatura, rapporto NCO/OH) e con i risultati dei modelli predittivi (ad esempio, il modello RSM per la durezza). Il sistema può quindi presentare all'operatore un elenco prioritario di potenziali cause profonde, riducendo i tempi di diagnosi da ore a minuti e consentendo un'azione correttiva molto più rapida. Questo approccio passa dalla semplice individuazione di un difetto all'identificazione e alla correzione proattiva del problema sottostante.

Figura 6.1: Un diagramma di flusso semplificato che illustra il processo di utilizzo dei dati dei sensori in tempo reale e dei modelli predittivi per guidare gli operatori verso una causa principale specifica e un'azione correttiva.

Questo approccio può essere riassunto in una matrice diagnostica che fornisce una guida di riferimento rapido per il pubblico di riferimento.

| Difetto/Sintomo | Flusso di dati rilevanti | Probabile causa principale |

| Durezza incoerente | Rapporto NCO/OH, profilo di temperatura | Rapporto materiale errato, profilo di temperatura non uniforme |

| Scarsa adesione | Temperatura superficiale, umidità | Preparazione impropria della superficie, interferenza dell'umidità ambientale |

| Bolle o macchie | Profilo di viscosità, temperatura | Componenti volatili, miscelazione impropria o profilo termico |

| Tempo di polimerizzazione incoerente | Rapporto NCO/OH, temperatura, velocità di alimentazione del catalizzatore | Concentrazione errata del catalizzatore, fluttuazione della temperatura |

| Struttura indebolita | Tempo di gelificazione, profilo di viscosità | Calore insufficiente, restringimento localizzato su un'area fredda |

Tabella 6.2: Matrice diagnostica difetto-intuizione

6.2. Procedure operative standard intelligenti (SOP)

Le Procedure Operative Standard (SOP) tradizionali sono documenti statici e cartacei che forniscono una guida rigida e dettagliata per i processi di produzione. Sebbene siano essenziali per standardizzare le operazioni e garantire la conformità, non sono in grado di tenere conto delle deviazioni di processo in tempo reale. Una "SOP intelligente" è una nuova generazione dinamica di procedure integrate con i dati di processo in tempo reale.

Ad esempio, una SOP tradizionale per un processo di miscelazione potrebbe specificare una temperatura e un tempo di miscelazione costanti. Una SOP intelligente, invece, sarebbe collegata ai sensori di temperatura e viscosità in tempo reale. Se un sensore rileva un calo della temperatura ambiente, la SOP intelligente potrebbe regolare dinamicamente il tempo o la temperatura di miscelazione richiesti per compensare la variazione, garantendo che la qualità del prodotto finale rimanga costante. Questo rende la SOP un documento dinamico e adattabile che aiuta gli operatori a prendere la decisione ottimale in un ambiente fluido e in tempo reale, riducendo al minimo la variabilità, riducendo gli errori e migliorando l'efficienza complessiva.

6.3. Ottimizzazione dei cicli di controllo

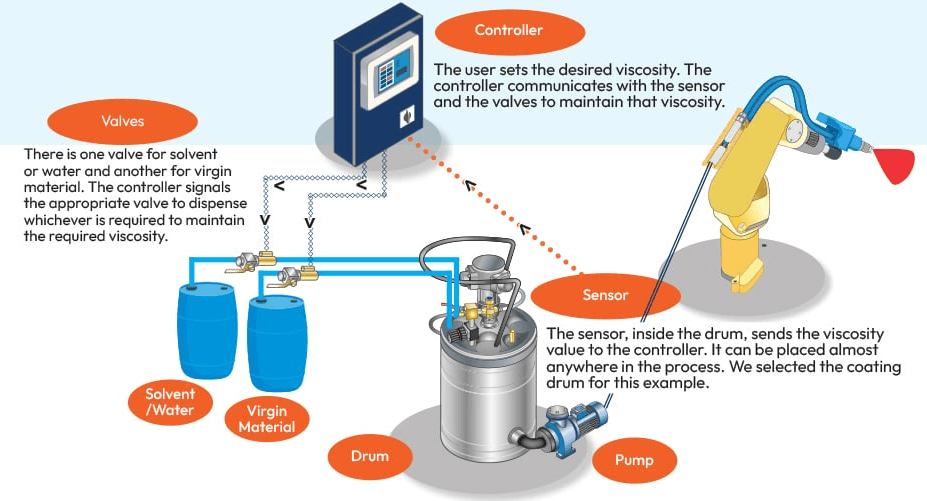

Il pieno valore dei sensori e dei modelli predittivi si esprime quando vengono integrati in un sistema che controlla attivamente il processo. Ciò implica l'applicazione delle migliori pratiche per la messa a punto dei circuiti di controllo e l'implementazione di strategie di controllo avanzate.

L'ottimizzazione del ciclo di controllo è un processo sistematico che inizia con una profonda comprensione del processo, la definizione dell'obiettivo di controllo e l'utilizzo di dati in tempo reale per ottimizzare il ciclo. Strategie di controllo di processo avanzato (APC), come il controllo a cascata e il controllo feed-forward, possono essere utilizzate per migliorare la stabilità e la reattività. L'obiettivo finale è chiudere il ciclo dati-azione: un sensore NIR in linea fornisce dati in tempo reale sul rapporto NCO/OH, un modello predittivo prevede il risultato e il ciclo di controllo utilizza queste informazioni per regolare automaticamente la pompa di alimentazione dell'isocianato, mantenendo il rapporto ottimale ed eliminando la variabilità. Il monitoraggio continuo delle prestazioni del ciclo è fondamentale per individuare eventuali derive, identificare problemi dei sensori e determinare quando è necessario ricalibrare il sistema prima che le prestazioni del processo peggiorino.

VII. Casi di studio e buone pratiche

I vantaggi del monitoraggio avanzato e della modellazione quantitativa non sono solo teorici; sono convalidati da successi concreti e da un ROI quantificabile. Le esperienze dei leader del settore forniscono insegnamenti preziosi e un convincente business case per la digitalizzazione.

7.1. Lezioni dai leader del settore

Gli sforzi di digitalizzazione delle principali aziende chimiche dimostrano una chiara tendenza: il successo deriva da una strategia olistica, end-to-end, non da un approccio frammentario.

DuPont:Hanno riconosciuto la necessità di una supply chain resiliente in un mercato volatile e hanno implementato una piattaforma digitale personalizzata per la modellazione di scenari "what-if". Ciò ha consentito loro di prendere decisioni aziendali più intelligenti e di distribuire efficacemente oltre 1.000 prodotti con capacità predittive avanzate. La lezione è che connettere sistemi eterogenei, dalla supply chain alle operations, a una piattaforma centralizzata fornisce una visione completa dell'intera catena del valore.

Covestro:Ha lanciato una strategia globale di digitalizzazione aziendale per creare un'unica "fonte di verità" centralizzata per i dati di progetto, abbandonando la dipendenza dai fogli di calcolo. Questo approccio integrato ha consentito di risparmiare il 90% del tempo precedentemente dedicato alla raccolta e alla convalida manuale dei dati, aumentandone significativamente l'affidabilità. L'azienda ha inoltre sfruttato la digitalizzazione per sviluppare nuovi prodotti più rapidamente e aumentare la qualità dei prodotti e la redditività della produzione.

SABIC:Implementazione di una piattaforma operativa digitale a livello aziendale che integra la qualità delle materie prime, i parametri di processo e le condizioni ambientali in strumenti predittivi digitali. Ad esempio, una soluzione di assistenza sanitaria basata sull'intelligenza artificiale è attiva in tutti gli stabilimenti dell'azienda a livello globale, prevedendo potenziali guasti delle apparecchiature critiche e consentendo una manutenzione proattiva. Questo approccio olistico ha portato a miglioramenti nell'efficienza energetica, nell'affidabilità degli asset e nell'impatto operativo.

7.2. ROI e benefici tangibili

Investire in queste tecnologie è una decisione aziendale strategica con un ritorno chiaro e sostanziale. Casi di studio provenienti da diversi settori forniscono una validazione convincente dei vantaggi finanziari e operativi.

Analisi predittiva:È stato dimostrato che il software AVEVA Predictive Analytics consente di ottenere risparmi in termini di efficienza fino a 37 milioni di dollari in 24 mesi, con una riduzione del 10% dei costi di manutenzione ricorrenti e l'eliminazione di 3.000 ore di manutenzione annue. Un'azienda petrolifera e del gas ha risparmiato 33 milioni di dollari utilizzando un sistema di allerta precoce basato sul cloud per rilevare anomalie nelle apparecchiature. Il programma di una raffineria ha prodotto un ROI triplicato e ha ridotto in modo sicuro del 27,4% il numero di punti di monitoraggio della corrosione.

Miglioramenti dell'efficienza:Un produttore di prodotti chimici speciali ha dovuto affrontare sfide complesse per ridurre i costi operativi e migliorare la prevedibilità della produzione. Implementando un'analisi completa per individuare opportunità di miglioramento, l'azienda ha ottenuto un significativo ROI di 2,7:1, con miglioramenti nella resa unitaria delle materie prime e un incremento della produzione unitaria.

Sicurezza e logistica:Un impianto di gas è riuscito a ridurre del 70% i tempi di evacuazione e di raccolta grazie all'automazione, dopo aver ripetutamente fallito gli audit di sicurezza. La piattaforma digitale di SABIC ha automatizzato i processi di documentazione manuale, che in precedenza richiedevano quattro giorni, riducendoli a un solo giorno, eliminando i principali colli di bottiglia ed evitando le penali per le soste.

Questi risultati dimostrano che le strategie proposte non sono un concetto astratto, bensì un percorso comprovato e quantificabile per raggiungere maggiore redditività, efficienza e sicurezza.

7.3. Caso di studio teorico: ottimizzazione del rapporto NCO/OH

Questo studio di caso finale illustra come i concetti presentati in questo rapporto possano essere applicati in un'unica narrazione coerente per risolvere un problema comune e costoso nella produzione di PU.

Scenario:Un produttore di rivestimenti in poliuretano riscontra incongruenze tra i lotti nella durezza del prodotto finale e nei tempi di polimerizzazione. I test di laboratorio tradizionali sono troppo lenti per diagnosticare il problema in tempo utile per salvare il lotto, con conseguente notevole spreco di materiale. Il team sospetta che la causa principale sia un rapporto NCO/OH fluttuante.

Soluzione:

Monitoraggio in tempo reale:Il team installa un sensore di spettroscopia NIR in tempo reale nella linea di alimentazione per monitorare costantemente il rapporto NCO/OH.2I dati provenienti da questo sensore vengono trasmessi in streaming a uno storico dati, fornendo una registrazione continua e accurata di questo parametro critico.

Modellazione quantitativa:Utilizzando i dati storici NIR, il team sviluppa un modello RSM che stabilisce la relazione precisa tra il rapporto NCO/OH e la durezza e il tempo di polimerizzazione del prodotto finale. Questo modello consente di determinare il rapporto ottimale per ottenere le proprietà desiderate e di prevedere la qualità finale di un lotto mentre è ancora nel reattore.

Rilevamento delle anomalie basato sull'intelligenza artificiale:Un modello di rilevamento delle anomalie basato sull'intelligenza artificiale viene implementato sul flusso di dati proveniente dal sensore NIR. Il modello apprende il normale profilo operativo del rapporto NCO/OH. Se rileva una deviazione da questo modello appreso, anche una piccola deriva graduale, invia un avviso tempestivo al team di produzione. Questo fornisce un avviso settimane prima che un problema venga rilevato tramite campionamento di laboratorio tradizionale.

Controllo automatizzato dei processi:Il passaggio finale è la chiusura del ciclo. Viene implementato un sistema di controllo predittivo che utilizza i dati in tempo reale provenienti dal sensore NIR per regolare automaticamente la pompa di alimentazione dell'isocianato. Questo elimina il fattore umano e garantisce che il rapporto NCO/OH sia mantenuto al valore ottimale durante tutta la reazione, eliminando la variabilità e garantendo una qualità costante.

Applicando questo quadro completo, il produttore può passare da un modello di produzione reattivo, basato sui difetti, a uno proattivo, basato sui dati, garantendo che ogni lotto soddisfi gli standard di qualità, riducendo gli sprechi e migliorando la redditività complessiva.

Data di pubblicazione: 08-09-2025