La production de revêtements et d'adhésifs en polyuréthane (PU) est un processus complexe en plusieurs étapes, régi par des réactions chimiques sensibles. Si la demande pour ces matériaux ne cesse de croître dans tous les secteurs industriels, leur fabrication présente des défis majeurs qui influent directement sur la qualité des produits, l'efficacité de la production et la rentabilité globale. Une compréhension approfondie de ces enjeux fondamentaux est essentielle à l'élaboration d'une feuille de route stratégique et pragmatique pour l'amélioration du processus.

1.1. Complexité et variabilité chimiques inhérentes : le défi du durcissement rapide

La production de polyuréthane est une réaction de polyaddition entre des polyols et des isocyanates, un procédé souvent rapide et fortement exothermique. La vitesse et la chaleur dégagées par cette réaction rendent son contrôle précis extrêmement difficile. Cette complexité intrinsèque est encore accrue par la sensibilité de la réaction à des facteurs externes tels que la température, l'humidité et la présence de catalyseurs. De faibles variations non maîtrisées de ces conditions environnementales ou des apports de matières premières peuvent entraîner des variations importantes des propriétés du produit final, notamment son temps de polymérisation et ses performances physiques.

Un défi fondamental dans ce contexte réside dans la courte durée de vie en pot de nombreux systèmes PU à durcissement rapide. Les échelles de temps de production de gaz et de réticulation du PU sont souvent trop brèves pour être compatibles avec les méthodes de caractérisation traditionnelles. Il s'agit d'un problème majeur, tant sur le plan technique qu'économique. Les procédures de contrôle qualité (CQ) classiques, qui consistent à prélever un échantillon du réacteur et à le transporter en laboratoire pour analyse, sont intrinsèquement imparfaites. Le titrage en laboratoire est un processus lent et, surtout, les propriétés chimiques de l'échantillon commencent à se modifier dès qu'il est retiré du réacteur et exposé aux conditions ambiantes. Ce délai signifie que les résultats d'analyse constituent une analyse a posteriori d'un lot déjà produit. Les données sont non seulement inexploitables, car arrivant trop tard pour permettre une intervention, mais aussi potentiellement inexactes, car elles ne reflètent plus l'état du matériau à l'intérieur de la cuve de production. Cette incompatibilité fondamentale entre le contrôle qualité traditionnel, basé sur le délai de réaction, et la cinétique rapide de la chimie du PU est le principal problème que la surveillance et la modélisation avancées doivent résoudre.

1.2. Causes profondes de l'incohérence des lots et de la formation des défauts

L'hétérogénéité d'un lot à l'autre et la formation de défauts ne sont pas le fruit du hasard, mais la conséquence directe d'un manque de précision dans le contrôle des paramètres critiques du procédé. Le produit final est extrêmement sensible au rapport des composants, à la technique de mélange et au profil de température tout au long du processus. Un mélange inadéquat, par exemple, peut entraîner une dispersion hétérogène des charges ou des durcisseurs, provoquant des contraintes internes et des défauts dans le produit final.

La précision de l'approvisionnement en matières premières, et notamment le rapport molaire isocyanate (NCO)/hydroxyle (OH), est primordiale pour garantir une qualité constante. Ce rapport NCO/OH détermine directement les propriétés du produit final : plus il est élevé, plus les propriétés physiques clés telles que la résistance à la traction, le module d'élasticité et la dureté sont importantes. Ce rapport influe également sur la viscosité et le comportement au durcissement du matériau. D'autres paramètres critiques du procédé, comme le profil thermique, sont tout aussi importants. Un chauffage insuffisant ou non uniforme peut entraîner un durcissement irrégulier et des retraits localisés, tandis que les composants volatils peuvent s'évaporer instantanément, provoquant l'apparition de bulles et d'imperfections.

Une analyse détaillée des causes profondes des défauts révèle qu'un seul capteur ou paramètre est souvent insuffisant pour un diagnostic précis. Un problème tel que « absence de gel ou polymérisation impossible » peut être dû à un dosage incorrect, une chaleur insuffisante ou un mélange inadéquat. Ces causes sont souvent interdépendantes. Par exemple, une température trop basse ralentit le processus de polymérisation et peut être confondue avec un problème de dosage des matériaux. Pour comprendre et traiter efficacement la cause profonde, il est nécessaire de mesurer simultanément plusieurs paramètres. Cela requiert un ensemble complet de capteurs capables de corréler des données en temps réel provenant de diverses sources afin d'isoler la véritable cause des symptômes observés, une tâche qui dépasse le cadre d'une surveillance traditionnelle à un seul point.

1.3. Impact économique et environnemental des inefficacités

Les difficultés techniques liées à la production de polyuréthane ont des répercussions économiques et environnementales directes et importantes. Les matières premières de haute qualité, telles que les polyols et les isocyanates, sont onéreuses et leurs prix fluctuent en raison des ruptures de la chaîne d'approvisionnement, de la dépendance au pétrole brut et de la demande mondiale. Lorsqu'un lot de produits ne répond pas aux spécifications de qualité, le gaspillage de matières premières représente une perte financière directe qui aggrave ces coûts élevés. Les arrêts de production imprévus, dus à la nécessité de diagnostiquer et de corriger les écarts de processus, constituent une autre source de pertes financières majeures.

Sur le plan environnemental, les inefficacités et le gaspillage inhérents aux méthodes de production traditionnelles constituent une préoccupation majeure. De nombreux revêtements polyuréthanes conventionnels sont à base de solvants et contribuent à la pollution atmosphérique par les émissions de composés organiques volatils (COV). Bien que les industries adoptent de plus en plus des alternatives à base d'eau et à faible teneur en COV, ces dernières n'atteignent souvent pas les performances des revêtements à base de solvants dans les applications exigeantes. De plus, les matières premières utilisées dans la production traditionnelle de polyuréthane sont issues du pétrole, non renouvelables et non biodégradables. Les produits défectueux, une fois mis au rebut, peuvent libérer des substances chimiques nocives dans l'environnement lors de leur dégradation, qui peut s'étaler sur une période allant jusqu'à 200 ans.

La convergence de ces facteurs économiques et environnementaux justifie pleinement la digitalisation. En mettant en œuvre les solutions proposées dans ce rapport, une entreprise peut simultanément réduire ses coûts, améliorer sa rentabilité et renforcer son profil de durabilité. La résolution du problème technique d'incohérence des lots permet d'atténuer directement les problèmes financiers et environnementaux, transformant ainsi une mise à niveau technique en un impératif stratégique pour l'entreprise.

Surveillance en ligne de la teneur en isocyanate libre dans le polyuréthane

II. Technologies avancées de surveillance en temps réel

Pour surmonter les difficultés inhérentes à la production de polyuréthane, il est essentiel de passer des tests traditionnels en laboratoire à une surveillance en ligne et en temps réel. Ce nouveau paradigme repose sur un ensemble de technologies de capteurs avancées capables de fournir des données continues et exploitables sur les paramètres critiques du procédé.

2.1. Surveillance rhéologique en ligne

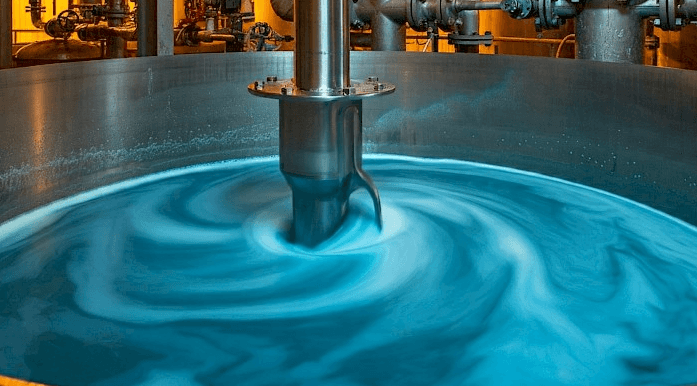

Les propriétés rhéologiques, telles que la viscosité et la densité, sont essentielles au succès d'une réaction de polymérisation du polyuréthane. Ce ne sont pas de simples caractéristiques physiques, mais des indicateurs directs des processus de polymérisation et de réticulation. Le suivi en temps réel de ces propriétés est assuré par des viscosimètres et des densimètres intégrés au procédé.

Des instruments tels queLonnrencontréerPolymerViscometeretViscosiMerciProcessorConçus pour une insertion directe dans les canalisations et les réacteurs, ces appareils permettent la mesure continue de la viscosité, de la densité et de la température d'un fluide. Fonctionnant selon le principe de la diapason vibrant, ils offrent une solution robuste, sans pièces mobiles et insensible aux vibrations externes et aux variations de débit. Cette technologie fournit une méthode non destructive et en temps réel pour suivre le processus de polymérisation. Le rapport molaire NCO/OH et la formation de liaisons polaires, par exemple, influent directement sur la viscosité, ce qui en fait un indicateur fiable de l'avancement de la réaction. En s'assurant que la viscosité reste dans une plage spécifiée, l'équipe de production peut confirmer le bon déroulement de la réaction et contrôler l'ajout d'allongeurs de chaîne pour atteindre la masse moléculaire et le degré de réticulation cibles. Ce contrôle précis en temps réel améliore la qualité du produit et réduit les déchets en évitant la production de lots non conformes.

2.2. Analyse spectroscopique de la composition chimique

Alors que les propriétés rhéologiques indiquent l'état physique du matériau,analyse spectroscopique en temps réelElle permet une compréhension plus approfondie de la réaction au niveau chimique. La spectroscopie proche infrarouge (NIR) est une méthode supérieure pour le suivi continu de la réaction principale grâce à la quantification de la concentration en isocyanate (%NCO) et en groupes hydroxyle.

Cette méthode représente une avancée significative par rapport au titrage traditionnel en laboratoire, lent et utilisant des produits chimiques nécessitant une élimination appropriée. La capacité d'un système NIR en temps réel à surveiller plusieurs points de procédé à partir d'un seul analyseur offre un avantage considérable en termes d'efficacité et de sécurité. Le rapport NCO/OH n'est pas seulement une variable de procédé ; il détermine directement les propriétés du produit final, notamment sa résistance à la traction, son module d'élasticité et sa dureté. En fournissant des données continues et en temps réel sur ce rapport critique, un capteur NIR permet d'ajuster proactivement les débits d'alimentation en matière. Ceci transforme le processus de contrôle, passant d'une approche réactive axée sur les défauts à une stratégie proactive de qualité par la conception, où un rapport NCO/OH précis est maintenu tout au long de la réaction afin de garantir un résultat de haute qualité.

2.3. Analyse diélectrique (DEA) pour le suivi de l'état de polymérisation

L'analyse diélectrique (DEA), également appelée analyse thermique diélectrique (DETA), est une technique performante pour le suivi du durcissement interne, processus invisible et crucial pour la qualité du produit final. Elle mesure directement les variations de viscosité et d'état de durcissement d'un matériau en appliquant une tension sinusoïdale et en mesurant les variations de mobilité des porteurs de charge (ions et dipôles). Au cours du durcissement, la viscosité du matériau augmente considérablement et la mobilité de ces porteurs de charge diminue, fournissant ainsi une mesure directe et quantifiable de la progression du durcissement.

La DEA permet de déterminer avec précision le point de gélification et la fin du processus de polymérisation, même pour les systèmes à polymérisation rapide. Elle offre une vision nuancée qui complète d'autres technologies. Alors qu'un viscosimètre en ligne mesure la viscosité globale du matériau, un capteur DEA fournit des informations sur la progression chimique de la réaction de réticulation. La combinaison d'unviscosimètre en ligne(mesurant lerésultatdu traitement) et un capteur DEA (mesurant leprogressionL'analyse DEA (analyse de la durée de cure) offre une vue d'ensemble complète et à deux niveaux du processus, permettant un contrôle et un diagnostic très précis. Elle peut également servir à surveiller l'efficacité de divers additifs et charges.

Une comparaison de ces technologies met en évidence leur complémentarité. Aucun capteur ne peut à lui seul fournir une image complète de la réaction complexe du polyuréthane. Une solution globale requiert l'intégration de plusieurs capteurs pour surveiller simultanément différentes propriétés physico-chimiques.

| Paramètre surveillé | Principe technologique | Principaux cas d'utilisation |

| Viscosité, température | Viscosimètre à fourche vibrante | Contrôle qualité des matières premières, surveillance des réactions en temps réel, détection du point final. |

| %NCO, nombre d'hydroxyle | Spectroscopie du proche infrarouge (NIR) | Surveillance en temps réel de la composition chimique, contrôle du rapport d'alimentation, optimisation du catalyseur. |

| État de durcissement, point de gel | Analyse diélectrique (DEA) | Surveillance du durcissement dans le moule, vérification du temps de gélification, analyse de l'efficacité des additifs. |

Tableau 2.1 : Comparaison des technologies de surveillance en ligne avancées pour la production de polyuréthane

III. Cadres de modélisation prédictive quantitative

Les flux de données riches issus des technologies de surveillance avancées sont indispensables à la numérisation, mais leur pleine valeur se révèle lorsqu'ils servent à élaborer des modèles prédictifs quantitatifs. Ces modèles transforment les données brutes en informations exploitables, permettant une compréhension plus approfondie du processus et une optimisation proactive.

3.1. Modélisation chimio-rhéologique et cinétique de polymérisation

La simple collecte de données issues de capteurs ne suffit pas à un véritable contrôle de procédé ; ces données doivent servir à élaborer un modèle expliquant le comportement sous-jacent de la réaction chimique. Les modèles chimio-rhéologiques et de cinétique de polymérisation établissent un lien entre la conversion chimique et les changements physiques, tels que l’augmentation de la viscosité et du temps de gélification. Ces modèles sont particulièrement précieux pour les systèmes à polymérisation rapide, où la nature transitoire du phénomène rend les analyses traditionnelles difficiles.5

Les méthodes isoconversionnelles, également appelées approches sans modèle, peuvent être appliquées à des données non isothermes pour prédire la cinétique de réaction des résines à polymérisation rapide. Ces modèles reposent sur une analyse thermo-chimio-rhéologique hautement couplée, prenant en compte l'interaction entre la température, la composition chimique et les propriétés d'écoulement du matériau. En construisant une représentation mathématique de la réaction complète, ces modèles permettent, au-delà d'une simple surveillance, une véritable compréhension du procédé. Ils peuvent prédire l'évolution de la viscosité au cours du temps pour un profil de température donné, ou encore l'influence d'un changement de catalyseur sur la vitesse de réaction, offrant ainsi un outil sophistiqué de contrôle et d'optimisation.

3.2. Analyse chimiométrique et régression multivariée

La production de polyuréthane est un processus multivarié où de nombreux facteurs interagissent pour déterminer la qualité du produit final. Les expérimentations traditionnelles à facteur unique sont chronophages et ne permettent pas de saisir les relations complexes et non linéaires entre les variables. Les techniques chimiométriques, telles que la régression par les moindres carrés partiels (PLS) et la méthodologie des surfaces de réponse (RSM), sont conçues pour relever ce défi.

La régression par les moindres carrés partiels (PLS) est une technique particulièrement adaptée à l'analyse de grands ensembles de données corrélées, comme celles générées par un spectromètre NIR en temps réel. La PLS permet de réduire le problème, initialement composé d'un grand nombre de variables interdépendantes, à un petit nombre de facteurs extraits, ce qui la rend idéale pour la prédiction. Dans le contexte de la production de polyuréthane, la PLS peut être utilisée pour diagnostiquer les problèmes de procédé et révéler la variation spatiale des variables de qualité au sein du produit.

La méthodologie des surfaces de réponse (MSR) est une méthode mathématique et statistique puissante, spécifiquement conçue pour la modélisation et l'optimisation des conditions expérimentales. La MSR permet d'analyser les effets combinés de plusieurs facteurs – tels que le rapport NCO/OH, le coefficient d'allongement de chaîne et la température de polymérisation – sur une variable de réponse donnée, comme la résistance à la traction. En positionnant stratégiquement les points expérimentaux dans les zones critiques, la MSR permet de caractériser avec précision les relations non linéaires sous-jacentes et les interactions entre les facteurs. Une étude a démontré l'efficacité de cette approche : un modèle a prédit les propriétés finales avec une précision remarquable de seulement 2,2 %, validant ainsi la méthodologie. La possibilité de cartographier l'intégralité de la « surface de réponse » pour un indicateur de qualité permet à l'ingénieur d'identifier simultanément la combinaison optimale de tous les facteurs, aboutissant à une solution supérieure.

3.3. Jumeau numérique du processus de production

Un jumeau numérique est une réplique virtuelle et dynamique d'un actif, d'un système ou d'un processus physique. Dans l'industrie chimique, cette réplique est alimentée par des données en temps réel provenant de capteurs IoT et de modèles prédictifs. Elle constitue une simulation vivante et très fidèle de la ligne de production. La véritable valeur d'un jumeau numérique réside dans sa capacité à offrir un environnement à faible risque pour une optimisation à fort enjeu.

La production de polyuréthane est un processus coûteux en raison du prix élevé des matières premières et de la forte consommation d'énergie. Réaliser des expériences physiques pour optimiser le processus représente donc une entreprise à haut risque et à coût élevé. Un jumeau numérique répond directement à ce défi en permettant aux ingénieurs d'exécuter des milliers de simulations sur un modèle virtuel, sans consommer de matières premières ni de temps de production. Cette capacité accélère non seulement la mise sur le marché des nouvelles formulations, mais réduit aussi considérablement le coût et le risque liés à l'optimisation du processus. De plus, les jumeaux numériques permettent de faire le lien entre les nouvelles technologies numériques et les systèmes existants en intégrant des données en temps réel issues de l'infrastructure existante, offrant ainsi un environnement numérique unifié sans nécessiter de refontes majeures.

IV. IA/Apprentissage automatique pour le contrôle des processus et la détection des anomalies

Les modèles prédictifs transforment les données en compréhension, mais l'intelligence artificielle (IA) et l'apprentissage automatique (AA) franchissent l'étape suivante : transformer la compréhension en action autonome et en contrôle intelligent.

4.1. Systèmes de détection d'anomalies et de pannes

Les systèmes de contrôle de processus traditionnels s'appuient sur des seuils statiques et prédéfinis pour déclencher des alarmes. Cette approche est sujette à erreurs, car elle peut ne pas détecter les écarts progressifs qui restent dans une plage acceptable ou générer des alarmes intempestives qui désensibilisent les opérateurs. La détection d'anomalies par l'IA représente un changement de paradigme majeur. Ces systèmes sont entraînés sur des données historiques pour apprendre les schémas de fonctionnement normaux d'un processus. Ils peuvent ensuite identifier et signaler automatiquement tout écart par rapport à ce schéma appris, même si un paramètre n'a pas encore franchi de seuil statique.

Par exemple, une augmentation progressive mais constante de la viscosité sur une période donnée, même si elle reste dans les limites acceptables, pourrait annoncer un problème imminent qu'un système traditionnel ne détecterait pas. Un système de détection d'anomalies par IA identifierait ce phénomène comme une anomalie et générerait une alerte précoce, permettant ainsi à l'équipe de prendre des mesures proactives pour éviter la production d'un lot défectueux. Cette capacité améliore considérablement le contrôle qualité en détectant les écarts par rapport aux spécifications, en réduisant le risque de produits défectueux et en garantissant la conformité.

4.2. Maintenance prédictive des actifs critiques

Les arrêts de production non planifiés représentent l'un des coûts les plus importants dans la production industrielle. Les stratégies de maintenance traditionnelles sont soit réactives (intervention ponctuelle en cas de panne), soit basées sur le temps (par exemple, le remplacement d'une pompe tous les six mois, quel que soit son état). La maintenance prédictive, grâce à l'apprentissage automatique, offre une alternative bien plus performante.

En analysant en continu les données en temps réel provenant de capteurs (vibrations, température, pression, etc.), ces modèles peuvent identifier les premiers signes de dégradation des équipements et prévoir les pannes potentielles. Le système peut fournir une estimation du temps avant panne, permettant ainsi à l'équipe de planifier les réparations lors d'un arrêt programmé, des semaines voire des mois à l'avance. Ceci élimine les temps d'arrêt coûteux liés à une panne imprévue et permet une meilleure planification des ressources humaines, des pièces détachées et de la logistique. Le retour sur investissement (RSI) de cette approche est substantiel et largement démontré par des études de cas. Par exemple, une raffinerie a triplé son RSI en mettant en œuvre un programme d'inspection proactif, tandis qu'une entreprise pétrolière et gazière a économisé des millions de dollars grâce à un système d'alerte précoce ayant détecté des anomalies sur les équipements. Ces avantages financiers concrets plaident en faveur du passage d'une stratégie de maintenance réactive à une stratégie de maintenance prédictive.

4.3. Contrôle prédictif de la qualité

Le contrôle qualité prédictif transforme radicalement le rôle de l'assurance qualité, passant d'un contrôle post-production à une fonction proactive intégrée au processus. Au lieu d'attendre les résultats des tests sur un produit final pour des propriétés telles que la dureté ou la résistance à la traction, les modèles d'apprentissage automatique analysent en continu les données de processus en temps réel provenant de tous les capteurs afin de prédire, avec un haut degré de fiabilité, les attributs de qualité finaux.

Un modèle prédictif de qualité permet d'identifier les interactions complexes entre la qualité des matières premières, les paramètres de procédé et les conditions environnementales afin de déterminer les paramètres de production optimaux pour un résultat souhaité. Si le modèle prédit que le produit final sera non conforme (par exemple, trop mou), il peut alerter l'opérateur, voire ajuster automatiquement un paramètre de procédé (par exemple, le débit d'alimentation du catalyseur) pour corriger l'écart en temps réel. Cette capacité contribue non seulement à prévenir les défauts avant même qu'ils ne surviennent, mais aussi à accélérer la recherche et le développement en fournissant des prédictions plus rapides des propriétés et en identifiant les tendances sous-jacentes dans les données. Cette approche est un impératif stratégique pour les fabricants qui cherchent à maximiser leur rendement et à améliorer leur efficacité opérationnelle.

V. Feuille de route pour la mise en œuvre technique

La mise en œuvre de ces solutions avancées exige une approche structurée et progressive qui prenne en compte la complexité de l'intégration des données et des infrastructures existantes. Une feuille de route bien définie est essentielle pour atténuer les risques et démontrer rapidement un retour sur investissement.

5.1. Approche progressive de la transformation numérique

Une transformation numérique réussie ne doit pas débuter par une refonte complète. Les coûts d'investissement initiaux élevés et la complexité de l'intégration de nouveaux systèmes peuvent être dissuasifs, notamment pour les PME. Une approche plus efficace consiste à adopter une mise en œuvre progressive, en commençant par une preuve de concept (PoC) sur une ligne de production pilote. Ce projet à petite échelle et à faible risque permet à une entreprise de tester l'interopérabilité des nouveaux capteurs et logiciels avec son infrastructure existante et d'évaluer les performances avant un déploiement plus large. Le retour sur investissement quantifié de ce succès initial peut ensuite servir à étayer un argumentaire commercial convaincant en faveur d'une mise en œuvre plus étendue. Cette approche est en accord avec les principes fondamentaux de l'Industrie 4.0, qui mettent l'accent sur l'interopérabilité, la capacité de traitement en temps réel et la modularité.

5.2. Architecture de gestion et d'intégration des données

Une infrastructure de données robuste est essentielle à toutes les solutions prédictives et basées sur l'IA. L'architecture de données doit pouvoir gérer le volume massif et la diversité des données générées par une usine intelligente. Cela implique généralement une approche par couches comprenant un système d'historisation des données et un lac de données.

Historien des données :Un système d'historisation de données est une base de données spécialisée conçue pour collecter, stocker et gérer de vastes quantités de données de séries temporelles issues de processus industriels. Il constitue une archive numérique rigoureusement organisée, enregistrant chaque fluctuation de température, chaque mesure de pression et chaque débit avec un horodatage précis. Le système d'historisation de données est l'outil idéal pour traiter les flux de données continus et volumineux provenant des capteurs de processus et représente le carburant parfait pour l'analyse avancée.

Lac de données :Un lac de données est un référentiel centralisé qui stocke les données brutes dans leur format natif et peut accueillir divers types de données, notamment des données de séries temporelles structurées, des images non structurées issues de caméras haute définition et des journaux machine. Conçu pour gérer les volumes massifs de données hétérogènes provenant de tous les services d'une entreprise, le lac de données permet d'obtenir une vision globale et intégrée. Sa mise en œuvre réussie requiert à la fois un système d'historisation des données pour les données de processus critiques et un lac de données pour une vue d'ensemble plus large et complète, permettant des analyses complexes telles que l'analyse des causes profondes et la corrélation avec des données non issues de capteurs.

Une architecture logique en couches pour l'intégration des données se présenterait comme suit :

| Couche | Composant | Fonction | Type de données |

| Bord | Capteurs IoT, passerelles, automates programmables | Acquisition de données en temps réel et traitement local | Séries temporelles, binaires, discrètes |

| Fondation de données | Historien des données | Stockage haute performance et horodaté des données de processus | Séries chronologiques structurées |

| Référentiel central | Lac de données | Référentiel centralisé et évolutif pour toutes les sources de données | Structuré, semi-structuré, non structuré |

| Analyse et IA | Plateforme analytique | Exploite des modèles prédictifs, l'apprentissage automatique et l'intelligence d'affaires | Tous les types de données |

Tableau 5.1 : Composants clés de l'intégration et de la gestion des données

5.3. Relever les défis liés à l'intégration des systèmes existants

De nombreuses usines chimiques utilisent encore des systèmes de technologies opérationnelles (TO) datant de plus de dix ans, souvent basés sur des protocoles propriétaires incompatibles avec les normes modernes. Le remplacement de ces systèmes obsolètes, tels que les systèmes de contrôle distribués (SCD) ou les automates programmables (API), représente un investissement de plusieurs millions de dollars susceptible d'entraîner des arrêts de production importants. Une solution plus pratique et économique consiste à utiliser des passerelles IoT et des API.

Les passerelles IoT servent d'intermédiaires, traduisant les données des nouveaux capteurs IoT en un format compatible avec les systèmes existants. Elles permettent à une entreprise de mettre en œuvre une surveillance avancée sans refonte complète, s'attaquant ainsi directement à l'obstacle du coût et rendant les solutions proposées beaucoup plus accessibles. De plus, le recours au edge computing, où les données sont traitées directement à la source, peut réduire la bande passante du réseau et améliorer la réactivité en temps réel.

5.4. Choix entre une architecture sur site et une architecture cloud

Le choix de l'hébergement des plateformes de données et d'analyse est crucial et a des répercussions importantes sur les coûts, la sécurité et l'évolutivité. Il ne s'agit pas d'un choix binaire, mais d'une analyse approfondie des cas d'usage spécifiques.

| Critère | Sur site | Nuage |

| Contrôle | Contrôle total du matériel, des logiciels et de la sécurité. Idéal pour les secteurs fortement réglementés. | Moins de contrôle direct ; un modèle de responsabilité partagée. |

| Coût | Coût initial élevé du matériel ; l'amortissement et la maintenance sont à la charge de l'entreprise. | Coût initial réduit grâce au modèle « paiement à l'usage ». |

| Évolutivité | Élasticité limitée ; nécessite un approvisionnement manuel et des investissements en capital pour évoluer. | Évolutivité et élasticité immenses ; peut augmenter et diminuer la capacité de manière dynamique. |

| Latence | Faible latence, car les données sont physiquement proches de la source. | Peut présenter une latence excessive pour certaines charges de travail de contrôle en temps réel. |

| Innovation | Accès plus lent aux nouvelles technologies ; nécessite des mises à jour manuelles des logiciels et du matériel. | Un ensemble de fonctionnalités en expansion rapide grâce à des innovations telles que l'IA et le ML. |

| Sécurité | L'entreprise est seule responsable de toutes les pratiques de sécurité. | Responsabilité partagée avec le fournisseur, qui gère de nombreuses couches de sécurité. |

Tableau 5.2 : Matrice de décision Cloud vs. Sur site

Une stratégie numérique performante repose souvent sur un modèle hybride. Les boucles de contrôle critiques à faible latence et les données de formulation hautement confidentielles peuvent être conservées sur site pour une sécurité et un contrôle optimaux. Parallèlement, une plateforme cloud peut être utilisée pour un lac de données centralisé, permettant l'analyse historique à long terme, la recherche collaborative avec des partenaires externes et l'accès à des outils d'IA et d'apprentissage automatique de pointe.

VI. Manuel pratique d'optimisation et de diagnostic

La véritable valeur de la surveillance et de la modélisation avancées se révèle lorsqu'elles servent à créer des outils concrets pour les responsables et les ingénieurs de production. Ces outils permettent d'automatiser et d'améliorer la prise de décision, en passant d'un dépannage réactif à un contrôle proactif et basé sur la modélisation.

6.1. Un cadre de diagnostic basé sur un modèle

Dans un environnement de production traditionnel, le dépannage d'une panne est un processus manuel et long qui repose sur l'expérience de l'opérateur et une approche empirique. Un cadre de diagnostic basé sur un modèle automatise ce processus en utilisant des données en temps réel et les résultats du modèle pour identifier instantanément la cause première la plus probable d'un problème.

Le système fonctionne comme un arbre de décision ou un organigramme logique. Lorsqu'un symptôme de défaut est détecté (par exemple, une mesure de viscosité anormale effectuée par un viscosimètre en ligne), le système met automatiquement ce symptôme en corrélation avec les données d'autres capteurs (par exemple, la température, le rapport NCO/OH) et les résultats des modèles prédictifs (par exemple, le modèle RSM pour la dureté). Le système peut alors présenter à l'opérateur une liste priorisée des causes potentielles, réduisant ainsi le temps de diagnostic de plusieurs heures à quelques minutes et permettant une intervention corrective beaucoup plus rapide. Cette approche permet de passer de la simple détection d'un défaut à l'identification et à la correction proactives du problème sous-jacent.

Figure 6.1 : Un organigramme simplifié illustrant le processus d'utilisation des données de capteurs en temps réel et des modèles prédictifs pour guider les opérateurs vers une cause racine spécifique et une action corrective.

Cette approche peut être résumée dans une matrice de diagnostic qui constitue un guide de référence rapide pour le public cible.

| Défaut/Symptôme | Flux de données pertinent | Cause probable |

| Dureté inconstante | Rapport NCO/OH, profil de température | Rapport de matériaux incorrect, profil de température non uniforme |

| Mauvaise adhérence | Température de surface, humidité | Préparation de surface inadéquate, interférence de l'humidité ambiante |

| Bulles ou imperfections | Profil de viscosité, température | Composants volatils, mélange inadéquat ou profil thermique |

| Temps de séchage irrégulier | Rapport NCO/OH, température, débit d'alimentation du catalyseur | Concentration de catalyseur incorrecte, fluctuation de température |

| Structure affaiblie | Temps de gélification, profil de viscosité | Chaleur insuffisante, retrait localisé sur une zone froide |

Tableau 6.2 : Matrice de diagnostic défaut-information

6.2. Procédures opérationnelles standard (POS) intelligentes

Les procédures opératoires standard (POS) traditionnelles sont des documents statiques sur support papier qui fournissent un guide rigide et détaillé des processus de fabrication. Bien qu'essentielles pour standardiser les opérations et garantir la conformité, elles ne permettent pas de prendre en compte les écarts de processus en temps réel. Une « PO intelligente » est une nouvelle génération de procédures dynamiques, intégrées aux données de processus en temps réel.

Par exemple, une procédure opératoire standard (POS) classique pour un processus de mélange peut spécifier une température et une durée de mélange constantes. Une POS intelligente, en revanche, serait reliée aux capteurs de température et de viscosité en temps réel. Si un capteur détecte une baisse de la température ambiante, la POS intelligente pourrait ajuster dynamiquement la durée ou la température de mélange requise pour compenser cette variation, garantissant ainsi la constance de la qualité du produit final. La POS devient alors un document vivant et adaptatif qui aide les opérateurs à prendre les décisions optimales dans un environnement dynamique et en temps réel, minimisant la variabilité, réduisant les erreurs et améliorant l'efficacité globale.

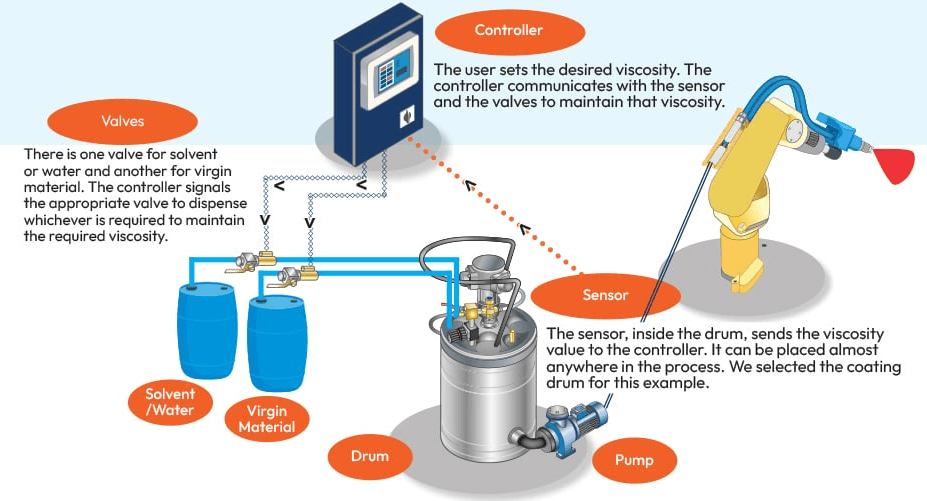

6.3. Optimisation des boucles de contrôle

Le plein potentiel des capteurs et des modèles prédictifs se révèle lorsqu'ils sont intégrés à un système de contrôle actif du processus. Cela implique l'application des meilleures pratiques pour le réglage des boucles de régulation et la mise en œuvre de stratégies de contrôle avancées.

L'optimisation de la boucle de régulation est un processus systématique qui débute par une compréhension approfondie du procédé, la définition de l'objectif de régulation, puis l'utilisation de données en temps réel pour optimiser la boucle. Les stratégies de contrôle avancé des procédés (APC), telles que la régulation en cascade et la régulation prédictive, permettent d'améliorer la stabilité et la réactivité. L'objectif final est de boucler le cycle données-action : un capteur NIR en ligne fournit des données en temps réel sur le rapport NCO/OH, un modèle prédictif anticipe le résultat, et la boucle de régulation utilise ces informations pour ajuster automatiquement la pompe d'alimentation en isocyanate, maintenant ainsi le rapport optimal et éliminant la variabilité. La surveillance continue des performances de la boucle est essentielle pour détecter les dérives, identifier les problèmes de capteurs et déterminer le moment opportun pour un réajustement avant toute dégradation des performances du procédé.

VII. Études de cas et meilleures pratiques

Les avantages d'une surveillance avancée et d'une modélisation quantitative ne sont pas purement théoriques ; ils sont validés par des réussites concrètes et un retour sur investissement quantifiable. L'expérience des leaders du secteur offre des enseignements précieux et une analyse de rentabilité convaincante en faveur de la numérisation.

7.1. Leçons tirées des leaders du secteur

Les efforts de numérisation des grandes entreprises chimiques démontrent une tendance claire : le succès repose sur une stratégie globale et intégrée, et non sur une approche fragmentée.

DuPont :Face à la nécessité d'une chaîne d'approvisionnement résiliente dans un marché volatil, l'entreprise a mis en place une plateforme numérique personnalisée pour la modélisation de scénarios hypothétiques. Cela lui a permis de prendre des décisions commerciales plus éclairées et de distribuer efficacement plus de 1 000 produits grâce à des capacités de prédiction améliorées. La leçon à retenir : connecter des systèmes hétérogènes – de la chaîne d'approvisionnement aux opérations – à une plateforme centralisée offre une vision globale de l'ensemble de la chaîne de valeur.

Covestro :L'entreprise a lancé une stratégie de digitalisation globale afin de centraliser les données de ses projets et de s'affranchir des tableurs. Cette approche intégrée a permis de réduire de 90 % le temps auparavant consacré à la collecte et à la validation manuelles des données, et d'améliorer significativement leur fiabilité. Grâce à la digitalisation, elle a également pu développer plus rapidement de nouveaux produits et accroître leur qualité et la rentabilité de sa production.

SABIC :Nous avons déployé une plateforme d'opérations numériques à l'échelle de l'entreprise, intégrant la qualité des matières premières, les paramètres de processus et les conditions environnementales dans des outils de prédiction numériques. Par exemple, une solution de gestion des actifs basée sur l'IA est déployée dans toutes nos usines à travers le monde, prédisant les pannes potentielles des équipements critiques et permettant une maintenance proactive. Cette approche globale a permis d'améliorer l'efficacité énergétique, la fiabilité des actifs et l'empreinte opérationnelle.

7.2. Retour sur investissement et avantages concrets

L'investissement dans ces technologies constitue une décision stratégique d'entreprise offrant un retour sur investissement clair et substantiel. Des études de cas issues de divers secteurs d'activité apportent une validation convaincante des avantages financiers et opérationnels.

Analyse prédictive :Le logiciel d'analyse prédictive d'AVEVA a permis de réaliser jusqu'à 37 millions de dollars d'économies en 24 mois, grâce à une réduction de 10 % des coûts de maintenance récurrents et à l'élimination de 3 000 heures de maintenance annuelles. Une entreprise pétrolière et gazière a économisé 33 millions de dollars en utilisant un système d'alerte précoce basé sur le cloud pour détecter les anomalies de ses équipements. Le programme d'une raffinerie a généré un retour sur investissement trois fois supérieur et a permis de réduire de 27,4 % le nombre de points de surveillance de la corrosion, en toute sécurité.

Améliorations en matière d'efficacité :Un fabricant de produits chimiques de spécialité était confronté à des difficultés pour réduire ses coûts d'exploitation et améliorer la prévisibilité de sa production. Grâce à une analyse approfondie permettant d'identifier les axes d'amélioration, il a obtenu un retour sur investissement significatif de 2,7:1, avec une amélioration du rendement unitaire des matières premières et une augmentation de la production unitaire.

Sécurité et logistique :Après avoir échoué à plusieurs reprises aux audits de sécurité, une usine de gaz a pu réduire de 70 % ses délais d'évacuation et de rassemblement grâce à l'automatisation. La plateforme numérique de SABIC a automatisé les processus de documentation manuels, qui prenaient auparavant quatre jours, les ramenant à une seule journée. Cette solution a permis d'éliminer les principaux goulets d'étranglement et d'éviter les frais de surestaries.

Ces résultats démontrent que les stratégies proposées ne constituent pas un concept abstrait, mais une voie éprouvée et quantifiable pour atteindre une rentabilité, une efficacité et une sécurité accrues.

7.3. Étude de cas théorique : Optimisation du rapport NCO/OH

Cette dernière étude de cas illustre comment les concepts présentés tout au long de ce rapport peuvent être appliqués dans un récit unique et cohérent pour résoudre un problème courant et coûteux dans la production de PU.

Scénario:Un fabricant de revêtements polyuréthanes constate des variations d'un lot à l'autre au niveau de la dureté et du temps de polymérisation du produit final. Les tests de laboratoire classiques sont trop lents pour diagnostiquer le problème à temps et sauver le lot, ce qui entraîne un gaspillage important de matière. L'équipe soupçonne qu'un rapport NCO/OH fluctuant en soit la cause.

Solution:

Surveillance en temps réel :L'équipe installe un capteur de spectroscopie NIR en temps réel sur la ligne d'alimentation afin de surveiller en continu le rapport NCO/OH.2Les données provenant de ce capteur sont transmises à un système d'historisation des données, fournissant un enregistrement continu et précis de ce paramètre critique.

Modélisation quantitative :À partir des données NIR historiques, l'équipe développe un modèle RSM qui établit la relation précise entre le rapport NCO/OH et la dureté et le temps de durcissement du produit final. Ce modèle leur permet de déterminer le rapport optimal pour obtenir les propriétés souhaitées et de prédire la qualité finale d'un lot directement dans le réacteur.

Détection d'anomalies par l'IA :Un modèle d'IA de détection d'anomalies est déployé sur le flux de données provenant du capteur NIR. Ce modèle apprend le profil de fonctionnement normal du rapport NCO/OH. S'il détecte un écart par rapport à ce profil – même une dérive légère et progressive – il envoie une alerte précoce à l'équipe de production. Cela permet d'être alerté plusieurs semaines avant qu'un problème ne soit détecté par un échantillonnage classique en laboratoire.

Contrôle automatisé des processus :L'étape finale consiste à boucler la boucle. Un système de contrôle prédictif est mis en œuvre, utilisant les données en temps réel du capteur NIR pour ajuster automatiquement la pompe d'alimentation en isocyanate. Ceci élimine l'intervention humaine et garantit le maintien du rapport NCO/OH à sa valeur optimale tout au long de la réaction, supprimant ainsi les variations et assurant une qualité constante.

En appliquant ce cadre global, le fabricant peut passer d'un modèle de production réactif, axé sur les défauts, à un modèle proactif, axé sur les données, garantissant ainsi que chaque lot réponde aux normes de qualité, réduisant les déchets et améliorant la rentabilité globale.

Date de publication : 8 septembre 2025