La producción de recubrimientos y adhesivos de poliuretano (PU) es un proceso complejo de varias etapas, regido por reacciones químicas sensibles. Si bien la demanda de estos materiales sigue creciendo en todos los sectores, su fabricación presenta una serie de desafíos fundamentales que afectan directamente la calidad del producto, la eficiencia de la producción y la rentabilidad general. Comprender a fondo estos aspectos fundamentales es fundamental para desarrollar una estrategia y una hoja de ruta práctica para la mejora.

1.1. Complejidad y variabilidad química inherente: el desafío del curado rápido

La producción de poliuretano es una reacción de poliadición entre polioles e isocianatos, un proceso que suele ser rápido y altamente exotérmico. La velocidad y el calor generados por esta reacción dificultan enormemente un control preciso. La complejidad inherente se ve agravada por la sensibilidad de la reacción a factores externos como la temperatura, la humedad y la presencia de catalizadores. Pequeñas fluctuaciones incontroladas en estas condiciones ambientales o en los insumos de material pueden provocar variaciones significativas en las propiedades del producto final, incluyendo su tiempo de curado y rendimiento físico.

Un desafío fundamental en este contexto es la corta vida útil de muchos sistemas de PU de curado rápido. Los plazos de producción de gas y reticulación del PU suelen ser demasiado breves para ser compatibles con los métodos tradicionales de caracterización. Este es un problema fundamental de ingeniería y económico. Los procedimientos tradicionales de control de calidad (CC), que implican tomar una muestra del reactor y transportarla a un laboratorio para su análisis, presentan deficiencias inherentes. El proceso de titulación en laboratorio es lento y, críticamente, las propiedades químicas de la muestra comienzan a cambiar en el momento en que se retira del reactor y se expone a las condiciones ambientales. Esta latencia significa que los resultados de laboratorio son un análisis post mortem de un lote ya producido. Los datos no solo no son procesables, ya que llegan demasiado tarde para permitir la intervención, sino que también son potencialmente inexactos, ya que ya no representan el estado del material dentro del recipiente de producción. Esta incompatibilidad fundamental del control de calidad tradicional, basado en retardos, con la rápida cinética de la química del PU es el principal problema que la monitorización y el modelado avanzados deben abordar.

1.2. Causas fundamentales de la inconsistencia de lotes y la formación de defectos

La inconsistencia entre lotes y la formación de defectos no son fenómenos aleatorios, sino consecuencia directa de la falta de precisión en el control de parámetros críticos del proceso. El producto final es muy sensible a la proporción de los componentes, la técnica de mezcla y el perfil de temperatura a lo largo del proceso. Una mezcla inadecuada, por ejemplo, puede dar lugar a una dispersión desigual de los rellenos o endurecedores, lo que provoca tensiones internas y defectos en el producto final.

La precisión en la entrada de la materia prima, en particular la relación molar de isocianato (NCO) a grupos hidroxilo (OH), es fundamental para mantener la continuidad de la calidad. Esta relación NCO/OH determina directamente las propiedades del producto final; a medida que aumenta, también lo hacen propiedades físicas clave como la resistencia a la tracción, el módulo y la dureza. La relación también afecta la viscosidad y el comportamiento de curado del material. Otras condiciones críticas del proceso, como el perfil térmico, son igualmente importantes. Un calentamiento insuficiente o no uniforme puede provocar un curado desigual y contracción localizada, mientras que los componentes volátiles pueden evaporarse, dando lugar a burbujas e imperfecciones.

Un análisis detallado de las causas raíz de los defectos revela que un solo sensor o parámetro suele ser insuficiente para un diagnóstico preciso. Un problema como "No se gelifica o no cura" podría deberse a una proporción de mezcla incorrecta, calor insuficiente o una mezcla inadecuada. Estas causas suelen estar interrelacionadas. Por ejemplo, una temperatura demasiado baja ralentiza el proceso de curado y puede diagnosticarse erróneamente como un problema con la proporción del material. Para comprender y abordar la causa raíz, es necesario medir múltiples parámetros simultáneamente. Esto requiere un conjunto completo de sensores que pueda correlacionar datos en tiempo real de diversas fuentes para aislar el verdadero factor causal de los síntomas resultantes, una tarea que va más allá del alcance de la monitorización tradicional de un solo punto.

1.3. Impacto económico y ambiental de las ineficiencias

Los desafíos técnicos en la producción de poliuretano tienen repercusiones económicas y ambientales directas y significativas. Las materias primas de alta calidad, como los polioles y los isocianatos, son caras y sus precios están sujetos a fluctuaciones debido a las discontinuidades en la cadena de suministro, la dependencia del petróleo crudo y la demanda global. Cuando un lote de productos no cumple con las especificaciones de calidad, el desperdicio de materias primas representa una pérdida financiera directa que agrava estos altos costos. Las paradas imprevistas, derivadas de la necesidad de solucionar problemas y corregir desviaciones del proceso, representan otra importante carga financiera.

En el ámbito medioambiental, las ineficiencias y los residuos inherentes a los métodos de producción tradicionales son una preocupación importante. Muchos recubrimientos de poliuretano convencionales son a base de disolventes y contribuyen a la contaminación atmosférica mediante las emisiones de compuestos orgánicos volátiles (COV). Si bien las industrias adoptan cada vez más alternativas a base de agua y con bajo contenido de COV, estas a menudo no alcanzan el rendimiento de sus homólogos a base de disolventes en aplicaciones de alto rendimiento. Además, las materias primas utilizadas en la producción tradicional de PU son derivadas del petróleo, no renovables ni biodegradables. Los productos defectuosos que terminan como residuos pueden liberar sustancias químicas nocivas al medio ambiente al descomponerse durante un periodo de hasta 200 años.

La convergencia de estos factores económicos y ambientales crea un sólido argumento comercial a favor de la digitalización. Al implementar las soluciones propuestas en este informe, una empresa puede, simultáneamente, reducir costos, mejorar la rentabilidad y optimizar su perfil de sostenibilidad. Abordar el problema técnico de la inconsistencia de lotes mitiga directamente los problemas financieros y ambientales, convirtiendo la actualización técnica en un imperativo estratégico para el negocio.

Monitoreo en línea del contenido de isocianato libre en poliuretano

II. Tecnologías avanzadas de monitoreo en tiempo real

Para superar los desafíos inherentes a la producción de PU, es esencial pasar de las pruebas tradicionales de laboratorio a la monitorización en línea en tiempo real. Este nuevo paradigma se basa en un conjunto de tecnologías avanzadas de sensores que pueden proporcionar datos continuos y procesables sobre parámetros críticos del proceso.

2.1. Monitoreo reológico en línea

Las propiedades reológicas, como la viscosidad y la densidad, son fundamentales para el éxito de una reacción de poliuretano. No son meras características físicas, sino que sirven como indicadores directos de los procesos de polimerización y reticulación. El monitoreo en tiempo real de estas propiedades se realiza mediante viscosímetros y densímetros de proceso en línea.

Instrumentos como elLonnse reunióerPolymerViscometeryViscosigraciasProcessorEstán diseñados para su inserción directa en tuberías y reactores, lo que permite la medición continua de la viscosidad, densidad y temperatura de un fluido. Estos dispositivos funcionan con principios como la tecnología de horquilla vibratoria, que es robusta, no requiere piezas móviles y es insensible a vibraciones externas y variaciones de caudal. Esta capacidad proporciona un método no destructivo y en tiempo real para el seguimiento del proceso de polimerización. La relación molar NCO/OH y la formación de enlaces polares, por ejemplo, afectan directamente la viscosidad, lo que la convierte en un indicador fiable del progreso de la reacción. Al garantizar que la viscosidad se mantenga dentro de un rango específico, el equipo de producción puede confirmar que la reacción se desarrolla según lo deseado y controlar la adición de extensores de cadena para alcanzar el peso molecular y la reticulación objetivo. Este control riguroso y en tiempo real mejora la calidad del producto y reduce el desperdicio al evitar la producción de lotes fuera de especificaciones.

2.2. Análisis espectroscópico de la composición química

Mientras que las propiedades reológicas indican el estado físico del material,análisis espectroscópico en tiempo realProporciona una comprensión más profunda de la reacción a nivel químico. La espectroscopia de infrarrojo cercano (NIR) es un método superior para la monitorización continua de la reacción central mediante la cuantificación de la concentración de isocianato (%NCO) y grupos hidroxilo.

Este método representa un avance significativo con respecto a la titulación tradicional en laboratorio, que es lenta y utiliza productos químicos que requieren una eliminación adecuada. La capacidad de un sistema NIR en tiempo real para monitorizar múltiples puntos del proceso desde un único analizador ofrece una ventaja significativa en términos de eficiencia y seguridad. La relación NCO/OH no es solo una variable del proceso; es un determinante directo de las propiedades del producto final, como la resistencia a la tracción, el módulo y la dureza. Al proporcionar datos continuos y en tiempo real sobre esta relación crítica, un sensor NIR permite el ajuste proactivo de las velocidades de alimentación del material. Esto transforma el proceso de control de un enfoque reactivo, basado en defectos, a una estrategia proactiva de calidad por diseño, donde se mantiene una relación NCO/OH precisa durante toda la reacción para garantizar un resultado de alta calidad.

2.3. Análisis dieléctrico (DEA) para la monitorización del estado de curado

El Análisis Dieléctrico (DEA), también conocido como Análisis Térmico Dieléctrico (DETA), es una técnica eficaz para monitorizar el "curado invisible en molde", crucial para la calidad del producto final. Mide directamente los cambios en la viscosidad y el estado de curado de un material aplicando un voltaje sinusoidal y midiendo los cambios resultantes en la movilidad de los portadores de carga (iones y dipolos). A medida que un material cura, su viscosidad aumenta drásticamente y la movilidad de estos portadores de carga disminuye, lo que proporciona una medida directa y cuantificable del progreso del curado.

El DEA puede determinar con precisión el punto de gelificación y el final del proceso de curado, incluso en sistemas de curado rápido. Ofrece una visión matizada que complementa otras tecnologías. Mientras que un viscosímetro en línea mide la viscosidad aparente total del material, un sensor DEA proporciona información sobre la progresión química de la reacción de reticulación. La combinación de unviscosímetro en línea(midiendo laresultadode la cura) y un sensor DEA (que mide laprogresiónEl análisis de la curación proporciona una visión integral del proceso en dos niveles, lo que permite un control y diagnóstico altamente precisos. La DEA también puede utilizarse para monitorizar la eficacia de diversos aditivos y rellenos.

Una comparación de estas tecnologías destaca su naturaleza complementaria. Ningún sensor por sí solo puede proporcionar una imagen completa de la compleja reacción del PU. Una solución integral requiere la integración de múltiples sensores para monitorizar simultáneamente diferentes propiedades físicas y químicas.

| Parámetros monitoreados | Principio de tecnología | Casos de uso principales |

| Viscosidad, Temperatura | Viscosímetro de horquilla vibratoria | Control de calidad de materia prima, monitoreo de reacción en tiempo real, detección de punto final. |

| %NCO, Número de hidroxilo | Espectroscopia de infrarrojo cercano (NIR) | Monitoreo de composición química en tiempo real, control de relación de alimentación, optimización del catalizador. |

| Estado de curado, punto de gel | Análisis dieléctrico (DEA) | Monitoreo de curado en molde, verificación del tiempo de gelificación, análisis de efectividad de aditivos. |

Tabla 2.1: Comparación de tecnologías avanzadas de monitoreo en línea para la producción de PU

III. Marcos de modelado predictivo cuantitativo

Los ricos flujos de datos provenientes de tecnologías de monitoreo avanzadas son un prerrequisito para la digitalización, pero su valor máximo se materializa cuando se utilizan para construir modelos predictivos cuantitativos. Estos modelos convierten los datos sin procesar en información práctica, lo que permite una comprensión más profunda del proceso y una transición hacia la optimización proactiva.

3.1. Modelado quimiorreológico y cinético de curado

La simple recopilación de datos de sensores no es suficiente para lograr un verdadero control del proceso; los datos deben utilizarse para construir un modelo que explique el comportamiento subyacente de la reacción química. Los modelos quimiorreológicos y de cinética de curado vinculan la conversión química con cambios físicos, como el aumento de la viscosidad y el tiempo de gelificación. Estos modelos son especialmente valiosos para sistemas de curado rápido, donde la naturaleza transitoria de un fenómeno dificulta el análisis tradicional.5

Los métodos isoconversionales, también conocidos como enfoques sin modelo, pueden aplicarse a datos no isotérmicos para predecir la cinética de reacción de resinas de curado rápido. Estos modelos implican un análisis termo-quimio-reológico altamente acoplado, lo que significa que consideran la interacción entre la temperatura, la composición química y las propiedades de flujo del material. Al construir una representación matemática de toda la reacción, estos modelos van más allá de la simple monitorización para proporcionar una comprensión real del proceso. Pueden predecir cómo cambiará la viscosidad con el tiempo para un perfil de temperatura determinado, o cómo un cambio en un catalizador alterará la velocidad de reacción, lo que proporciona una herramienta sofisticada para el control y la optimización.

3.2. Análisis quimiométrico y regresión multivariante

La producción de poliuretano es un proceso multivariable en el que interactúan múltiples factores para determinar la calidad del producto final. La experimentación tradicional, con un solo factor, requiere mucho tiempo y no logra captar las relaciones complejas y no lineales entre las variables. Las técnicas quimiométricas, como la regresión de mínimos cuadrados parciales (PLS) y la metodología de superficie de respuesta (MSR), están diseñadas para abordar este desafío.

La regresión de Mínimos Cuadrados Parciales (PLS) es una técnica ideal para el análisis de grandes conjuntos de datos correlacionados, como los generados por un espectrómetro NIR en tiempo real. PLS reduce el problema de un gran número de variables interrelacionadas a un pequeño número de factores extraídos, lo que la hace excelente para fines predictivos. En el contexto de la producción de poliuretano, PLS puede utilizarse para diagnosticar problemas de proceso y revelar cómo varían espacialmente las variables de calidad dentro del producto.

La Metodología de Superficie de Respuesta (MSR) es un potente método matemático y estadístico específico para modelar y optimizar condiciones experimentales. Permite analizar los efectos combinados de múltiples factores, como la relación NCO/OH, el coeficiente de extensión de cadena y la temperatura de curado, sobre una variable de respuesta deseada, como la resistencia a la tracción. Al ubicar estratégicamente los puntos experimentales en regiones críticas, la MSR puede caracterizar con precisión las relaciones no lineales subyacentes y los efectos interactivos entre los factores. Un estudio demostró la eficacia de este enfoque, con un modelo que predice las propiedades finales con un impresionante error de precisión de tan solo el 2,2 %, lo que proporciona una validación convincente de la metodología. La capacidad de mapear toda la "superficie de respuesta" para una métrica de calidad permite a los ingenieros identificar la combinación óptima de todos los factores simultáneamente, lo que resulta en una solución superior.

3.3. Gemelo digital del proceso de producción

Un gemelo digital es una réplica virtual y dinámica de un activo, sistema o proceso físico. En la fabricación de productos químicos, esta réplica se basa en datos en tiempo real de sensores IoT y modelos predictivos. Sirve como una simulación viva y de alta fidelidad de la línea de producción. El verdadero valor de un gemelo digital reside en su capacidad para proporcionar un entorno de bajo riesgo para la optimización de alto riesgo.

La producción de poliuretano es un proceso costoso debido al alto coste de las materias primas y al alto consumo energético. Por lo tanto, realizar experimentos físicos para optimizar el proceso es una tarea de alto riesgo y alto coste. Un gemelo digital aborda directamente este desafío, permitiendo a los ingenieros ejecutar miles de escenarios hipotéticos en un modelo virtual sin consumir materia prima ni tiempo de producción. Esta capacidad no solo acelera el tiempo de comercialización de nuevas formulaciones, sino que también reduce significativamente el coste y el riesgo de la optimización de procesos. Además, los gemelos digitales pueden acortar la distancia entre las nuevas tecnologías digitales y los sistemas heredados, integrando datos en tiempo real de la infraestructura existente, lo que proporciona un entorno digital unificado sin necesidad de amplias revisiones.

IV. IA/Aprendizaje automático para el control de procesos y la detección de anomalías

Los modelos predictivos transforman los datos en comprensión, pero la inteligencia artificial (IA) y el aprendizaje automático (ML) dan el siguiente paso: transformar la comprensión en acción autónoma y control inteligente.

4.1. Sistemas de detección de anomalías y fallas

Los sistemas tradicionales de control de procesos se basan en umbrales estáticos y predefinidos para activar las alarmas. Este enfoque es propenso a errores, ya que puede no detectar desviaciones graduales que se mantienen dentro de un rango aceptable o generar alarmas falsas que insensibilizan a los operadores. La detección de anomalías basada en IA representa un cambio de paradigma significativo. Estos sistemas se entrenan con datos históricos para aprender los patrones operativos normales de un proceso. Pueden identificar y marcar automáticamente cualquier desviación de este patrón aprendido, incluso si un parámetro aún no ha superado un umbral estático.

Por ejemplo, un aumento gradual pero constante de la viscosidad durante un período de tiempo específico, aunque se mantenga dentro del rango aceptable, podría ser el presagio de un problema inminente que un sistema tradicional pasaría por alto. Un sistema de detección de anomalías con IA reconocería esto como un patrón inusual y generaría una alerta temprana, lo que permitiría al equipo tomar medidas proactivas para prevenir un lote defectuoso. Esta capacidad mejora significativamente el control de calidad al detectar desviaciones de las especificaciones deseadas, reducir el riesgo de productos defectuosos y garantizar el cumplimiento normativo.

4.2. Mantenimiento predictivo para activos críticos

Las paradas no planificadas son uno de los costos más significativos en la fabricación industrial. Las estrategias de mantenimiento tradicionales son reactivas ("reparar cuando falla") o basadas en el tiempo (por ejemplo, cambiar una bomba cada seis meses, independientemente de su estado). El mantenimiento predictivo, basado en modelos de aprendizaje automático, ofrece una alternativa muy superior.

Al analizar continuamente datos en tiempo real de sensores (p. ej., vibración, temperatura, presión), estos modelos pueden identificar señales tempranas de degradación de los equipos y pronosticar posibles fallas. El sistema puede proporcionar un pronóstico del tiempo hasta la falla, lo que permite al equipo programar reparaciones durante una parada planificada con semanas o incluso meses de anticipación. Esto elimina el costoso tiempo de inactividad que supone una falla inesperada y permite una mejor planificación del personal, las piezas y la logística. El retorno de la inversión (ROI) de este enfoque es sustancial y está bien documentado en casos prácticos. Por ejemplo, una refinería triplicó su ROI al implementar un programa de inspección proactiva, mientras que una empresa de petróleo y gas ahorró millones de dólares con un sistema de alerta temprana que detectaba anomalías en los equipos. Estos beneficios financieros tangibles justifican la transición de una estrategia de mantenimiento reactivo a una predictiva.

4.3. Control de calidad predictivo

El control de calidad predictivo transforma radicalmente el papel del aseguramiento de la calidad, pasando de ser una simple comprobación posproducción a una función proactiva durante el proceso. En lugar de esperar a que se prueben propiedades como la dureza o la resistencia a la tracción del producto final, los modelos de aprendizaje automático pueden analizar continuamente los datos del proceso en tiempo real de todos los sensores para predecir, con un alto grado de confianza, cuáles serán los atributos de calidad finales.

Un modelo predictivo de calidad puede identificar la compleja interacción entre la calidad de la materia prima, los parámetros del proceso y las condiciones ambientales para determinar la configuración óptima de producción y obtener el resultado deseado. Si el modelo predice que el producto final no cumplirá con las especificaciones (por ejemplo, demasiado blando), puede alertar al operador o incluso ajustar automáticamente un parámetro del proceso (por ejemplo, la velocidad de alimentación del catalizador) para corregir la desviación en tiempo real. Esta capacidad no solo ayuda a prevenir defectos antes de que ocurran, sino que también acelera la investigación y el desarrollo al proporcionar predicciones más rápidas de las propiedades e identificar patrones subyacentes en los datos. Este enfoque es un imperativo estratégico para los fabricantes que buscan maximizar el rendimiento y mejorar la eficiencia operativa.

V. Hoja de ruta de implementación técnica

La implementación de estas soluciones avanzadas requiere un enfoque estructurado y por fases que aborde las complejidades de la integración de datos y la infraestructura heredada. Una hoja de ruta bien definida es esencial para mitigar el riesgo y demostrar un retorno de la inversión (ROI) temprano.

5.1. Enfoque por fases para la transformación digital

Una transformación digital exitosa no debería comenzar con una reestructuración a gran escala. Los altos costos de inversión inicial y la complejidad de integrar nuevos sistemas pueden resultar prohibitivos, especialmente para las pequeñas y medianas empresas. Un enfoque más eficaz consiste en adoptar una implementación por etapas, comenzando con una Prueba de Concepto (PoC) en una sola línea de producción piloto. Este proyecto a pequeña escala y de bajo riesgo permite a la empresa probar la interoperabilidad de los nuevos sensores y software con la infraestructura existente y evaluar el rendimiento antes de comprometerse con una implementación más amplia. El ROI cuantificado de este éxito inicial puede utilizarse posteriormente para elaborar un caso de negocio convincente para una implementación más amplia. Este enfoque se alinea con los principios fundamentales de la Industria 4.0, que priorizan la interoperabilidad, la capacidad en tiempo real y la modularidad.

5.2 Arquitectura de gestión e integración de datos

Una infraestructura de datos robusta es la base de todas las soluciones predictivas e impulsadas por IA. La arquitectura de datos debe ser capaz de gestionar el enorme volumen y la diversidad de datos que genera una fábrica inteligente. Esto suele implicar un enfoque en capas que incluye un historiador de datos y un lago de datos.

Historiador de datos:Un historiador de datos es una base de datos especializada diseñada para recopilar, almacenar y gestionar grandes cantidades de datos de series temporales de procesos industriales. Funciona como un archivo digital meticulosamente organizado, que captura cada fluctuación de temperatura, lectura de presión y caudal con una marca de tiempo precisa. El historiador de datos es la herramienta óptima para gestionar los flujos de datos continuos y de gran volumen procedentes de los sensores de proceso y es el combustible ideal para el análisis avanzado.

Lago de datos:Un lago de datos es un repositorio central que almacena datos sin procesar en su formato nativo y admite diversos tipos de datos, incluyendo datos de series temporales estructuradas, imágenes no estructuradas de cámaras de alta calidad y registros de máquinas. El lago de datos está diseñado para gestionar grandes cantidades de datos diversos provenientes de todos los ámbitos de una empresa, lo que permite una visión integral. Una implementación exitosa requiere un historiador de datos para los datos principales del proceso y un lago de datos para obtener una visión más amplia y completa que permita análisis complejos, como el análisis de causa raíz y la correlación con datos no provenientes de sensores.

Una arquitectura lógica en capas para la integración de datos se vería de la siguiente manera:

| Capa | Componente | Función | Tipo de datos |

| Borde | Sensores, puertas de enlace y PLC de IoT | Adquisición de datos en tiempo real y procesamiento local | Series temporales, binarias, discretas |

| Fundación de datos | Historiador de datos | Almacenamiento de datos de proceso de alto rendimiento y con marca de tiempo | Series temporales estructuradas |

| Repositorio central | Lago de datos | Repositorio centralizado y escalable para todas las fuentes de datos | Estructurado, semiestructurado, no estructurado |

| Análisis e IA | Plataforma de análisis | Ejecuta modelos predictivos, aprendizaje automático e inteligencia empresarial. | Todos los tipos de datos |

Tabla 5.1: Componentes clave de integración y gestión de datos

5.3. Abordar los desafíos de la integración de sistemas heredados

Muchas plantas químicas aún dependen de sistemas de tecnología operativa (TO) con más de una década de antigüedad, que a menudo utilizan protocolos propietarios incompatibles con los estándares modernos. Reemplazar estos sistemas heredados, como los Sistemas de Control Distribuido (DCS) o los Controladores Lógicos Programables (PLC), es un proyecto multimillonario que puede causar importantes paradas de producción. Una solución más práctica y rentable es utilizar pasarelas y API de IoT como puente.

Las puertas de enlace IoT actúan como intermediarios, traduciendo los datos de los nuevos sensores IoT a un formato que los sistemas antiguos pueden comprender. Permiten a las empresas implementar una monitorización avanzada sin una renovación completa, lo que elimina directamente la barrera de costes y hace que las soluciones propuestas sean mucho más accesibles. Además, la implementación de la computación en el borde, donde los datos se procesan directamente en la fuente, puede reducir el ancho de banda de la red y mejorar la capacidad de respuesta en tiempo real.

5.4. Decisión sobre arquitectura local o en la nube

La decisión de dónde alojar plataformas de datos y análisis es crucial, con importantes implicaciones para el coste, la seguridad y la escalabilidad. La elección no es una simple disyuntiva, sino que debe basarse en un análisis exhaustivo de los casos de uso específicos.

| Criterio | En las instalaciones | Nube |

| Control | Control total sobre hardware, software y seguridad. Ideal para industrias altamente reguladas. | Menos control directo; un modelo de responsabilidad compartida. |

| Costo | Los costos iniciales del hardware son elevados; la depreciación y el mantenimiento son responsabilidad de la empresa. | Costo inicial más bajo con un modelo de “pago por lo que usa”. |

| Escalabilidad | Elasticidad limitada; requiere aprovisionamiento manual e inversión de capital para escalar. | Gran escalabilidad y elasticidad; puede escalar hacia arriba y hacia abajo dinámicamente. |

| Estado latente | Baja latencia, ya que los datos están físicamente cerca de la fuente. | Puede tener una latencia excesiva para algunas cargas de trabajo de control en tiempo real. |

| Innovación | Acceso más lento a nuevas tecnologías; requiere actualizaciones manuales de software y hardware. | Conjunto de funciones en rápida expansión con innovaciones como IA y ML. |

| Seguridad | La empresa es la única responsable de todas las prácticas de seguridad. | Responsabilidad compartida con el proveedor, que maneja muchas capas de seguridad. |

Tabla 5.2: Matriz de decisión entre nube y local

Una estrategia digital exitosa suele utilizar un modelo híbrido. Los bucles de control de misión crítica y baja latencia, así como los datos de formulación altamente confidenciales, pueden almacenarse localmente para máxima seguridad y control. Simultáneamente, una plataforma en la nube puede utilizarse para un lago de datos centralizado, lo que permite el análisis histórico a largo plazo, la investigación colaborativa con socios externos y el acceso a herramientas de IA y ML de vanguardia.

VI. Manual práctico de optimización y diagnóstico

El verdadero valor de la monitorización y el modelado avanzados se aprecia cuando se utilizan para crear herramientas prácticas para los gerentes e ingenieros de producción. Estas herramientas pueden automatizar y optimizar el proceso de toma de decisiones, pasando de la resolución de problemas reactiva a un control proactivo basado en modelos.

6.1. Un marco de diagnóstico basado en modelos

En un entorno de fabricación tradicional, la resolución de problemas es un proceso manual y laborioso que depende de la experiencia del operador y de un enfoque de ensayo y error. Un marco de diagnóstico basado en modelos automatiza este proceso mediante el uso de datos en tiempo real y resultados del modelo para identificar al instante la causa raíz más probable de un problema.

El marco funciona como un árbol de decisiones o un diagrama de flujo lógico. Cuando se detecta un síntoma de defecto (p. ej., una lectura de viscosidad anormal en un viscosímetro en línea), el sistema correlaciona automáticamente este síntoma con los datos de otros sensores (p. ej., temperatura, relación NCO/OH) y los resultados de los modelos predictivos (p. ej., el modelo RSM para dureza). El sistema puede entonces presentar al operador una lista priorizada de posibles causas raíz, lo que reduce el tiempo de diagnóstico de horas a minutos y permite una acción correctiva mucho más rápida. Este enfoque pasa de simplemente encontrar un defecto a identificar y corregir proactivamente el problema subyacente.

Figura 6.1: Un diagrama de flujo simplificado que ilustra el proceso de uso de datos de sensores en tiempo real y modelos predictivos para guiar a los operadores hacia una causa raíz específica y una acción correctiva.

Este enfoque se puede resumir en una matriz de diagnóstico que proporciona una guía de referencia rápida para el público objetivo.

| Defecto/Síntoma | Flujo de datos relevante | Causa raíz probable |

| Dureza inconsistente | Relación NCO/OH, perfil de temperatura | Relación de material incorrecta, perfil de temperatura no uniforme |

| Mala adherencia | Temperatura de la superficie, humedad | Preparación inadecuada de la superficie, interferencia de la humedad ambiental |

| Burbujas o imperfecciones | Perfil de viscosidad, temperatura | Componentes volátiles, mezcla inadecuada o perfil térmico inadecuado |

| Tiempo de curado inconsistente | Relación NCO/OH, temperatura, velocidad de alimentación del catalizador | Concentración incorrecta del catalizador, fluctuación de temperatura |

| Estructura debilitada | Tiempo de gelificación, perfil de viscosidad | Calor insuficiente, contracción localizada en una zona fría |

Tabla 6.2: Matriz de diagnóstico de defectos a insight

6.2. Procedimientos operativos estándar (POE) inteligentes

Los Procedimientos Operativos Estándar (POE) tradicionales son documentos estáticos en papel que proporcionan una guía rígida y paso a paso para los procesos de fabricación. Si bien son esenciales para estandarizar las operaciones y garantizar el cumplimiento normativo, no pueden considerar las desviaciones del proceso en tiempo real. Un POE inteligente es una nueva generación de procedimientos dinámicos que se integra con los datos del proceso en tiempo real.

Por ejemplo, un POE tradicional para un proceso de mezcla podría especificar una temperatura y un tiempo de mezcla constantes. Un POE inteligente, por otro lado, estaría vinculado a los sensores de temperatura y viscosidad en tiempo real. Si un sensor detecta que la temperatura ambiente ha bajado, el POE inteligente podría ajustar dinámicamente el tiempo o la temperatura de mezcla requeridos para compensar el cambio, garantizando así la consistencia de la calidad del producto final. Esto convierte al POE en un documento dinámico y adaptable que ayuda a los operadores a tomar la decisión óptima en un entorno fluido y en tiempo real, minimizando la variabilidad, reduciendo errores y mejorando la eficiencia general.

6.3. Optimización de bucles de control

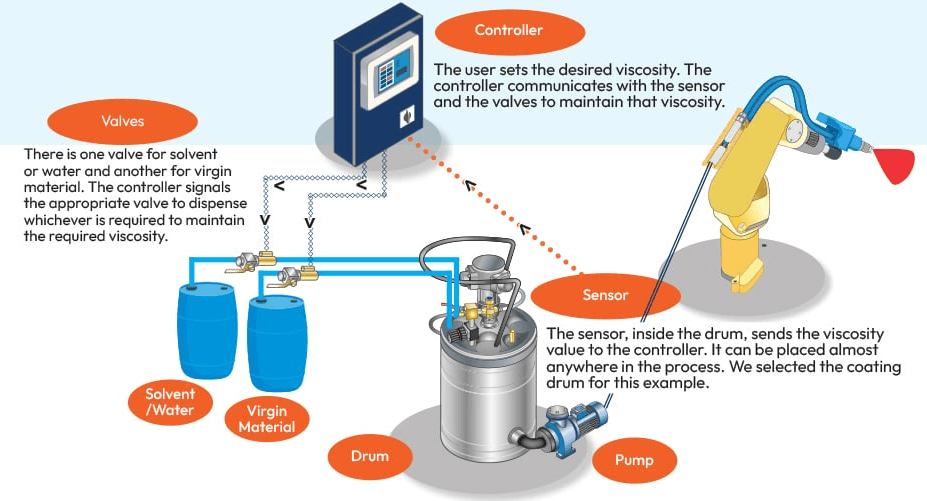

El valor total de los sensores y modelos predictivos se aprovecha al integrarlos en un sistema que controla activamente el proceso. Esto implica aplicar las mejores prácticas para ajustar los lazos de control e implementar estrategias de control avanzadas.

La optimización del bucle de control es un proceso sistemático que comienza con un profundo conocimiento del proceso, la definición del objetivo de control y el uso posterior de datos en tiempo real para ajustar el bucle. Las estrategias de Control Avanzado de Procesos (APC), como el control en cascada y el control de avance, pueden emplearse para mejorar la estabilidad y la capacidad de respuesta. El objetivo final es cerrar el ciclo de datos a la acción: un sensor NIR en línea proporciona datos en tiempo real sobre la relación NCO/OH, un modelo predictivo pronostica el resultado y el bucle de control utiliza esta información para ajustar automáticamente la bomba de alimentación de isocianato, manteniendo la relación óptima y eliminando la variabilidad. La monitorización continua del rendimiento del bucle es crucial para detectar desviaciones, identificar problemas en los sensores y determinar cuándo reajustar antes de que el rendimiento del proceso se degrade.

VII. Estudios de caso y mejores prácticas

Los beneficios de la monitorización avanzada y el modelado cuantitativo no son meramente teóricos; están validados por éxitos reales y un ROI cuantificable. Las experiencias de los líderes del sector ofrecen valiosas lecciones y un convincente argumento comercial a favor de la digitalización.

7.1. Lecciones de los líderes de la industria

Los esfuerzos de digitalización de las principales empresas químicas demuestran una tendencia clara: el éxito proviene de una estrategia holística de principio a fin, no de un enfoque fragmentado.

DuPont:Reconocieron la necesidad de una cadena de suministro resiliente en un mercado volátil e implementaron una plataforma digital personalizada para el modelado de escenarios hipotéticos. Esto les permitió tomar decisiones comerciales más inteligentes y distribuir eficazmente más de 1000 productos con capacidades de predicción mejoradas. La lección es que conectar sistemas dispares, desde la cadena de suministro hasta las operaciones, a una plataforma centralizada proporciona una visión integral de toda la cadena de valor.

Covestro:Se implementó una estrategia global de digitalización corporativa para crear una fuente única y centralizada de información veraz para los datos de los proyectos, eliminando así la dependencia de las hojas de cálculo. Este enfoque integrado ahorró el 90 % del tiempo que antes se dedicaba a la recopilación y validación manual de datos, y aumentó significativamente la fiabilidad. La empresa también aprovechó la digitalización para desarrollar nuevos productos con mayor rapidez y aumentar la calidad y la rentabilidad de la fabricación.

SABIC:Implementamos una Plataforma de Operaciones Digitales para toda la empresa que integra la calidad de la materia prima, los parámetros del proceso y las condiciones ambientales en herramientas predictivas digitales. Por ejemplo, una solución de atención médica de activos basada en IA opera en todas sus plantas a nivel mundial, previendo posibles fallas en equipos críticos y facilitando el mantenimiento proactivo. Este enfoque holístico ha impulsado mejoras en la eficiencia energética, la confiabilidad de los activos y la huella operativa.

7.2. ROI y beneficios tangibles

La inversión en estas tecnologías es una decisión empresarial estratégica con un retorno claro y sustancial. Estudios de caso de diversas industrias ofrecen una validación convincente de los beneficios financieros y operativos.

Análisis predictivo:Se ha demostrado que el software AVEVA Predictive Analytics logra un ahorro de eficiencia de hasta 37 millones de dólares en 24 meses, con una reducción del 10 % en los costes de mantenimiento recurrente y la eliminación de 3000 horas anuales de mantenimiento. Una empresa de petróleo y gas ahorró 33 millones de dólares mediante el uso de un sistema de alerta temprana basado en la nube para detectar anomalías en los equipos. El programa de una refinería triplicó el retorno de la inversión (ROI) y redujo de forma segura el número de puntos de monitorización de la corrosión en un 27,4 %.

Mejoras de eficiencia:Un fabricante de productos químicos especializados se enfrentó a desafíos para reducir los costos operativos y mejorar la previsibilidad de la producción. Mediante un análisis exhaustivo para identificar oportunidades de mejora, logró un significativo retorno de la inversión (ROI) de 2,7:1, con mejoras en el rendimiento unitario de la materia prima y un aumento en la producción unitaria.

Seguridad y Logística:Una planta de gas logró reducir los tiempos de evacuación y concentración en un 70 % mediante la automatización, tras fallar repetidamente en las auditorías de seguridad. La plataforma digital de SABIC automatizó los procesos de documentación manual, que anteriormente tomaban cuatro días, reduciendo el tiempo a solo un día, eliminando importantes cuellos de botella y evitando cargos por demora.

Estos resultados demuestran que las estrategias propuestas no son un concepto abstracto, sino un camino probado y cuantificable para lograr una mayor rentabilidad, eficiencia y seguridad.

7.3. Caso práctico teórico: Optimización de la relación NCO/OH

Este estudio de caso final ilustra cómo los conceptos presentados a lo largo de este informe pueden aplicarse en una narrativa única y coherente para resolver un problema común y costoso en la producción de PU.

Guión:Un fabricante de recubrimientos de PU experimenta inconsistencias entre lotes en la dureza y el tiempo de curado del producto final. Las pruebas de laboratorio tradicionales son demasiado lentas para diagnosticar el problema a tiempo y salvar el lote, lo que genera un desperdicio significativo de material. El equipo sospecha que la causa principal es una fluctuación en la relación NCO/OH.

Solución:

Monitoreo en tiempo real:El equipo instala un sensor de espectroscopia NIR en tiempo real en la línea de alimentación para monitorear continuamente la relación NCO/OH.2Los datos de este sensor se transmiten a un historiador de datos, lo que proporciona un registro continuo y preciso de este parámetro crítico.

Modelado cuantitativo:Utilizando los datos históricos de NIR, el equipo desarrolla un modelo RSM que establece la relación precisa entre la relación NCO/OH y la dureza y el tiempo de curado del producto final. Este modelo permite determinar la relación óptima para lograr las propiedades deseadas y predecir la calidad final de un lote mientras aún se encuentra en el reactor.

Detección de anomalías impulsada por IA:Se implementa un modelo de detección de anomalías con IA en el flujo de datos del sensor NIR. El modelo aprende el perfil operativo normal de la relación NCO/OH. Si detecta una desviación de este patrón aprendido, incluso una pequeña desviación gradual, envía una alerta temprana al equipo de producción. Esto proporciona una alerta semanas antes de que se hubiera detectado un problema mediante un muestreo de laboratorio tradicional.

Control automatizado de procesos:El paso final es cerrar el ciclo. Se implementa un sistema de control predictivo que utiliza los datos en tiempo real del sensor NIR para ajustar automáticamente la bomba de alimentación del isocianato. Esto elimina el factor humano y garantiza que la relación NCO/OH se mantenga en el valor óptimo durante toda la reacción, eliminando la variabilidad y garantizando una calidad constante.

Al aplicar este marco integral, el fabricante puede pasar de un modelo de producción reactivo e impulsado por defectos a uno proactivo e impulsado por datos, garantizando que cada lote cumpla con los estándares de calidad, reduciendo el desperdicio y mejorando la rentabilidad general.

Hora de publicación: 08-sep-2025