Die Herstellung von Polyurethan(PU)-Beschichtungen und -Klebstoffen ist ein komplexer, mehrstufiger Prozess, der von empfindlichen chemischen Reaktionen gesteuert wird. Obwohl die Nachfrage nach diesen Materialien branchenübergreifend stetig wächst, birgt ihre Fertigung eine Reihe zentraler Herausforderungen, die sich unmittelbar auf Produktqualität, Produktionseffizienz und Rentabilität auswirken. Ein umfassendes Verständnis dieser grundlegenden Aspekte ist entscheidend für die Entwicklung eines strategischen und praxisorientierten Fahrplans zur Verbesserung.

1.1. Inhärente chemische Komplexität und Variabilität: Die Herausforderung der Schnellhärtung

Die Polyurethanherstellung ist eine Polyadditionsreaktion zwischen Polyolen und Isocyanaten, ein Prozess, der oft schnell und stark exotherm abläuft. Die hohe Reaktionsgeschwindigkeit und die entstehende Wärme erschweren eine präzise Steuerung erheblich. Die inhärente Komplexität wird durch die Empfindlichkeit der Reaktion gegenüber externen Faktoren wie Temperatur, Luftfeuchtigkeit und der Anwesenheit von Katalysatoren noch verstärkt. Geringfügige, unkontrollierte Schwankungen dieser Umgebungsbedingungen oder der eingesetzten Materialien können zu signifikanten Abweichungen der Eigenschaften des Endprodukts führen, darunter Aushärtungszeit und physikalische Eigenschaften.

Eine grundlegende Herausforderung in diesem Zusammenhang ist die kurze Verarbeitungszeit vieler schnellhärtender PU-Systeme. Die Zeiträume der Gasbildung und der PU-Vernetzung sind oft zu kurz, um mit herkömmlichen Charakterisierungsmethoden vereinbar zu sein. Dies stellt ein zentrales technisches und wirtschaftliches Problem dar. Traditionelle Qualitätskontrollverfahren, bei denen eine Probe aus dem Reaktor entnommen und zur Analyse ins Labor transportiert wird, sind prinzipiell fehlerhaft. Die Labortitration ist langsam, und entscheidend ist, dass sich die chemischen Eigenschaften der Probe verändern, sobald sie aus dem Reaktor entnommen und der Umgebung ausgesetzt wird. Diese Latenz bedeutet, dass die Laborergebnisse eine nachträgliche Analyse einer bereits produzierten Charge darstellen. Die Daten sind nicht nur nicht verwertbar, da sie zu spät für ein Eingreifen eintreffen, sondern auch potenziell ungenau, da sie nicht mehr den Zustand des Materials im Produktionsbehälter widerspiegeln. Diese grundlegende Unvereinbarkeit der traditionellen, verzögerungsbasierten Qualitätskontrolle mit der schnellen Kinetik der PU-Chemie ist das Hauptproblem, das durch fortschrittliche Überwachung und Modellierung gelöst werden muss.

1.2. Hauptursachen für Chargeninkonsistenz und Fehlerbildung

Chargenabweichungen und die Entstehung von Defekten sind kein Zufall, sondern die direkte Folge ungenauen Kontrollierens kritischer Prozessparameter. Das Endprodukt reagiert äußerst empfindlich auf das Komponentenverhältnis, die Mischtechnik und das Temperaturprofil während des gesamten Prozesses. Eine fehlerhafte Mischung kann beispielsweise zu ungleichmäßig verteilten Füllstoffen oder Härtern führen und dadurch „eingebaute Spannungen“ und Defekte im Endprodukt verursachen.

Die präzise Dosierung der Rohstoffe, insbesondere das molare Verhältnis von Isocyanat- (NCO) zu Hydroxylgruppen (OH), ist entscheidend für die gleichbleibende Produktqualität. Dieses NCO/OH-Verhältnis bestimmt direkt die Eigenschaften des Endprodukts; mit steigendem Verhältnis verbessern sich wichtige physikalische Eigenschaften wie Zugfestigkeit, Elastizitätsmodul und Härte. Auch die Viskosität und das Aushärtungsverhalten des Materials werden durch das Verhältnis beeinflusst. Weitere kritische Prozessbedingungen, wie das Wärmeprofil, sind ebenso wichtig. Unzureichende oder ungleichmäßige Erwärmung kann zu ungleichmäßiger Aushärtung und lokalem Schrumpfen führen, während flüchtige Bestandteile verdampfen und Blasen und Fehler verursachen können.

Eine detaillierte Analyse der Fehlerursachen zeigt, dass ein einzelner Sensor oder Parameter für eine präzise Diagnose oft nicht ausreicht. Ein Problem wie „Keine Gelbildung oder Aushärtung ausbleibend“ kann beispielsweise durch ein falsches Mischungsverhältnis, unzureichende Wärme oder unsachgemäßes Mischen verursacht werden. Diese Ursachen hängen häufig zusammen. So verlangsamt beispielsweise eine zu niedrige Temperatur den Aushärtungsprozess und kann fälschlicherweise als Problem mit dem Materialverhältnis interpretiert werden. Um die eigentliche Ursache zu verstehen und zu beheben, ist die gleichzeitige Messung mehrerer Parameter erforderlich. Dies erfordert ein umfassendes Sensorsystem, das Echtzeitdaten aus verschiedenen Quellen korrelieren kann, um den wahren ursächlichen Faktor von den resultierenden Symptomen zu trennen – eine Aufgabe, die über die Möglichkeiten herkömmlicher Einzelpunktüberwachung hinausgeht.

1.3. Ökonomische und ökologische Auswirkungen von Ineffizienzen

Die technischen Herausforderungen in der Polyurethanproduktion haben direkte und erhebliche wirtschaftliche und ökologische Auswirkungen. Hochwertige Rohstoffe wie Polyole und Isocyanate sind teuer, und ihre Preise unterliegen Schwankungen aufgrund von Unterbrechungen in der Lieferkette, der Abhängigkeit von Rohöl und der globalen Nachfrage. Wenn eine Produktcharge die Qualitätsvorgaben nicht erfüllt, stellen die verschwendeten Rohstoffe einen direkten finanziellen Verlust dar, der diese hohen Kosten noch verschärft. Ungeplante Stillstandszeiten, die durch die Fehlersuche und die Korrektur von Prozessabweichungen entstehen, sind eine weitere erhebliche finanzielle Belastung.

Im Umweltbereich geben die Ineffizienzen und der Abfall, die traditionellen Produktionsmethoden innewohnen, Anlass zu erheblicher Besorgnis. Viele herkömmliche Polyurethanbeschichtungen basieren auf Lösemitteln und tragen durch die Freisetzung flüchtiger organischer Verbindungen (VOC) zur Luftverschmutzung bei. Obwohl die Industrie zunehmend auf wasserbasierte und VOC-arme Alternativen zurückgreift, erreichen diese in anspruchsvollen Anwendungen oft nicht die Leistungsfähigkeit ihrer lösemittelbasierten Pendants. Darüber hinaus sind die in der traditionellen PU-Produktion verwendeten Rohstoffe erdölbasiert, nicht erneuerbar und nicht biologisch abbaubar. Defekte Produkte, die im Abfall landen, können beim Abbau über einen Zeitraum von bis zu 200 Jahren schädliche Chemikalien in die Umwelt freisetzen.

Das Zusammenwirken dieser ökonomischen und ökologischen Faktoren schafft überzeugende Argumente für die Digitalisierung. Durch die Umsetzung der in diesem Bericht vorgeschlagenen Lösungen kann ein Unternehmen gleichzeitig Kosten senken, die Rentabilität steigern und seine Nachhaltigkeitsbilanz verbessern. Die Behebung des technischen Problems der Chargeninkonsistenz mindert die finanziellen und ökologischen Probleme direkt und macht eine technische Modernisierung zu einer strategischen Geschäftsnotwendigkeit.

Inline-Überwachung des Gehalts an freiem Isocyanat in Polyurethan

II. Fortschrittliche Echtzeit-Überwachungstechnologien

Um die systembedingten Herausforderungen der PU-Produktion zu bewältigen, ist ein Wechsel von traditionellen Labortests hin zu Echtzeit-Inline-Überwachung unerlässlich. Dieses neue Paradigma basiert auf einer Reihe fortschrittlicher Sensortechnologien, die kontinuierlich verwertbare Daten zu kritischen Prozessparametern liefern.

2.1. Inline-Rheologische Überwachung

Rheologische Eigenschaften wie Viskosität und Dichte sind für den Erfolg einer Polyurethanreaktion von grundlegender Bedeutung. Sie sind nicht nur physikalische Merkmale, sondern dienen als direkte Indikatoren für die Polymerisations- und Vernetzungsprozesse. Die Echtzeitüberwachung dieser Eigenschaften erfolgt mithilfe von Inline-Prozessviskosimetern und Dichtemessgeräten.

Instrumente wie dieLonntraferPolymerViscOmeterUndViscosiDankeProcessorDiese Geräte sind für den direkten Einbau in Rohrleitungen und Reaktoren konzipiert und ermöglichen die kontinuierliche Messung von Viskosität, Dichte und Temperatur einer Flüssigkeit. Sie arbeiten nach Prinzipien wie der Vibrationsgabeltechnologie, die robust ist, keine beweglichen Teile benötigt und unempfindlich gegenüber externen Vibrationen und Strömungsschwankungen ist. Dadurch lässt sich der Polymerisationsprozess zerstörungsfrei und in Echtzeit verfolgen. Das molare Verhältnis von NCO zu OH und die Bildung polarer Bindungen beeinflussen beispielsweise direkt die Viskosität und machen sie somit zu einem zuverlässigen Indikator für den Reaktionsfortschritt. Durch die Sicherstellung, dass die Viskosität innerhalb eines vorgegebenen Bereichs bleibt, kann das Produktionsteam bestätigen, dass die Reaktion wie gewünscht verläuft, und die Zugabe von Kettenverlängerern steuern, um das Zielmolekulargewicht und den gewünschten Vernetzungsgrad zu erreichen. Diese präzise Echtzeitkontrolle verbessert die Produktqualität und reduziert Ausschuss, indem die Produktion von Chargen außerhalb der Spezifikation verhindert wird.

2.2. Spektroskopische Analyse zur Bestimmung der chemischen Zusammensetzung

Während rheologische Eigenschaften den physikalischen Zustand des Materials anzeigen,Echtzeit-SpektroskopieanalyseSie ermöglicht ein tieferes Verständnis der Reaktion auf chemischer Ebene. Die Nahinfrarotspektroskopie (NIR) ist eine überlegene Methode zur kontinuierlichen Überwachung der Kernreaktion durch Quantifizierung der Isocyanatkonzentration (%NCO) und der Hydroxylgruppen.

Dieses Verfahren stellt einen bedeutenden Fortschritt gegenüber der herkömmlichen Labortitration dar, die langsam ist und Chemikalien verwendet, die fachgerecht entsorgt werden müssen. Die Fähigkeit eines Echtzeit-NIR-Systems, mehrere Prozesspunkte mit einem einzigen Analysator zu überwachen, bietet einen erheblichen Vorteil hinsichtlich Effizienz und Sicherheit. Das NCO/OH-Verhältnis ist nicht nur eine Prozessvariable, sondern bestimmt direkt die Eigenschaften des Endprodukts, darunter Zugfestigkeit, Elastizitätsmodul und Härte. Durch die kontinuierliche Bereitstellung von Echtzeitdaten zu diesem kritischen Verhältnis ermöglicht ein NIR-Sensor die proaktive Anpassung der Materialzufuhrraten. Dies wandelt den Steuerungsprozess von einem reaktiven, fehlerorientierten Ansatz zu einer proaktiven, qualitätsorientierten Designstrategie, bei der ein präzises NCO/OH-Verhältnis während der gesamten Reaktion aufrechterhalten wird, um ein qualitativ hochwertiges Ergebnis zu gewährleisten.

2.3. Dielektrische Analyse (DEA) zur Überwachung des Aushärtungszustands

Die dielektrische Analyse (DEA), auch bekannt als dielektrische Thermoanalyse (DETA), ist eine leistungsstarke Methode zur Überwachung der „unsichtbaren Aushärtung im Formwerkzeug“, die entscheidend für die Qualität des Endprodukts ist. Sie misst direkt die Veränderungen der Viskosität und des Aushärtungszustands eines Materials, indem sie eine sinusförmige Spannung anlegt und die daraus resultierenden Veränderungen der Beweglichkeit von Ladungsträgern (Ionen und Dipolen) erfasst. Während der Aushärtung steigt die Viskosität des Materials drastisch an, und die Beweglichkeit dieser Ladungsträger nimmt ab. Dies ermöglicht eine direkte und quantifizierbare Messung des Aushärtungsfortschritts.

Die DEA-Methode kann den Gelpunkt und das Ende des Aushärtungsprozesses präzise bestimmen, selbst bei schnellhärtenden Systemen. Sie bietet eine differenzierte Sichtweise, die andere Technologien ergänzt. Während ein Inline-Viskosimeter die Gesamtviskosität des Materials misst, liefert ein DEA-Sensor Einblicke in den chemischen Verlauf der Vernetzungsreaktion. Die Kombination ausInline-Viskosimeter(Messung derErgebnisder Heilung) und ein DEA-Sensor (der dieProgressionDie DEA (des Heilungsprozesses) bietet eine umfassende, zweistufige Sicht auf den Prozess, die eine hochpräzise Steuerung und Diagnose ermöglicht. Sie kann auch zur Überwachung der Wirksamkeit verschiedener Zusatzstoffe und Füllstoffe eingesetzt werden.

Ein Vergleich dieser Technologien verdeutlicht ihre komplementäre Natur. Kein einzelner Sensor kann ein vollständiges Bild der komplexen PU-Reaktion liefern. Eine ganzheitliche Lösung erfordert die Integration mehrerer Sensoren, um verschiedene physikalische und chemische Eigenschaften gleichzeitig zu überwachen.

| Überwachter Parameter | Technologieprinzip | Primäre Anwendungsfälle |

| Viskosität, Temperatur | Vibrationsgabel-Viskosimeter | Qualitätskontrolle der Rohstoffe, Echtzeit-Reaktionsüberwachung, Endpunkterkennung. |

| %NCO, Hydroxylzahl | Nahinfrarotspektroskopie (NIR) | Chemische Zusammensetzungsüberwachung in Echtzeit, Steuerung des Zufuhrverhältnisses, Katalysatoroptimierung. |

| Aushärtungszustand, Gelpunkt | Dielektrische Analyse (DEA) | Überwachung der Aushärtung in der Form, Überprüfung der Gelierzeit, Analyse der Wirksamkeit von Additiven. |

Tabelle 2.1: Vergleich fortschrittlicher Inline-Überwachungstechnologien für die PU-Produktion

III. Rahmenwerke für quantitative Vorhersagemodelle

Die umfangreichen Datenströme moderner Überwachungstechnologien sind zwar Voraussetzung für die Digitalisierung, ihr volles Potenzial entfalten sie jedoch erst beim Aufbau quantitativer Vorhersagemodelle. Diese Modelle übersetzen Rohdaten in handlungsrelevante Erkenntnisse und ermöglichen so ein tieferes Prozessverständnis sowie eine proaktive Optimierung.

3.1. Chemorheologische und Aushärtungskinetische Modellierung

Die bloße Erfassung von Sensordaten reicht für eine umfassende Prozesskontrolle nicht aus; die Daten müssen vielmehr zur Entwicklung eines Modells genutzt werden, das das zugrundeliegende Verhalten der chemischen Reaktion erklärt. Chemorheologische und Aushärtungskinetikmodelle verknüpfen die chemische Umwandlung mit physikalischen Veränderungen, wie beispielsweise der Viskositätszunahme und der Gelierzeit. Diese Modelle sind besonders wertvoll für schnellhärtende Systeme, bei denen die transiente Natur eines Phänomens herkömmliche Analysemethoden erschwert.5

Isokonversionelle Methoden, auch modellfreie Ansätze genannt, können auf nicht-isotherme Daten angewendet werden, um die Reaktionskinetik schnellhärtender Harze vorherzusagen. Diese Modelle beinhalten eine stark gekoppelte thermo-chemo-rheologische Analyse, d. h. sie berücksichtigen das Zusammenspiel von Temperatur, chemischer Zusammensetzung und Fließeigenschaften des Materials. Durch die mathematische Darstellung der gesamten Reaktion ermöglichen diese Modelle ein umfassendes Prozessverständnis, das über die einfache Überwachung hinausgeht. Sie können vorhersagen, wie sich die Viskosität im Laufe der Zeit bei einem gegebenen Temperaturprofil verändert oder wie sich eine Änderung des Katalysators auf die Reaktionsgeschwindigkeit auswirkt. Damit bieten sie ein hochentwickeltes Werkzeug zur Steuerung und Optimierung.

3.2. Chemometrische Analyse und multivariate Regression

Die Polyurethanherstellung ist ein komplexer Prozess, bei dem zahlreiche Faktoren die Qualität des Endprodukts beeinflussen. Herkömmliche, einfaktorielle Experimente sind zeitaufwendig und erfassen die komplexen, nichtlinearen Zusammenhänge zwischen den Variablen nicht. Chemometrische Verfahren wie die Partial Least Squares (PLS)-Regression und die Response Surface Methodology (RSM) wurden entwickelt, um diese Herausforderung zu bewältigen.

Die Partial Least Squares (PLS)-Regression ist eine Technik, die sich hervorragend zur Analyse großer, korrelierter Datensätze eignet, wie sie beispielsweise von einem Echtzeit-NIR-Spektrometer erzeugt werden. PLS reduziert das Problem von einer Vielzahl miteinander verknüpfter Variablen auf eine geringe Anzahl extrahierter Faktoren und ist daher ideal für Vorhersagezwecke. In der Polyurethanproduktion kann PLS zur Diagnose von Prozessproblemen und zur Aufdeckung räumlicher Variationen von Qualitätsvariablen innerhalb des Produkts eingesetzt werden.

Die Response Surface Methodology (RSM) ist eine leistungsstarke mathematische und statistische Methode zur Modellierung und Optimierung von Versuchsbedingungen. Mit RSM lassen sich die kombinierten Effekte mehrerer Faktoren – wie beispielsweise des NCO/OH-Verhältnisses, des Kettenverlängerungskoeffizienten und der Aushärtungstemperatur – auf eine gewünschte Zielgröße wie die Zugfestigkeit analysieren. Durch die strategische Platzierung von Messpunkten in kritischen Bereichen kann RSM die zugrundeliegenden nichtlinearen Zusammenhänge und Wechselwirkungen zwischen den Faktoren präzise charakterisieren. Eine Studie belegte die Effektivität dieses Ansatzes: Ein Modell sagte die Endprodukteigenschaften mit einer beeindruckenden Genauigkeit von nur 2,2 % voraus und lieferte damit eine überzeugende Validierung der Methodik. Die Möglichkeit, die gesamte „Antwortfläche“ für eine Qualitätskennzahl abzubilden, ermöglicht es Ingenieuren, die optimale Kombination aller Faktoren gleichzeitig zu identifizieren und so eine überlegene Lösung zu erzielen.

3.3. Digitaler Zwilling des Produktionsprozesses

Ein digitaler Zwilling ist ein dynamisches, virtuelles Abbild eines physischen Objekts, Systems oder Prozesses. In der chemischen Produktion wird dieses Abbild durch Echtzeitdaten von IoT-Sensoren und prädiktiven Modellen gespeist. Es dient als lebendige, hochpräzise Simulation der Produktionslinie. Der wahre Wert eines digitalen Zwillings liegt in seiner Fähigkeit, ein risikoarmes Umfeld für Optimierungen mit hohem Einsatz zu schaffen.

Die Polyurethanproduktion ist aufgrund teurer Rohstoffe und hohem Energieverbrauch ein kostenintensiver Prozess. Physikalische Experimente zur Prozessoptimierung sind daher mit hohen Risiken und Kosten verbunden. Ein digitaler Zwilling begegnet dieser Herausforderung, indem er Ingenieuren ermöglicht, Tausende von „Was-wäre-wenn“-Szenarien an einem virtuellen Modell durchzuspielen – ohne Rohstoffe oder Produktionszeit zu verbrauchen. Diese Fähigkeit beschleunigt nicht nur die Markteinführung neuer Rezepturen, sondern reduziert auch Kosten und Risiken der Prozessoptimierung erheblich. Darüber hinaus können digitale Zwillinge die Lücke zwischen neuen digitalen Technologien und älteren Systemen schließen, indem sie Echtzeitdaten aus der bestehenden Infrastruktur integrieren. So entsteht eine einheitliche digitale Umgebung ohne umfangreiche Systemerneuerungen.

IV. KI/Maschinelles Lernen für Prozesssteuerung und Anomalieerkennung

Vorhersagemodelle wandeln Daten in Erkenntnisse um, aber künstliche Intelligenz (KI) und maschinelles Lernen (ML) gehen den nächsten Schritt: Sie wandeln Erkenntnisse in autonomes Handeln und intelligente Steuerung um.

4.1. Anomalie- und Fehlererkennungssysteme

Herkömmliche Prozessleitsysteme nutzen statische, fest codierte Schwellenwerte zur Alarmauslösung. Dieser Ansatz ist fehleranfällig, da er schleichende Abweichungen innerhalb eines akzeptablen Bereichs nicht erkennen oder Fehlalarme generieren kann, die die Bediener abstumpfen. KI-gestützte Anomalieerkennung stellt einen bedeutenden Paradigmenwechsel dar. Diese Systeme werden anhand historischer Daten trainiert, um die normalen Betriebsmuster eines Prozesses zu erlernen. Anschließend können sie Abweichungen von diesem gelernten Muster automatisch erkennen und melden, selbst wenn ein Parameter einen statischen Schwellenwert noch nicht überschritten hat.

Beispielsweise könnte ein allmählicher, aber stetiger Viskositätsanstieg über einen bestimmten Zeitraum, selbst wenn er noch im zulässigen Bereich liegt, ein Vorbote eines drohenden Problems sein, das ein herkömmliches System nicht erkennen würde. Ein KI-gestütztes Anomalieerkennungssystem würde dies als ungewöhnliches Muster erkennen und eine Frühwarnung ausgeben, sodass das Team proaktiv Maßnahmen ergreifen und eine fehlerhafte Charge verhindern kann. Diese Funktion verbessert die Qualitätskontrolle erheblich, indem sie Abweichungen von den gewünschten Spezifikationen erkennt, das Risiko fehlerhafter Produkte reduziert und die Einhaltung der Vorschriften sicherstellt.

4.2. Vorausschauende Instandhaltung kritischer Anlagen

Ungeplante Ausfallzeiten zählen zu den größten Kostenfaktoren in der industriellen Fertigung. Herkömmliche Instandhaltungsstrategien sind entweder reaktiv („Reparieren, wenn es kaputt ist“) oder zeitbasiert (z. B. Austausch einer Pumpe alle sechs Monate, unabhängig von ihrem Zustand). Vorausschauende Instandhaltung, unterstützt durch Modelle des maschinellen Lernens, bietet eine deutlich überlegene Alternative.

Durch die kontinuierliche Analyse von Echtzeitdaten von Sensoren (z. B. Vibration, Temperatur, Druck) können diese Modelle frühzeitig Anzeichen von Geräteverschleiß erkennen und potenzielle Ausfälle vorhersagen. Das System liefert eine Ausfallprognose, sodass Reparaturen im Rahmen geplanter Stillstände Wochen oder sogar Monate im Voraus eingeplant werden können. Dadurch werden kostspielige Ausfallzeiten durch unerwartete Störungen vermieden und die Planung von Personal, Ersatzteilen und Logistik optimiert. Der Return on Investment (ROI) dieses Ansatzes ist beträchtlich und in Fallstudien umfassend dokumentiert. So erzielte beispielsweise eine Raffinerie durch die Implementierung eines proaktiven Inspektionsprogramms einen dreifachen ROI, während ein Öl- und Gasunternehmen mit einem Frühwarnsystem, das Geräteanomalien erkannte, Millionen von Dollar einsparte. Diese konkreten finanziellen Vorteile sprechen für den Übergang von einer reaktiven zu einer vorausschauenden Instandhaltungsstrategie.

4.3. Vorausschauende Qualitätskontrolle

Die vorausschauende Qualitätskontrolle verändert die Rolle der Qualitätssicherung grundlegend: von einer Kontrolle nach der Produktion hin zu einer proaktiven, prozessbegleitenden Funktion. Anstatt auf die Prüfung eines Endprodukts auf Eigenschaften wie Härte oder Zugfestigkeit zu warten, können ML-Modelle kontinuierlich Echtzeit-Prozessdaten aller Sensoren analysieren, um mit hoher Sicherheit die finalen Qualitätsmerkmale vorherzusagen.

Ein prädiktives Qualitätsmodell kann das komplexe Zusammenspiel von Rohmaterialqualität, Prozessparametern und Umgebungsbedingungen analysieren und so die optimalen Produktionseinstellungen für ein gewünschtes Ergebnis ermitteln. Prognostiziert das Modell, dass das Endprodukt außerhalb der Spezifikation liegt (z. B. zu weich ist), kann es den Bediener warnen oder sogar einen Prozessparameter (z. B. die Katalysatorzufuhr) automatisch anpassen, um die Abweichung in Echtzeit zu korrigieren. Diese Fähigkeit hilft nicht nur, Fehler präventiv zu vermeiden, sondern beschleunigt auch Forschung und Entwicklung durch schnellere Vorhersagen von Eigenschaften und die Identifizierung zugrundeliegender Muster in den Daten. Dieser Ansatz ist für Hersteller, die ihre Ausbeute maximieren und die betriebliche Effizienz steigern wollen, von strategischer Bedeutung.

V. Technischer Implementierungsplan

Die Implementierung dieser fortschrittlichen Lösungen erfordert ein strukturiertes, phasenweises Vorgehen, das die Komplexität der Datenintegration und der bestehenden Infrastruktur berücksichtigt. Ein klar definierter Fahrplan ist unerlässlich, um Risiken zu minimieren und einen frühzeitigen Return on Investment (ROI) nachzuweisen.

5.1. Phasenweiser Ansatz zur digitalen Transformation

Eine erfolgreiche digitale Transformation sollte nicht mit einer kompletten Umstrukturierung beginnen. Die hohen Anfangsinvestitionen und die Komplexität der Integration neuer Systeme können insbesondere für kleine und mittlere Unternehmen (KMU) abschreckend wirken. Ein effektiverer Ansatz ist die stufenweise Implementierung, beginnend mit einem Proof of Concept (PoC) an einer einzelnen Pilotproduktionslinie. Dieses risikoarme, klein angelegte Projekt ermöglicht es einem Unternehmen, die Interoperabilität neuer Sensoren und Software mit der bestehenden Infrastruktur zu testen und die Leistung zu bewerten, bevor es sich für eine breitere Einführung entscheidet. Der quantifizierte ROI dieses ersten Erfolgs kann dann genutzt werden, um einen überzeugenden Business Case für eine umfassendere Implementierung zu erstellen. Dieser Ansatz entspricht den Kernprinzipien von Industrie 4.0, die Interoperabilität, Echtzeitfähigkeit und Modularität betonen.

5.2. Datenmanagement- und Integrationsarchitektur

Eine robuste Dateninfrastruktur ist die Grundlage für alle prädiktiven und KI-gestützten Lösungen. Die Datenarchitektur muss in der Lage sein, die enormen Datenmengen und vielfältigen Datentypen einer intelligenten Fabrik zu verarbeiten. Dies erfordert typischerweise einen mehrschichtigen Ansatz mit einem Datenhistoriker und einem Data Lake.

Datenhistoriker:Ein Datenhistoriker ist eine spezialisierte Datenbank, die große Mengen an Zeitreihendaten aus industriellen Prozessen erfasst, speichert und verwaltet. Er dient als sorgfältig organisiertes digitales Archiv und erfasst jede Temperaturschwankung, jeden Druckmesswert und jede Durchflussrate mit einem präzisen Zeitstempel. Der Datenhistoriker ist das optimale Werkzeug zur Verarbeitung der kontinuierlichen, hohen Datenmengen von Prozesssensoren und die ideale Grundlage für fortgeschrittene Analysen.

Data Lake:Ein Data Lake ist ein zentrales Repository, das Rohdaten in ihrem nativen Format speichert und verschiedenste Datentypen verarbeiten kann, darunter strukturierte Zeitreihendaten, unstrukturierte Bilder von hochauflösenden Kameras und Maschinenprotokolle. Der Data Lake ist darauf ausgelegt, die enormen Mengen an heterogenen Daten aus allen Bereichen eines Unternehmens zu verarbeiten und so eine ganzheitliche, durchgängige Sicht zu ermöglichen. Für eine erfolgreiche Implementierung sind sowohl ein Datenhistoriker für die Kernprozessdaten als auch ein Data Lake für eine umfassendere Sichtweise erforderlich, die komplexe Analysen wie die Ursachenanalyse und die Korrelation mit Daten außerhalb der Sensordaten ermöglicht.

Eine logische, geschichtete Architektur für die Datenintegration würde wie folgt aussehen:

| Schicht | Komponente | Funktion | Datentyp |

| Rand | IoT-Sensoren, Gateways, SPSen | Echtzeit-Datenerfassung und lokale Verarbeitung | Zeitreihen, binär, diskret |

| Datenfundament | Datenhistoriker | Hochleistungsfähige, zeitgestempelte Speicherung von Prozessdaten | Strukturierte Zeitreihen |

| Zentrales Repository | Data Lake | Zentrales, skalierbares Repository für alle Datenquellen | Strukturiert, halbstrukturiert, unstrukturiert |

| Analytik & KI | Analyseplattform | Führt Vorhersagemodelle, maschinelles Lernen und Business Intelligence durch. | Alle Datentypen |

Tabelle 5.1: Wichtige Komponenten für Datenintegration und -verwaltung

5.3. Bewältigung der Herausforderungen bei der Integration von Altsystemen

Viele Chemieanlagen nutzen noch immer über zehn Jahre alte Betriebstechniksysteme (OT-Systeme), die häufig proprietäre Protokolle verwenden, welche mit modernen Standards inkompatibel sind. Die Ablösung dieser veralteten Systeme, wie z. B. Prozessleitsysteme (DCS) oder speicherprogrammierbare Steuerungen (SPS), ist ein Millionenprojekt, das erhebliche Produktionsausfälle verursachen kann. Eine praktischere und kostengünstigere Lösung ist der Einsatz von IoT-Gateways und APIs als Schnittstelle.

IoT-Gateways fungieren als Vermittler und übersetzen Daten von neuen IoT-Sensoren in ein Format, das ältere Systeme verarbeiten können. Sie ermöglichen es Unternehmen, fortschrittliche Überwachung ohne umfassende Systemumstellung zu implementieren, senken die Kostenbarriere und machen die vorgeschlagenen Lösungen deutlich zugänglicher. Darüber hinaus kann Edge Computing, bei dem Daten direkt an der Quelle verarbeitet werden, die Netzwerkbandbreite reduzieren und die Echtzeit-Reaktionsfähigkeit verbessern.

5.4. Entscheidung zwischen On-Premise- und Cloud-Architektur

Die Entscheidung für den Hosting-Standort von Daten- und Analyseplattformen ist von entscheidender Bedeutung und hat erhebliche Auswirkungen auf Kosten, Sicherheit und Skalierbarkeit. Es handelt sich nicht um ein einfaches „Entweder/Oder“, sondern die Wahl sollte auf einer sorgfältigen Analyse der jeweiligen Anwendungsfälle basieren.

| Kriterium | Vor Ort | Wolke |

| Kontrolle | Volle Kontrolle über Hardware, Software und Sicherheit. Ideal für stark regulierte Branchen. | Weniger direkte Kontrolle; ein Modell geteilter Verantwortung. |

| Kosten | Hohe anfängliche Hardwarekosten; Abschreibung und Wartung liegen in der Verantwortung des Unternehmens. | Niedrigere Anschaffungskosten dank eines „Pay-for-the-Use“-Modells. |

| Skalierbarkeit | Begrenzte Elastizität; erfordert manuelle Bereitstellung und Kapitalinvestitionen zur Skalierung. | Enorme Skalierbarkeit und Elastizität; kann dynamisch nach oben und unten skaliert werden. |

| Latenz | Geringe Latenz, da die Daten physisch nahe an der Quelle liegen. | Kann bei einigen Echtzeit-Steuerungsaufgaben zu übermäßigen Latenzzeiten führen. |

| Innovation | Langsamerer Zugang zu neuen Technologien; erfordert manuelle Software- und Hardware-Aktualisierungen. | Rasant wachsender Funktionsumfang durch Innovationen wie KI und ML. |

| Sicherheit | Das Unternehmen trägt die alleinige Verantwortung für alle Sicherheitsmaßnahmen. | Gemeinsame Verantwortung mit dem Anbieter, der für viele Sicherheitsebenen sorgt. |

Tabelle 5.2: Entscheidungsmatrix Cloud vs. On-Premise

Eine erfolgreiche Digitalstrategie nutzt häufig ein Hybridmodell. Geschäftskritische Regelkreise mit geringer Latenz und hochgradig geschützte Formulierungsdaten können für maximale Sicherheit und Kontrolle lokal gespeichert werden. Gleichzeitig kann eine Cloud-basierte Plattform für einen zentralen Datenspeicher genutzt werden, der langfristige historische Analysen, die Zusammenarbeit mit externen Partnern in der Forschung und den Zugriff auf modernste KI- und ML-Tools ermöglicht.

VI. Handbuch für praktische Optimierung und Diagnose

Der wahre Wert fortschrittlicher Überwachungs- und Modellierungssysteme zeigt sich erst, wenn sie zur Entwicklung praxisorientierter Werkzeuge für Produktionsleiter und Ingenieure eingesetzt werden. Diese Werkzeuge können den Entscheidungsprozess automatisieren und verbessern und so von reaktiver Fehlersuche zu proaktiver, modellbasierter Steuerung führen.

6.1. Ein modellgetriebenes Diagnoseframework

In der traditionellen Fertigung ist die Fehlersuche ein zeitaufwändiger, manueller Prozess, der auf der Erfahrung des Bedieners und dem Prinzip von Versuch und Irrtum beruht. Ein modellbasiertes Diagnose-Framework automatisiert diesen Prozess, indem es Echtzeitdaten und Modellausgaben nutzt, um die wahrscheinlichste Ursache eines Problems sofort zu identifizieren.

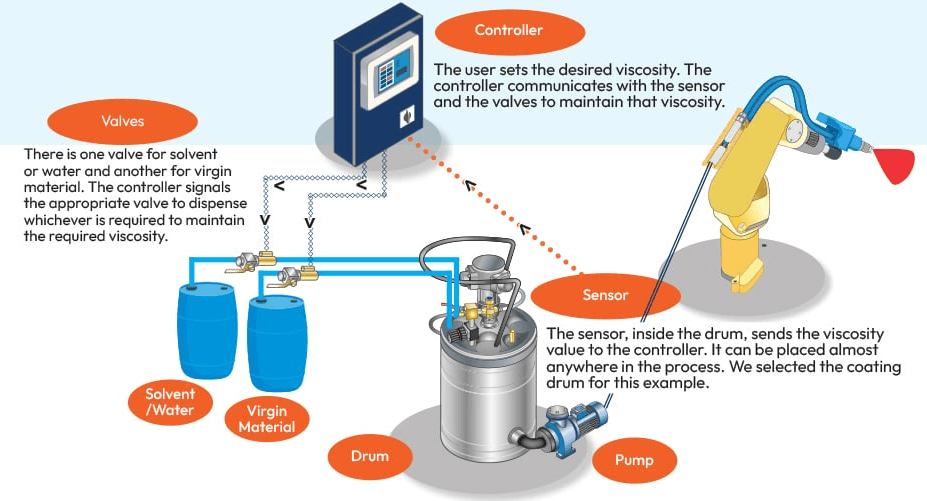

Das System fungiert als Entscheidungsbaum oder logisches Flussdiagramm. Wird ein Fehlersymptom erkannt (z. B. ein abweichender Viskositätswert eines Inline-Viskosimeters), korreliert das System dieses Symptom automatisch mit Daten anderer Sensoren (z. B. Temperatur, NCO/OH-Verhältnis) und den Ergebnissen der Vorhersagemodelle (z. B. dem RSM-Modell für die Härte). Anschließend kann das System dem Bediener eine priorisierte Liste potenzieller Ursachen präsentieren. Dadurch verkürzt sich die Diagnosezeit von Stunden auf Minuten, und Korrekturmaßnahmen werden deutlich beschleunigt. Dieser Ansatz geht über die reine Fehlererkennung hinaus und identifiziert und behebt proaktiv die zugrunde liegende Problematik.

Abbildung 6.1: Ein vereinfachtes Flussdiagramm, das den Prozess der Verwendung von Echtzeit-Sensordaten und Vorhersagemodellen veranschaulicht, um die Bediener zu einer spezifischen Ursache und einer Korrekturmaßnahme zu führen.

Dieser Ansatz lässt sich in einer Diagnosematrix zusammenfassen, die der Zielgruppe als Kurzanleitung dient.

| Defekt/Symptom | Relevanter Datenstrom | Wahrscheinliche Ursache |

| Uneinheitliche Härte | NCO/OH-Verhältnis, Temperaturprofil | Falsches Materialverhältnis, ungleichmäßiges Temperaturprofil |

| Schlechte Haftung | Oberflächentemperatur, Luftfeuchtigkeit | Unsachgemäße Oberflächenvorbereitung, Beeinträchtigung durch Umgebungsfeuchtigkeit |

| Blasen oder Hautunreinheiten | Viskositätsprofil, Temperatur | Flüchtige Bestandteile, unsachgemäße Mischung oder falsches Wärmeprofil |

| Uneinheitliche Aushärtungszeit | NCO/OH-Verhältnis, Temperatur, Katalysatorzufuhrrate | Falsche Katalysatorkonzentration, Temperaturschwankung |

| Geschwächte Struktur | Gelierzeit, Viskositätsprofil | Unzureichende Wärme, lokale Schrumpfung über einem kühlen Bereich |

Tabelle 6.2: Diagnosematrix „Fehler zu Erkenntnis“

6.2. Intelligente Standardarbeitsanweisungen (SOPs)

Herkömmliche Standardarbeitsanweisungen (SOPs) sind statische, papierbasierte Dokumente, die eine starre, schrittweise Anleitung für Fertigungsprozesse bieten. Obwohl sie für die Standardisierung von Abläufen und die Sicherstellung der Einhaltung von Vorschriften unerlässlich sind, können sie Abweichungen im Echtzeitprozess nicht berücksichtigen. Eine „intelligente SOP“ ist eine neue, dynamische Verfahrensart, die mit Live-Prozessdaten integriert ist.

Eine herkömmliche Standardarbeitsanweisung (SOP) für einen Mischprozess legt beispielsweise eine konstante Temperatur und Mischzeit fest. Eine intelligente SOP hingegen ist mit Echtzeit-Temperatur- und Viskositätssensoren verknüpft. Erkennt ein Sensor einen Abfall der Umgebungstemperatur, passt die intelligente SOP die erforderliche Mischzeit oder Temperatur dynamisch an, um die Änderung auszugleichen und so eine gleichbleibende Produktqualität zu gewährleisten. Dadurch wird die SOP zu einem dynamischen, adaptiven Dokument, das den Bedienern hilft, in einem sich ständig verändernden Umfeld optimale Entscheidungen zu treffen, Schwankungen zu minimieren, Fehler zu reduzieren und die Gesamteffizienz zu steigern.

6.3. Optimierung von Regelkreisen

Der volle Nutzen der Sensoren und Vorhersagemodelle wird erst dann erschlossen, wenn sie in ein System integriert werden, das den Prozess aktiv steuert. Dies beinhaltet die Anwendung bewährter Verfahren zur Optimierung von Regelkreisen und die Implementierung fortschrittlicher Regelungsstrategien.

Die Optimierung von Regelkreisen ist ein systematischer Prozess, der mit einem tiefen Verständnis des Prozesses, der Definition des Regelungsziels und der anschließenden Feinabstimmung des Regelkreises anhand von Echtzeitdaten beginnt. Strategien der fortgeschrittenen Prozesssteuerung (APC), wie Kaskaden- und Vorsteuerung, können zur Verbesserung von Stabilität und Ansprechverhalten eingesetzt werden. Das übergeordnete Ziel ist die Schließung des Daten-zu-Aktions-Kreislaufs: Ein Inline-NIR-Sensor liefert Echtzeitdaten zum NCO/OH-Verhältnis, ein Vorhersagemodell prognostiziert das Ergebnis, und der Regelkreis nutzt diese Informationen, um die Isocyanat-Zufuhrpumpe automatisch anzupassen, das optimale Verhältnis aufrechtzuerhalten und Schwankungen zu eliminieren. Die kontinuierliche Überwachung der Regelkreisperformance ist entscheidend, um Abweichungen zu erkennen, Sensorprobleme zu identifizieren und den richtigen Zeitpunkt für eine Nachjustierung zu bestimmen, bevor sich die Prozessperformance verschlechtert.

VII. Fallstudien und bewährte Verfahren

Die Vorteile fortschrittlicher Überwachung und quantitativer Modellierung sind nicht nur theoretischer Natur; sie werden durch praktische Erfolge und einen messbaren ROI bestätigt. Die Erfahrungen führender Unternehmen liefern wertvolle Erkenntnisse und überzeugende Argumente für die Digitalisierung.

7.1. Lehren von Branchenführern

Die Digitalisierungsbemühungen großer Chemieunternehmen zeigen einen klaren Trend: Erfolg resultiert aus einer ganzheitlichen, durchgängigen Strategie, nicht aus einem stückweisen Ansatz.

DuPont:Das Unternehmen erkannte die Notwendigkeit einer resilienten Lieferkette in einem volatilen Markt und implementierte eine maßgeschneiderte digitale Plattform für die Szenarioanalyse. Dadurch konnte es fundiertere Geschäftsentscheidungen treffen und über 1.000 Produkte mit verbesserten Prognosefähigkeiten effektiver vertreiben. Die Erkenntnis daraus: Die Vernetzung unterschiedlicher Systeme – von der Lieferkette bis zum operativen Geschäft – auf einer zentralen Plattform ermöglicht einen umfassenden Überblick über die gesamte Wertschöpfungskette.

Covestro:Das Unternehmen führte eine globale Digitalisierungsstrategie ein, um eine zentrale Datenquelle für Projektdaten zu schaffen und die Abhängigkeit von Tabellenkalkulationen zu beenden. Dieser integrierte Ansatz sparte 90 % des zuvor für die manuelle Datenerfassung und -validierung aufgewendeten Zeitaufwands und erhöhte die Zuverlässigkeit deutlich. Zudem nutzte das Unternehmen die Digitalisierung, um neue Produkte schneller zu entwickeln und die Produktqualität sowie die Rentabilität der Fertigung zu steigern.

SABIC:Wir haben eine unternehmensweite Plattform für digitale Betriebsabläufe eingeführt, die Rohstoffqualität, Prozessparameter und Umgebungsbedingungen in digitale Prognosetools integriert. Eine KI-gestützte Lösung zur Anlagenüberwachung ist beispielsweise weltweit in allen Werken im Einsatz, prognostiziert potenzielle Ausfälle kritischer Anlagen und ermöglicht proaktive Wartung. Dieser ganzheitliche Ansatz hat zu Verbesserungen bei Energieeffizienz, Anlagenzuverlässigkeit und Betriebsabläufen geführt.

7.2. Kapitalrendite und konkrete Vorteile

Die Investition in diese Technologien ist eine strategische Geschäftsentscheidung mit einem klaren und substanziellen Ertrag. Fallstudien aus verschiedenen Branchen liefern überzeugende Belege für die finanziellen und betrieblichen Vorteile.

Prädiktive Analytik:Die AVEVA Predictive Analytics Software ermöglichte nachweislich Effizienzsteigerungen von bis zu 37 Millionen US-Dollar innerhalb von 24 Monaten, eine Reduzierung der laufenden Wartungskosten um 10 % und den Wegfall von 3.000 jährlichen Wartungsstunden. Ein Öl- und Gasunternehmen sparte 33 Millionen US-Dollar durch den Einsatz eines cloudbasierten Frühwarnsystems zur Erkennung von Anlagenanomalien. Das Programm einer Raffinerie erzielte einen dreifachen ROI und reduzierte die Anzahl der Korrosionsüberwachungsstellen um 27,4 %.

Effizienzverbesserungen:Ein Hersteller von Spezialchemikalien stand vor der Herausforderung, die Betriebskosten zu senken und die Produktionsplanung zu verbessern. Durch eine umfassende Analyse zur Identifizierung von Optimierungspotenzialen erzielte das Unternehmen einen signifikanten ROI von 2,7:1, mit Verbesserungen bei der Rohstoffausbeute und einer Steigerung der Stückproduktion.

Sicherheit und Logistik:Ein Gaskraftwerk konnte nach wiederholten Sicherheitsprüfungen die Evakuierungs- und Sammelzeiten durch Automatisierung um 70 % verkürzen. Die digitale Plattform von SABIC automatisierte manuelle Dokumentationsprozesse, die zuvor vier Tage in Anspruch nahmen, und reduzierte die Bearbeitungszeit auf nur einen Tag. Dadurch wurden wesentliche Engpässe beseitigt und Standgebühren vermieden.

Diese Ergebnisse zeigen, dass die vorgeschlagenen Strategien kein abstraktes Konzept sind, sondern ein bewährter, quantifizierbarer Weg zu mehr Rentabilität, Effizienz und Sicherheit.

7.3. Theoretische Fallstudie: Optimierung des NCO/OH-Verhältnisses

Diese abschließende Fallstudie veranschaulicht, wie die in diesem Bericht vorgestellten Konzepte in einer einzigen, zusammenhängenden Erzählung angewendet werden können, um ein häufig auftretendes, kostspieliges Problem in der PU-Produktion zu lösen.

Szenario:Ein Hersteller von PU-Beschichtungen stellt Chargenschwankungen hinsichtlich Härte und Aushärtungszeit des Endprodukts fest. Herkömmliche Labortests sind zu langsam, um das Problem rechtzeitig zu diagnostizieren und die Charge zu retten, was zu erheblichen Materialverlusten führt. Das Team vermutet, dass ein schwankendes NCO/OH-Verhältnis die Ursache ist.

Lösung:

Echtzeitüberwachung:Das Team installiert einen Echtzeit-NIR-Spektroskopiesensor in der Zuleitung, um das NCO/OH-Verhältnis kontinuierlich zu überwachen.2Die Daten dieses Sensors werden an einen Datenhistoriker übertragen und liefern so eine kontinuierliche und genaue Aufzeichnung dieses kritischen Parameters.

Quantitative Modellierung:Anhand historischer NIR-Daten entwickelte das Team ein RSM-Modell, das den genauen Zusammenhang zwischen dem NCO/OH-Verhältnis und der Härte sowie der Aushärtungszeit des Endprodukts herstellt. Mit diesem Modell lässt sich das optimale Verhältnis bestimmen, um die gewünschten Eigenschaften zu erzielen und die Endqualität einer Charge bereits im Reaktor vorherzusagen.

KI-gestützte Anomalieerkennung:Ein KI-gestütztes Anomalieerkennungsmodell wird auf den Datenstrom des NIR-Sensors angewendet. Das Modell lernt das normale Betriebsprofil des NCO/OH-Verhältnisses. Sobald es eine Abweichung von diesem gelernten Muster feststellt – selbst eine geringfügige, allmähliche Drift – sendet es eine Frühwarnung an das Produktionsteam. Dadurch wird ein Problem Wochen vor der Erkennung durch herkömmliche Laborproben erkannt.

Automatisierte Prozesssteuerung:Der letzte Schritt ist die Regelkreisschließung. Ein prädiktives Steuerungssystem nutzt die Echtzeitdaten des NIR-Sensors, um die Isocyanat-Zufuhrpumpe automatisch anzupassen. Dadurch werden menschliche Fehlerquellen eliminiert und das NCO/OH-Verhältnis während der gesamten Reaktion auf dem optimalen Wert gehalten. Dies beseitigt Schwankungen und garantiert eine gleichbleibende Qualität.

Durch die Anwendung dieses umfassenden Rahmens kann der Hersteller von einem reaktiven, fehlerorientierten Produktionsmodell zu einem proaktiven, datengesteuerten Modell übergehen, wodurch sichergestellt wird, dass jede Charge den Qualitätsstandards entspricht, Abfall reduziert und die Gesamtrentabilität verbessert wird.

Veröffentlichungsdatum: 08.09.2025