Produktionen af polyurethan (PU) belægninger og klæbemidler er en kompleks proces i flere trin, der styres af følsomme kemiske reaktioner. Mens efterspørgslen efter disse materialer fortsætter med at vokse på tværs af brancher, præsenterer deres fremstilling en række centrale udfordringer, der direkte påvirker produktkvalitet, produktionseffektivitet og den samlede rentabilitet. En grundig forståelse af disse grundlæggende problemstillinger er afgørende for at udvikle en strategisk og praktisk køreplan for forbedringer.

1.1. Iboende kemisk kompleksitet og variation: Udfordringen med hurtig hærdning

Polyurethanproduktion er en polyadditionsreaktion mellem polyoler og isocyanater, en proces, der ofte er hurtig og meget eksoterm. Hastigheden og varmen, der genereres ved denne reaktion, gør præcis kontrol exceptionelt vanskelig. Den iboende kompleksitet forværres yderligere af reaktionens følsomhed over for eksterne faktorer såsom temperatur, fugtighed og tilstedeværelsen af katalysatorer. Små, ukontrollerede udsving i disse miljøforhold eller materialetilførsler kan føre til betydelige variationer i slutproduktets egenskaber, herunder dets hærdningstid og fysiske ydeevne.

En fundamental udfordring i denne sammenhæng er den "korte brugstid" for mange hurtigthærdende PU-systemer. Tidsskalaerne for gasproduktion og PU-tværbinding er ofte for korte til at være kompatible med traditionelle karakteriseringsmetoder. Dette er et centralt teknisk og økonomisk problem. Traditionelle kvalitetskontrolprocedurer (QC), som involverer at tage en prøve fra reaktoren og transportere den til et laboratorium til analyse, er i sagens natur mangelfulde. Processen med laboratorietitrering er langsom, og kritisk set begynder prøvens kemiske egenskaber at ændre sig i det øjeblik, den fjernes fra reaktoren og udsættes for omgivende forhold. Denne latenstid betyder, at laboratorieresultaterne er en post mortem-analyse af en batch, der allerede er produceret. Dataene er ikke kun ikke-handlingsrettede, da de ankommer for sent til at muliggøre intervention, men også potentielt unøjagtige, da de ikke længere repræsenterer materialets tilstand inde i produktionsbeholderen. Denne fundamentale uforenelighed mellem traditionel, forsinkelsesbaseret kvalitetskontrol og den hurtige kinetik i PU-kemi er det primære problem, som avanceret overvågning og modellering skal løse.

1.2. Grundlæggende årsager til batchinkonsistens og defektdannelse

Uoverensstemmelser fra batch til batch og dannelse af defekter er ikke tilfældige hændelser, men en direkte konsekvens af manglende præcision i styringen af kritiske procesparametre. Slutproduktet er meget følsomt over for komponentforholdet, blandingsteknikken og temperaturprofilen gennem hele processen. En forkert blanding kan for eksempel føre til ujævnt fordelte fyldstoffer eller hærdere, hvilket forårsager "indbyggede spændinger" og defekter i slutproduktet.

Præcisionen af råmaterialetilførslen, især molforholdet mellem isocyanat (NCO) og hydroxyl (OH) grupper, er altafgørende for at opretholde kvalitetskontinuitet. Dette NCO/OH-forhold er en direkte faktor for slutproduktets egenskaber; efterhånden som forholdet stiger, stiger også vigtige fysiske egenskaber såsom trækstyrke, modul og hårdhed. Forholdet påvirker også materialets viskositet og hærdningsadfærd. Andre kritiske procesforhold, såsom varmeprofilen, er lige så vigtige. Utilstrækkelig eller ujævn opvarmning kan forårsage ujævn hærdning og lokal krympning, mens flygtige komponenter kan afdampe, hvilket fører til bobler og pletter.

En detaljeret analyse af de grundlæggende årsager til defekter afslører, at en enkelt sensor eller parameter ofte er utilstrækkelig til en præcis diagnose. Et problem som "Ingen gel eller hærder ikke" kan skyldes et forkert blandingsforhold, utilstrækkelig varme eller forkert blanding. Disse årsager er ofte indbyrdes forbundne. For eksempel vil en for lav temperatur forsinke hærdningsprocessen og kan fejlagtigt diagnosticeres som et problem med materialeforholdet. For virkelig at forstå og adressere den grundlæggende årsag er det nødvendigt at måle flere parametre samtidigt. Dette kræver en omfattende sensorsuite, der kan korrelere realtidsdata fra forskellige kilder for at isolere den sande årsagsfaktor fra de resulterende symptomer, en opgave der ligger ud over omfanget af traditionel enkeltpunktsovervågning.

1.3. Økonomisk og miljømæssig indvirkning af ineffektivitet

De tekniske udfordringer i forbindelse med polyurethanproduktion har direkte og betydelige økonomiske og miljømæssige konsekvenser. Råmaterialer af høj kvalitet, såsom polyoler og isocyanater, er dyre, og deres priser er underlagt udsving på grund af forstyrrelser i forsyningskæden, afhængighed af råolie og global efterspørgsel. Når et parti produkter ikke opfylder kvalitetsspecifikationerne, repræsenterer de spildte råmaterialer et direkte økonomisk tab, der forværrer disse høje omkostninger. Uplanlagt nedetid, som følge af behovet for at fejlfinde og korrigere procesafvigelser, er en anden stor økonomisk belastning.

På miljøfronten er ineffektiviteten og spild i traditionelle produktionsmetoder en betydelig bekymring. Mange konventionelle polyurethanbelægninger er opløsningsmiddelbaserede og bidrager til luftforurening gennem emissioner af flygtige organiske forbindelser (VOC). Mens industrier i stigende grad anvender vandbaserede og lav-VOC-alternativer, kan disse ofte ikke matche deres opløsningsmiddelbaserede modparters ydeevne i højtydende applikationer. Desuden er de råmaterialer, der anvendes i traditionel PU-produktion, oliebaserede, ikke-fornyelige og ikke-biologisk nedbrydelige. Defekte produkter, der ender som affald, kan frigive skadelige kemikalier i miljøet, når de nedbrydes over en periode på op til 200 år.

Konvergensen af disse økonomiske og miljømæssige faktorer skaber en stærk business case for digitalisering. Ved at implementere de løsninger, der foreslås i denne rapport, kan en virksomhed samtidig reducere omkostninger, forbedre rentabiliteten og forbedre sin bæredygtighedsprofil. Ved at adressere det tekniske problem med batch-inkonsistens mindskes de økonomiske og miljømæssige problemer direkte og omdannes en teknisk opgradering til et strategisk forretningsmæssigt imperativ.

Inline-overvågning af indholdet af frit isocyanat i polyurethan

II. Avancerede realtidsovervågningsteknologier

For at overvinde de iboende udfordringer ved PU-produktion er et skift fra traditionel laboratoriebaseret testning til realtids, inline-overvågning afgørende. Dette nye paradigme er afhængig af en række avancerede sensorteknologier, der kan levere kontinuerlige, handlingsrettede data om kritiske procesparametre.

2.1. Inline reologisk overvågning

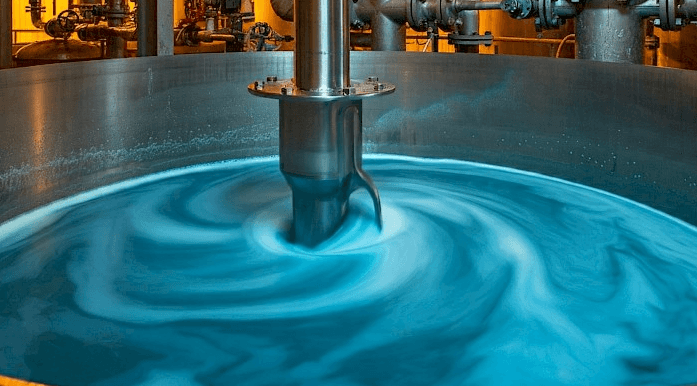

Reologiske egenskaber som viskositet og densitet er fundamentale for en polyurethanreaktions succes. De er ikke blot fysiske egenskaber, men fungerer som direkte indikatorer for polymerisations- og tværbindingsprocesserne. Realtidsovervågning af disse egenskaber opnås ved hjælp af inline-procesviskosimetre og densitetsmålere.

Instrumenter som f.eks.LonnmødteøhPolyhavViscomeleterogViscositakProfessionelcessorer designet til direkte indsættelse i rørledninger og reaktorer, hvilket muliggør kontinuerlig måling af en væskes viskositet, densitet og temperatur. Disse enheder fungerer på principper som vibrerende gaffelteknologi, som er robust, ikke kræver bevægelige dele og er ufølsom over for eksterne vibrationer og flowvariationer. Denne funktion giver en ikke-destruktiv realtidsmetode til at spore polymerisationsprocessen. NCO/OH-molforholdet og dannelsen af polære bindinger påvirker for eksempel direkte viskositeten, hvilket gør den til en pålidelig indikator for reaktionens fremskridt. Ved at sikre, at viskositeten forbliver inden for et bestemt område, kan et produktionsteam bekræfte, at reaktionen forløber som ønsket, og kontrollere tilsætningen af kædeforlængere for at opnå den ønskede molekylvægt og tværbinding. Denne stramme realtidskontrol forbedrer produktkvaliteten og reducerer spild ved at forhindre produktion af batches uden for specifikationerne.

2.2. Spektroskopisk analyse af kemisk sammensætning

Mens reologiske egenskaber angiver materialets fysiske tilstand,spektroskopisk analyse i realtidgiver en dybere forståelse af reaktionen på kemisk niveau. Nær-infrarød (NIR) spektroskopi er en overlegen metode til kontinuerlig overvågning af kernereaktionen ved at kvantificere koncentrationen af isocyanat (%NCO) og hydroxylgrupper.

Denne metode repræsenterer et betydeligt fremskridt i forhold til traditionel laboratorietitrering, som er langsom og bruger kemikalier, der kræver korrekt bortskaffelse. Et realtids-NIR-systems evne til at overvåge flere procespunkter fra en enkelt analysator giver en betydelig fordel med hensyn til effektivitet og sikkerhed. NCO/OH-forholdet er ikke blot en procesvariabel; det er en direkte bestemmende faktor for slutproduktets egenskaber, herunder trækstyrke, modul og hårdhed. Ved at levere kontinuerlige realtidsdata om dette kritiske forhold muliggør en NIR-sensor proaktiv justering af materialetilførselshastigheder. Dette transformerer kontrolprocessen fra en reaktiv, defektdrevet tilgang til en proaktiv, kvalitetsbaseret strategi, hvor et præcist NCO/OH-forhold opretholdes gennem hele reaktionen for at garantere et resultat af høj kvalitet.

2.3. Dielektrisk analyse (DEA) til overvågning af hærdningstilstand

Dielektrisk analyse (DEA), også kendt som dielektrisk termisk analyse (DETA), er en effektiv teknik til at overvåge den "usynlige hærdning i formen", som er afgørende for slutproduktets kvalitet. Den måler direkte ændringer i et materiales viskositet og hærdningstilstand ved at påføre en sinusformet spænding og måle de resulterende ændringer i mobiliteten af ladningsbærere (ioner og dipoler). Når et materiale hærder, øges dets viskositet dramatisk, og mobiliteten af disse ladningsbærere falder, hvilket giver et direkte, kvantificerbart mål for hærdningens fremskridt.

DEA kan præcist bestemme gelpunktet og slutningen af hærdningsprocessen, selv for hurtigthærdende systemer. Det tilbyder et nuanceret overblik, der supplerer andre teknologier. Mens et inline-viskosimeter måler materialets samlede bulkviskositet, giver en DEA-sensor indsigt i tværbindingsreaktionens kemiske udvikling. Kombinationen af eninline viskometer(måling afresultataf kuren) og en DEA-sensor (der målerprogressionaf kuren) giver et omfattende, todelt overblik over processen, der muliggør meget præcis kontrol og diagnose. DEA kan også bruges til at overvåge effektiviteten af forskellige tilsætningsstoffer og fyldstoffer.

En sammenligning af disse teknologier fremhæver deres komplementære natur. Ingen enkelt sensor kan give et komplet billede af den komplekse PU-reaktion. En holistisk løsning kræver integration af flere sensorer for at overvåge forskellige fysiske og kemiske egenskaber samtidigt.

| Parameter overvåget | Teknologiprincip | Primære brugsscenarier |

| Viskositet, temperatur | Vibrerende gaffelviskosimeter | Råmaterialekvalitetskontrol, reaktionsovervågning i realtid, slutpunktsdetektion. |

| %NCO, hydroxyltal | Nær-infrarød (NIR) spektroskopi | Overvågning af kemisk sammensætning i realtid, kontrol af fødeforhold, optimering af katalysator. |

| Hærdningstilstand, gelpunkt | Dielektrisk analyse (DEA) | Overvågning af hærdning i formen, verifikation af geleringstid, analyse af additiv effektivitet. |

Tabel 2.1: Sammenligning af avancerede inline-overvågningsteknologier til PU-produktion

III. Kvantitative prædiktive modelleringsrammer

De rige datastrømme fra avancerede overvågningsteknologier er en forudsætning for digitalisering, men deres fulde værdi realiseres, når de bruges til at bygge kvantitative prædiktive modeller. Disse modeller omsætter rådata til handlingsrettet indsigt, hvilket muliggør en dybere forståelse af processen og et skift mod proaktiv optimering.

3.1. Kemoreologisk og helbredelseskinetisk modellering

Det er ikke tilstrækkeligt blot at indsamle sensordatapunkter for at opnå ægte proceskontrol; dataene skal bruges til at opbygge en model, der forklarer den underliggende adfærd af den kemiske reaktion. Kemoreologiske og hærdningskinetiske modeller forbinder kemisk omdannelse med fysiske ændringer, såsom stigningen i viskositet og geleringstid. Disse modeller er særligt værdifulde for hurtigthærdende systemer, hvor et fænomens forbigående natur gør traditionel analyse vanskelig.5

Isokonversionsmetoder, også kendt som modelfrie tilgange, kan anvendes på ikke-isotermiske data for at forudsige reaktionskinetikken for hurtigthærdende harpikser. Sådanne modeller involverer stærkt koblet termo-kemo-reologisk analyse, hvilket betyder, at de tager hensyn til samspillet mellem temperatur, kemisk sammensætning og materialestrømningsegenskaber. Ved at opbygge en matematisk repræsentation af hele reaktionen går disse modeller ud over simpel overvågning og giver en reel procesforståelse. De kan forudsige, hvordan viskositeten vil ændre sig over tid for en given temperaturprofil, eller hvordan en ændring i en katalysator vil ændre reaktionshastigheden, hvilket giver et sofistikeret værktøj til kontrol og optimering.

3.2. Kemometrisk analyse og multivariat regression

Polyurethanproduktion er en multivariat proces, hvor flere faktorer interagerer for at bestemme slutproduktets kvalitet. Traditionel eksperimentering med én faktor er tidskrævende og formår ikke at indfange de komplekse, ikke-lineære sammenhænge mellem variabler. Kemometriske teknikker, såsom partiel mindste kvadraters regression (PLS) og responsoverflademetode (RSM), er designet til at imødegå denne udfordring.

Partiel mindste kvadraters regression (PLS) er en teknik, der er velegnet til analyse af store, korrelerede datasæt, såsom dem, der genereres af et realtids-NIR-spektrometer. PLS reducerer problemet fra et stort antal indbyrdes relaterede variabler til et lille antal udtrukne faktorer, hvilket gør den fremragende til prædiktive formål. I forbindelse med polyurethanproduktion kan PLS bruges til at diagnosticere procesproblemer og afsløre, hvordan kvalitetsvariabler varierer rumligt inden for produktet.

Response Surface Methodology (RSM) er en kraftfuld matematisk og statistisk metode specifikt til modellering og optimering af eksperimentelle forhold. RSM muliggør analyse af de kombinerede effekter af flere faktorer - såsom NCO/OH-forhold, kædeforlængelseskoefficient og hærdningstemperatur - på en ønsket responsvariabel som trækstyrke. Ved strategisk at placere eksperimentelle punkter i kritiske områder kan RSM nøjagtigt karakterisere de underliggende ikke-lineære forhold og interaktive effekter mellem faktorer. En undersøgelse demonstrerede effektiviteten af denne tilgang, hvor en model forudsiger de endelige egenskaber med en imponerende nøjagtighedsfejl på kun 2,2%, hvilket giver en overbevisende validering af metodologien. Evnen til at kortlægge hele "responsoverfladen" for en kvalitetsmåling gør det muligt for en ingeniør at identificere den optimale kombination af alle faktorer samtidigt, hvilket fører til en overlegen løsning.

3.3. Produktionsprocessens digitale tvilling

En digital tvilling er en dynamisk, virtuel kopi af et fysisk aktiv, system eller en proces. Inden for kemisk fremstilling er denne kopi drevet af realtidsdata fra IoT-sensorer og prædiktive modeller. Den fungerer som en levende, højkvalitets simulering af produktionslinjen. Den sande værdi af en digital tvilling ligger i dens evne til at skabe et lavrisikomiljø til optimering med høje indsatser.

Polyurethanproduktion er en dyr proces på grund af dyre råmaterialer og højt energiforbrug. At udføre fysiske eksperimenter for at optimere processen er derfor en højrisiko- og omkostningsbetonet opgave. En digital tvilling adresserer direkte denne udfordring ved at give ingeniører mulighed for at køre tusindvis af "hvad nu hvis"-scenarier på en virtuel model uden at forbruge råmaterialer eller produktionstid. Denne funktion fremskynder ikke kun time-to-market for nye formuleringer, men reducerer også omkostningerne og risikoen ved procesoptimering betydeligt. Derudover kan digitale tvillinger bygge bro mellem nye digitale teknologier og ældre, arvesystemer ved at integrere realtidsdata fra eksisterende infrastruktur og dermed skabe et samlet digitalt miljø uden behov for omfattende eftersyn.

IV. AI/maskinlæring til processtyring og anomalidetektion

Prædiktive modeller omdanner data til forståelse, men kunstig intelligens (AI) og maskinlæring (ML) tager det næste skridt: at omdanne forståelse til autonom handling og intelligent kontrol.

4.1. Systemer til registrering af anomali og fejl

Traditionelle processtyringssystemer er afhængige af statiske, hardkodede tærskler for at udløse alarmer. Denne tilgang er tilbøjelig til fejl, da den kan mislykkes med at registrere gradvise afvigelser, der forbliver inden for et acceptabelt område, eller kan generere generende alarmer, der desensibiliserer operatører. AI-drevet anomalidetektion repræsenterer et betydeligt paradigmeskift. Disse systemer er trænet på historiske data for at lære de normale driftsmønstre i en proces. De kan derefter automatisk identificere og markere eventuelle afvigelser fra dette lærte mønster, selvom en parameter endnu ikke har krydset en statisk tærskel.

For eksempel kan en gradvis, men konstant stigning i viskositeten over en specifik tidsramme, omend stadig inden for det acceptable område, være en varsel om et forestående problem, som et traditionelt system ville overse. Et AI-anomalidetekteringssystem ville genkende dette som et usædvanligt mønster og generere en tidlig advarsel, hvilket gør det muligt for teamet at træffe proaktive foranstaltninger for at forhindre en defekt batch. Denne funktion forbedrer kvalitetskontrollen betydeligt ved at registrere afvigelser fra de ønskede specifikationer, reducere risikoen for defekte produkter og sikre overholdelse af regler.

4.2. Prædiktiv vedligeholdelse af kritiske aktiver

Uplanlagt nedetid er en af de største omkostninger i industriel produktion. Traditionelle vedligeholdelsesstrategier er enten reaktive ("reparer det, når det går i stykker") eller tidsbaserede (f.eks. udskiftning af en pumpe hver sjette måned, uanset dens tilstand). Prædiktiv vedligeholdelse, drevet af ML-modeller, er et langt bedre alternativ.

Ved løbende at analysere realtidsdata fra sensorer (f.eks. vibrationer, temperatur, tryk) kan disse modeller identificere tidlige tegn på udstyrsnedbrydning og forudsige potentielle fejl. Systemet kan give en "tids-til-fejl-prognose", der giver teamet mulighed for at planlægge reparationer under en planlagt nedlukning uger eller endda måneder i forvejen. Dette eliminerer den dyre nedetid ved en uventet fejl og giver mulighed for bedre planlægning af arbejdsstyrke, reservedele og logistik. Investeringsafkastet (ROI) for denne tilgang er betydeligt og veldokumenteret i casestudier. For eksempel opnåede et raffinaderi et 3X ROI ved at implementere et proaktivt inspektionsprogram, mens et olie- og gasselskab sparede millioner af dollars med et tidligt varslingssystem, der registrerede udstyrsafvigelser. Disse håndgribelige økonomiske fordele taler for at overgå fra en reaktiv til en prædiktiv vedligeholdelsesstrategi.

4.3. Prædiktiv kvalitetskontrol

Prædiktiv kvalitetskontrol ændrer fundamentalt kvalitetssikringens rolle fra en postproduktionskontrol til en proaktiv funktion i processen. I stedet for at vente på, at et færdigt produkt testes for egenskaber som hårdhed eller trækstyrke, kan ML-modeller løbende analysere procesdata i realtid fra alle sensorer for med en høj grad af sikkerhed at forudsige, hvad de endelige kvalitetsegenskaber vil være.

En prædiktiv kvalitetsmodel kan identificere det komplekse samspil mellem råmaterialekvalitet, procesparametre og miljøforhold for at bestemme de optimale produktionsindstillinger for et ønsket resultat. Hvis modellen forudsiger, at det endelige produkt vil være uden for specifikationerne (f.eks. for blødt), kan den advare operatøren eller endda automatisk justere en procesparameter (f.eks. katalysatortilførselshastighed) for at korrigere afvigelsen i realtid. Denne funktion hjælper ikke kun med at forhindre defekter, før de opstår, men fremskynder også forskning og udvikling ved at give hurtigere forudsigelser af egenskaber og identificere underliggende mønstre i dataene. Denne tilgang er et strategisk imperativ for producenter, der søger at maksimere udbyttet og forbedre driftseffektiviteten.

V. Køreplan for teknisk implementering

Implementering af disse avancerede løsninger kræver en struktureret, faseopdelt tilgang, der adresserer kompleksiteten ved dataintegration og ældre infrastruktur. En veldefineret køreplan er afgørende for at mindske risiko og demonstrere et tidligt investeringsafkast (ROI).

5.1. Faseinddelt tilgang til digital transformation

En succesfuld digital transformationsrejse bør ikke begynde med en fuldskalarenovering. De høje initiale investeringsomkostninger og kompleksiteten ved at integrere nye systemer kan være uoverkommelige, især for små og mellemstore virksomheder. En mere effektiv tilgang er at implementere etaper, startende med et Proof of Concept (PoC) på en enkelt pilotproduktionslinje. Dette lavrisikoprojekt i lille skala giver en virksomhed mulighed for at teste interoperabiliteten mellem nye sensorer og software med eksisterende infrastruktur og evaluere ydeevnen, før den forpligter sig til en bredere udrulning. Det kvantificerede investeringsafkast fra denne indledende succes kan derefter bruges til at opbygge en overbevisende business case for en bredere implementering. Denne tilgang er i overensstemmelse med kerneprincipperne i Industri 4.0, som lægger vægt på interoperabilitet, realtidskapacitet og modularitet.

5.2. Datahåndterings- og integrationsarkitektur

En robust datainfrastruktur er fundamentet for alle prædiktive og AI-drevne løsninger. Dataarkitekturen skal være i stand til at håndtere den massive mængde og forskellige typer data, der genereres af en smart fabrik. Dette involverer typisk en lagdelt tilgang, der inkluderer en datahistoriker og en datasø.

Datahistoriker:En datahistoriker er en specialiseret database designet til at indsamle, lagre og administrere enorme mængder tidsseriedata fra industrielle processer. Den fungerer som et omhyggeligt organiseret digitalt arkiv, der registrerer alle temperaturudsving, trykaflæsninger og flowhastigheder med et præcist tidsstempel. Datahistorikeren er det optimale værktøj til at håndtere store, kontinuerlige datastrømme fra processensorer og er det "perfekte brændstof" til avanceret analyse.

Datasø:En datasø er et centralt arkiv, der indeholder rådata i deres oprindelige format og kan rumme forskellige datatyper, herunder strukturerede tidsseriedata, ustrukturerede billeder fra kvalitetskameraer og maskinlogfiler. Datasøen er designet til at håndtere de enorme mængder af forskellige data fra alle hjørner af en virksomhed, hvilket muliggør et mere holistisk, end-to-end-overblik. En vellykket implementering kræver både en datahistoriker til kerneprocesdata og en datasø til et bredere, omfattende overblik, der muliggør kompleks analyse som rodårsagsanalyse og korrelation med ikke-sensordata.

En logisk lagdelt arkitektur til dataintegration ville se således ud:

| Lag | Komponent | Fungere | Datatype |

| Kant | IoT-sensorer, gateways, PLC'er | Dataindsamling og lokal behandling i realtid | Tidsserier, binære, diskrete |

| Data Foundation | Datahistoriker | Højtydende, tidsstemplet lagring af procesdata | Strukturerede tidsserier |

| Centralt arkiv | Datasø | Centraliseret, skalerbart lager til alle datakilder | Struktureret, semistruktureret, ustruktureret |

| Analyse og AI | Analyseplatform | Kører prædiktive modeller, maskinlæring og business intelligence | Alle datatyper |

Tabel 5.1: Vigtige komponenter til dataintegration og -styring

5.3. Håndtering af udfordringer med integration af ældre systemer

Mange kemiske fabrikker er stadig afhængige af driftsteknologiske (OT) systemer, der er over et årti gamle, og som ofte bruger proprietære protokoller, der er uforenelige med moderne standarder. At erstatte disse ældre systemer, såsom distribuerede kontrolsystemer (DCS) eller programmerbare logiske controllere (PLC), er et projekt til flere millioner dollars, der kan forårsage betydelig produktionsnedetid. En mere praktisk og omkostningseffektiv løsning er at bruge IoT-gateways og API'er som en bro.

IoT-gateways fungerer som formidlere, der oversætter data fra nye IoT-sensorer til et format, som ældre systemer kan forstå. De gør det muligt for en virksomhed at implementere avanceret overvågning uden en fuldstændig revision, hvilket direkte adresserer omkostningsbarrieren og gør de foreslåede løsninger langt mere tilgængelige. Derudover kan implementering af edge computing, hvor data behandles direkte ved kilden, reducere netværksbåndbredden og forbedre responstiden i realtid.

5.4. Beslutning om on-premise vs. cloud-arkitektur

Beslutningen om, hvor data- og analyseplatforme skal hostes, er kritisk og har betydelige konsekvenser for omkostninger, sikkerhed og skalerbarhed. Valget er ikke et simpelt "enten/eller", men bør baseres på en omhyggelig analyse af de specifikke anvendelsesscenarier.

| Kriterium | On-Premise | Sky |

| Kontrollere | Fuld kontrol over hardware, software og sikkerhed. Ideel til stærkt regulerede brancher. | Mindre direkte kontrol; en model med delt ansvar. |

| Koste | Høje initiale hardwareomkostninger; afskrivninger og vedligeholdelse er virksomhedens ansvar. | Lavere startomkostninger med en "betal-for-det-du-bruger"-model. |

| Skalerbarhed | Begrænset elasticitet; kræver manuel provisionering og kapitalinvesteringer for at skalere op. | Enorm skalerbarhed og elasticitet; kan skaleres dynamisk op og ned. |

| Latens | Lav latenstid, da data er fysisk tæt på kilden. | Kan have for stor latenstid for visse kontrolbelastninger i realtid. |

| Innovation | Langsommere adgang til nye teknologier; kræver manuelle software- og hardwareopdateringer. | Hurtigt voksende funktionssæt med innovationer som AI og ML. |

| Sikkerhed | Virksomheden har det fulde ansvar for alle sikkerhedspraksisser. | Delt ansvar med udbyderen, som håndterer mange sikkerhedslag. |

Tabel 5.2: Cloud vs. On-Premise beslutningsmatrix

En succesfuld digital strategi bruger ofte en hybridmodel. Missionskritiske kontrolløkker med lav latenstid og stærkt proprietære formuleringsdata kan opbevares lokalt for maksimal sikkerhed og kontrol. Samtidig kan en cloudbaseret platform bruges til en centraliseret datasø, der muliggør langsigtet historisk analyse, samarbejdsforskning med eksterne partnere og adgang til banebrydende AI- og ML-værktøjer.

VI. Praktisk optimerings- og diagnosticeringsmanual

Den sande værdi af avanceret overvågning og modellering realiseres, når de bruges til at skabe handlingsrettede værktøjer til produktionsledere og ingeniører. Disse værktøjer kan automatisere og forbedre beslutningsprocessen, og gå fra reaktiv fejlfinding til proaktiv, modeldrevet kontrol.

6.1. En modeldrevet diagnostisk ramme

I et traditionelt produktionsmiljø er fejlfinding af defekter en tidskrævende, manuel proces, der er afhængig af operatørens erfaring og en trial-and-error-tilgang. Et modeldrevet diagnostisk framework automatiserer denne proces ved at bruge realtidsdata og modeloutput til øjeblikkeligt at identificere den mest sandsynlige rodårsag til et problem.

Rammen fungerer som et beslutningstræ eller et logisk flowdiagram. Når et defektsymptom detekteres (f.eks. en unormal viskositetsaflæsning fra et inline-viskosimeter), korrelerer systemet automatisk dette symptom med data fra andre sensorer (f.eks. temperatur, NCO/OH-forhold) og outputtet fra de prædiktive modeller (f.eks. RSM-modellen for hårdhed). Systemet kan derefter præsentere en prioriteret liste over potentielle rodårsager for operatøren, hvilket reducerer diagnosetiden fra timer til minutter og muliggør en meget hurtigere korrigerende handling. Denne tilgang går fra blot at finde en defekt til proaktivt at identificere og korrigere det underliggende problem.

Figur 6.1: Et forenklet flowdiagram, der illustrerer processen med at bruge realtidssensordata og prædiktive modeller til at guide operatører mod en specifik rodårsag og en korrigerende handling.

Denne tilgang kan opsummeres i en diagnostisk matrix, der giver en hurtig referenceguide til målgruppen.

| Fejl/Symptom | Relevant datastrøm | Sandsynlig årsag |

| Inkonsekvent hårdhed | NCO/OH-forhold, temperaturprofil | Forkert materialeforhold, ujævn temperaturprofil |

| Dårlig vedhæftning | Overfladetemperatur, luftfugtighed | Forkert overfladebehandling, påvirkning af miljøfugtighed |

| Bobler eller pletter | Viskositetsprofil, temperatur | Flygtige komponenter, forkert blanding eller varmeprofil |

| Uregelmæssig hærdningstid | NCO/OH-forhold, temperatur, katalysatortilførselshastighed | Forkert katalysatorkoncentration, temperaturudsving |

| Svækket struktur | Geleringstid, viskositetsprofil | Utilstrækkelig varme, lokaliseret krympning over et køligt område |

Tabel 6.2: Diagnostisk matrix for fejl-til-indsigt

6.2. Smarte standarddriftsprocedurer (SOP'er)

Traditionelle standard driftsprocedurer (SOP'er) er statiske, papirbaserede dokumenter, der giver en stiv, trinvis vejledning til fremstillingsprocesser. Selvom de er afgørende for at standardisere operationer og sikre overholdelse af regler, kan de ikke tage højde for procesafvigelser i realtid. En "smart SOP" er en ny, dynamisk generation af procedurer, der er integreret med live procesdata.

For eksempel kan en traditionel SOP for en blandingsproces specificere en konstant temperatur og blandetid. En smart SOP ville derimod være knyttet til realtidstemperatur- og viskositetssensorer. Hvis en sensor registrerer, at omgivelsestemperaturen er faldet, kan den smarte SOP dynamisk justere den nødvendige blandetid eller temperatur for at kompensere for ændringen og dermed sikre, at den endelige produktkvalitet forbliver ensartet. Dette gør SOP'en til et levende, adaptivt dokument, der hjælper operatører med at træffe den optimale beslutning i et flydende realtidsmiljø, minimerer variation, reducerer fejl og forbedrer den samlede effektivitet.

6.3. Optimering af kontrolsløjfer

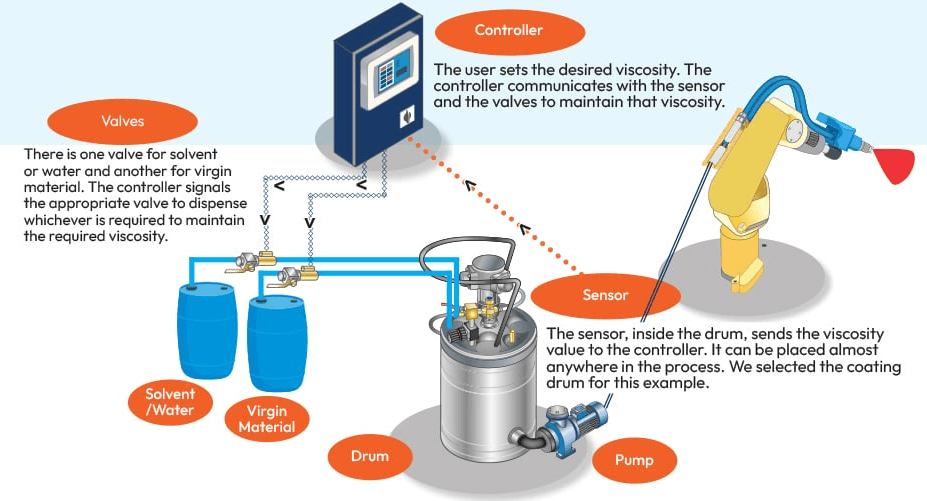

Sensorernes og de prædiktive modellers fulde værdi opnås, når de integreres i et system, der aktivt styrer processen. Dette involverer anvendelse af bedste praksis for finjustering af kontrolkredsløb og implementering af avancerede kontrolstrategier.

Optimering af kontrolkredsløb er en systematisk proces, der begynder med en dyb forståelse af processen, definition af kontrolmålet og derefter brug af realtidsdata til at justere kredsløbet. Avancerede processtyringsstrategier (APC), såsom kaskade- og feed-forward-styring, kan bruges til at forbedre stabilitet og responsivitet. Det endelige mål er at lukke data-til-handling-cyklussen: en inline NIR-sensor leverer realtidsdata om NCO/OH-forholdet, en prædiktiv model forudsiger resultatet, og kontrolkredsløbet bruger disse oplysninger til automatisk at justere isocyanat-fødepumpen, opretholde det optimale forhold og eliminere variation. Kontinuerlig overvågning af kredsløbets ydeevne er afgørende for at fange drift, identificere sensorproblemer og bestemme, hvornår der skal justeres, før procesydelsen forringes.

VII. Casestudier og bedste praksis

Fordelene ved avanceret overvågning og kvantitativ modellering er ikke blot teoretiske; de valideres af succeser i den virkelige verden og kvantificerbart investeringsafkast. Erfaringerne fra brancheledere giver værdifulde erfaringer og en overbevisende business case for digitalisering.

7.1. Erfaringer fra brancheledere

Digitaliseringsindsatsen hos store kemivirksomheder viser en klar tendens: succes kommer fra en holistisk, end-to-end strategi, ikke en stykkevis tilgang.

DuPont:Anerkendte behovet for en robust forsyningskæde i et volatilt marked og implementerede en tilpasset digital platform til "hvad nu hvis"-scenariemodellering. Dette gjorde det muligt for dem at træffe smartere forretningsbeslutninger og effektivt distribuere over 1.000 produkter med forbedrede forudsigelsesfunktioner. Lærdommen er, at det at forbinde forskellige systemer - fra forsyningskæden til driften - til en centraliseret platform giver et omfattende overblik over hele værdikæden.

Covestro:Lancerede en global virksomhedsdigitaliseringsstrategi for at skabe en centraliseret "enkelt kilde til sandhed" til projektdata og dermed bevæge sig væk fra en afhængighed af regneark. Denne integrerede tilgang sparede 90 % af den tid, der tidligere blev brugt på manuel dataindsamling og validering, og den øgede pålideligheden betydeligt. Virksomheden udnyttede også digitalisering til at udvikle nye produkter hurtigere og øge produktkvaliteten og produktionsrentabiliteten.

SABIC:Implementerede en virksomhedsomspændende digital driftsplatform, der integrerer råmaterialekvalitet, procesparametre og miljøforhold i digitale prædiktive værktøjer. En AI-drevet løsning til aktivsundhed fungerer for eksempel på tværs af virksomhedens anlæg globalt og forudsiger potentielle fejl i kritisk udstyr og muliggør proaktiv vedligeholdelse. Denne holistiske tilgang har ført til forbedringer i energieffektivitet, aktivernes pålidelighed og driftsmæssigt fodaftryk.

7.2. ROI og håndgribelige fordele

Investeringen i disse teknologier er en strategisk forretningsbeslutning med et klart og betydeligt afkast. Casestudier fra forskellige brancher giver en overbevisende bekræftelse af de økonomiske og operationelle fordele.

Prædiktiv analyse:AVEVA Predictive Analytics-softwaren har vist sig at kunne opnå effektivitetsbesparelser på op til 37 millioner dollars inden for 24 måneder, med en reduktion på 10 % i tilbagevendende vedligeholdelsesomkostninger og eliminering af 3.000 årlige vedligeholdelsestimer. Et olie- og gasselskab sparede 33 millioner dollars ved at bruge et cloud-aktiveret tidligt varslingssystem til at detektere udstyrsuregelmæssigheder. Et raffinaderiprogram gav et 3-dobbelt investeringsafkast og reducerede antallet af korrosionsovervågningssteder sikkert med 27,4 %.

Effektivitetsforbedringer:En producent af specialkemikalier stod over for udfordringer med at reducere driftsomkostninger og forbedre produktionsforudsigeligheden. Ved at implementere en omfattende analyse for at identificere forbedringsmuligheder opnåede de et betydeligt investeringsafkast på 2,7:1 med forbedringer i råvareudbyttet pr. enhed og et boost i produktionen pr. enhed.

Sikkerhed og logistik:Et gasanlæg var i stand til at reducere evakuerings- og mønstringstiderne med 70 % gennem automatisering efter gentagne fejlslagne sikkerhedsrevisioner. SABICs digitale platform automatiserede manuelle dokumentationsprocesser, som tidligere tog fire dage, hvilket reducerede tiden til blot én dag, eliminerede store flaskehalse og undgik demurrage-gebyrer.

Disse resultater viser, at de foreslåede strategier ikke er et abstrakt koncept, men en dokumenteret, kvantificerbar vej til at opnå større rentabilitet, effektivitet og sikkerhed.

7.3. Teoretisk casestudie: Optimering af NCO/OH-forholdet

Denne sidste casestudie illustrerer, hvordan de koncepter, der præsenteres i hele denne rapport, kan anvendes i en enkelt, sammenhængende fortælling til at løse et almindeligt og dyrt problem i PU-produktion.

Scenarie:En producent af PU-belægninger oplever uoverensstemmelser mellem batcher i slutproduktets hårdhed og hærdningstid. Traditionelle laboratorietests er for langsomme til at diagnosticere problemet i tide til at redde batchen, hvilket fører til betydeligt materialespild. Teamet har mistanke om, at et svingende NCO/OH-forhold er den grundlæggende årsag.

Løsning:

Overvågning i realtid:Holdet installerer en realtids-NIR-spektroskopisensor i fødeledningen for kontinuerligt at overvåge NCO/OH-forholdet.2Dataene fra denne sensor streames til en datahistoriker, hvilket giver en kontinuerlig og nøjagtig registrering af denne kritiske parameter.

Kvantitativ modellering:Ved hjælp af de historiske NIR-data udvikler teamet en RSM-model, der fastlægger det præcise forhold mellem NCO/OH-forholdet og slutproduktets hårdhed og hærdningstid. Denne model giver dem mulighed for at bestemme det optimale forhold for at opnå de ønskede egenskaber og forudsige den endelige kvalitet af en batch, mens den stadig er i reaktoren.

AI-drevet anomalidetektion:En AI-anomalidetekteringsmodel implementeres på datastrømmen fra NIR-sensoren. Modellen lærer den normale driftsprofil for NCO/OH-forholdet at kende. Hvis den registrerer en afvigelse fra dette lærte mønster – selv en lille, gradvis afvigelse – sender den en tidlig advarsel til produktionsteamet. Dette giver en alarm uger før et problem ville være blevet opdaget ved traditionel laboratorieprøvetagning.

Automatiseret processtyring:Det endelige trin er at lukke kredsløbet. Et prædiktivt styresystem implementeres, der bruger realtidsdata fra NIR-sensoren til automatisk at justere fødepumpen for isocyanatet. Dette eliminerer den menneskelige faktor og sikrer, at NCO/OH-forholdet opretholdes på den optimale værdi gennem hele reaktionen, hvilket eliminerer variation og garanterer ensartet kvalitet.

Ved at anvende denne omfattende ramme kan producenten gå fra en reaktiv, defektdrevet produktionsmodel til en proaktiv, datadrevet model, hvilket sikrer, at hvert parti opfylder kvalitetsstandarder, reducerer spild og forbedrer den samlede rentabilitet.

Opslagstidspunkt: 8. september 2025